Заглавная страница Избранные статьи Случайная статья Познавательные статьи Новые добавления Обратная связь FAQ Написать работу КАТЕГОРИИ: ТОП 10 на сайте Приготовление дезинфицирующих растворов различной концентрацииТехника нижней прямой подачи мяча. Франко-прусская война (причины и последствия) Организация работы процедурного кабинета Смысловое и механическое запоминание, их место и роль в усвоении знаний Коммуникативные барьеры и пути их преодоления Обработка изделий медицинского назначения многократного применения Образцы текста публицистического стиля Четыре типа изменения баланса Задачи с ответами для Всероссийской олимпиады по праву

Мы поможем в написании ваших работ! ЗНАЕТЕ ЛИ ВЫ?

Влияние общества на человека

Приготовление дезинфицирующих растворов различной концентрации Практические работы по географии для 6 класса Организация работы процедурного кабинета Изменения в неживой природе осенью Уборка процедурного кабинета Сольфеджио. Все правила по сольфеджио Балочные системы. Определение реакций опор и моментов защемления |

Математическое определение регрессииСодержание книги Похожие статьи вашей тематики

Поиск на нашем сайте

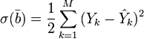

Строго регрессионную зависимость можно определить следующим образом. Пусть Y, X1,X2,...,Xp — случайные величины с заданным совместным распределением вероятностей. Если для каждого набора значений X1 = x1,X2 = x2,...,Xp = xp определено условное математическое ожидание y(x1,x2,...,xp) = E(Y | X1 = x1,X2 = x2,...,Xp = xp) (уравнение линейной регрессии в общем виде), то функция y(x1,x2,...,xp) называется регрессией величины Y по величинам X1,X2,...,Xp, а её график — линией регрессии Y по X1,X2,...,Xp, или уравнением регрессии. Зависимость Y от X1,X2,...,Xp проявляется в изменении средних значений Y при изменении X1,X2,...,Xp. Хотя при каждом фиксированном наборе значений X1 = x1,X2 = x2,...,Xp = xp величина Y остаётся случайной величиной с определённым рассеянием. Для выяснения вопроса, насколько точно регрессионный анализ оценивает изменение Y при изменении X1,X2,...,Xp, используется средняя величина дисперсии Y при разных наборах значений X1,X2,...,Xp (фактически речь идет о мере рассеяния зависимой переменной вокруг линии регрессии). Метод наименьших квадратов (расчёт коэффициентов) На практике линия регрессии чаще всего ищется в виде линейной функции Y = b0 + b1X1 + b2X2 +... + bNXN (линейная регрессия), наилучшим образом приближающей искомую кривую. Делается это с помощью метода наименьших квадратов, когда минимизируется сумма квадратов отклонений реально наблюдаемых Y от их оценок (имеются в виду оценки с помощью прямой линии, претендующей на то, чтобы представлять искомую регрессионную зависимость):

(M — объём выборки). Этот подход основан на том известном факте, что фигурирующая в приведённом выражении сумма принимает минимальное значение именно для того случая, когда Y = y(x1,x2,...xN). Для решения задачи регрессионного анализа методом наименьших квадратов вводится понятие функции невязки:

Условие минимума функции невязки:

Показатели вариации Вариацию можно определить как количественное различие значений одного и того же признака у отдельных единиц совокупности. Термин «вариация» имеет латинское происхождение - variatio, что означает различие, изменение, колеблемость. Изучение вариации в статистической практике позволяет установить зависимость между изменением, которое происходит в исследуемом признаке, и теми факторами, которые вызывают данное изменение. Для измерения вариации признака используют как абсолютные, так и относительные показатели. К абсолютным показателям вариации относят: размах вариации, среднее линейное отклонение, среднее квадратическое отклонение, дисперсию. К относительным показателям вариации относят: коэффициент осцилляции, линейный коэффициент вариации, относительное линейное отклонение и др. Размах вариации R. Это самый доступный по простоте расчета абсолютный показатель, который определяется как разность между самым большим и самым малым значениями признака у единиц данной совокупности:

Размах вариации (размах колебаний) - важный показатель колеблемости признака, но он дает возможность увидеть только крайние отклонения, что ограничивает область его применения. Для более точной характеристики вариации признака на основе учета его колеблемости используются другие показатели. Среднее линейное отклонение d, которое вычисляют для того, чтобы учесть различия всех единиц исследуемой совокупности. Эта величина определяется как средняя арифметическая из абсолютных значений отклонений от средней. Так как сумма отклонений значений признака от средней величины равна нулю, то все отклонения берутся по модулю.

Формула среднего линейного отклонения (простая)

Формула среднего линейного отклонения (взвешенная)

При использовании показателя среднего линейного отклонения возникают определенные неудобства, связанные с тем, что приходится иметь дело не только с положительными, но и с отрицательными величинами, что побудило искать другие способы оценки вариации, чтобы иметь дело только с положительными величинами. Таким способом стало возведение всех отклонений во вторую степень. Обобщающие показатели, найденные с использованием вторых степеней отклонений, получили очень широкое распространение. К таким показателям относятся среднее квадратическое отклонение и среднее квадратическое отклонение в квадрате, которое называют дисперсией. Средняя квадратическая простая

Средняя квадратическая взвешенная

Дисперсия есть не что иное, как средний квадрат отклонений индивидуальных значений признака от его средней величины. Формулы дисперсии взвешенной и простой:

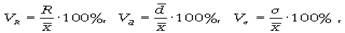

Расчет дисперсии можно упростить. Для этого используется способ отсчета от условного нуля (способ моментов), если имеют место равные интервалы в вариационном ряду. Кроме показателей вариации, выраженных в абсолютных величинах, в статистическом исследовании используются показатели вариации (V), выраженные в относительных величинах, особенно для целей сравнения колеблемости различных признаков одной и той же совокупности или для сравнения колеблемости одного и того же признака в нескольких совокупностях. Данные показатели рассчитываются как отношение размаха вариации к средней величине признака (коэффициент осцилляции), отношение среднего линейного отклонения к средней величине признака (линейный коэффициент вариации), отношение среднего квадратического отклонения к средней величине признака (коэффициент вариации) и, как правило, выражаются в процентах. Формулы расчета относительных показателей вариации:

где VR - коэффициент осцилляции; - линейный коэффициент вариации; - коэффициент вариации. Из приведенных формул видно, что чем больше коэффициент V приближен к нулю, тем меньше вариация значений признака. В статистической практике наиболее часто применяется коэффициент вариации. Он используется не только для сравнительной оценки вариации, но и для характеристики однородности совокупности. Совокупность считается однородной, если коэффициент вариации не превышает 33% (для распределений, близких к нормальному).

Критерий Дарбина — Уотсона Критерий Дарбина — Уотсона (или DW-критерий) — статистический критерий, используемый для нахождения автокорреляции первого порядка элементов исследуемой последовательности. Наиболее часто применяется при анализе временных рядов и остатков регрессионных моделей. Критерий назван в честь Джеймса Дарбина и Джеффри Уотсона. Критерий Дарбина — Уотсона рассчитывается по следующей формуле

где ρ1 — коэффициент автокорреляции первого порядка. В случае отсутствия автокорреляции d = 2, при положительной автокорреляции d стремится к нулю, а при отрицательной — к 4:

На практике применение критерия Дарбина — Уотсона основано на сравнении величины d с теоретическими значениями dL и dU для заданных числа наблюдений n, числа независимых переменных модели k и уровня значимости α. Если d < dL, то гипотеза о независимости случайных отклонений отвергается (следовательно присутствует положительная автокорреляция); Если d > dU, то гипотеза не отвергается; Если dL < d < dU, то нет достаточных оснований для принятия решений. Когда расчетное значение d превышает 2, то с dL и dU сравнивается не сам коэффициент d, а выражение (4 − d). Также с помощью данного критерия выявляют наличие коинтеграции между двумя временными рядами. В этом случае проверяют гипотезу о том, что фактическое значение критерия равно нулю. С помощью метода Монте-Карло были получены критические значения для заданных уровней значимости. В случае, если фактическое значение критерия Дарбина — Уотсона превышает критическое, то нулевую гипотезу об отсутствии коинтеграции отвергают. Недостатки: Неприменим к моделям авторегрессии. Не способен выявлять автокорреляцию второго и более высоких порядков. Даёт достоверные результаты только для больших выборок.

|

||||

|

Последнее изменение этой страницы: 2016-04-26; просмотров: 644; Нарушение авторского права страницы; Мы поможем в написании вашей работы! infopedia.su Все материалы представленные на сайте исключительно с целью ознакомления читателями и не преследуют коммерческих целей или нарушение авторских прав. Обратная связь - 18.188.233.69 (0.007 с.) |