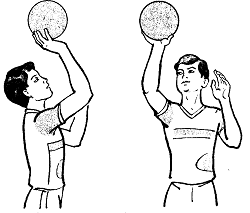

Заглавная страница Избранные статьи Случайная статья Познавательные статьи Новые добавления Обратная связь FAQ Написать работу КАТЕГОРИИ: ТОП 10 на сайте Приготовление дезинфицирующих растворов различной концентрацииТехника нижней прямой подачи мяча. Франко-прусская война (причины и последствия) Организация работы процедурного кабинета Смысловое и механическое запоминание, их место и роль в усвоении знаний Коммуникативные барьеры и пути их преодоления Обработка изделий медицинского назначения многократного применения Образцы текста публицистического стиля Четыре типа изменения баланса Задачи с ответами для Всероссийской олимпиады по праву

Мы поможем в написании ваших работ! ЗНАЕТЕ ЛИ ВЫ?

Влияние общества на человека

Приготовление дезинфицирующих растворов различной концентрации Практические работы по географии для 6 класса Организация работы процедурного кабинета Изменения в неживой природе осенью Уборка процедурного кабинета Сольфеджио. Все правила по сольфеджио Балочные системы. Определение реакций опор и моментов защемления |

Действия, выполняемые с информацией, называются информационными процессами. Есть три типа информационных процессов: хранение, передача и обработка информации.Содержание книги

Похожие статьи вашей тематики

Поиск на нашем сайте Человек воспринимает информацию из окружающего мира с помощью своих органов чувств - их пять: зрение, слух, вкус, обоняние, осязание. Более 90% информации поступает к нам через зрение и слух. Но и запахи, вкусовые и осязательные ощущения тоже несут информацию. Например, почувствовав запах гари, вы можете узнать, что на кухне сгорел обед, о котором забыли. На вкус вы легко узнаете знакомую пищу, на ощупь – знакомые предметы даже в темноте. Информация воспринимается человеком в речевой или письменной форме. Она бывает звуковой или графической, в виде цвета или сигналов, символов, знаков, жестов. Информация обладает определенными свойствами: - достоверность (это значит, что информация должна соответствовать истинному положению дел, т.е. быть правдивой); - понятность (информация должна поступать к приемнику на понятном ему языке и соответствовать его уровню восприятия, т.е. если сейчас вам рассказать о квантовой физике, вы ничего не поймете, т.к. не обладаете необходимыми для восприятия этой информации знаниями); - полнота (информации должно быть достаточно для принятия правильного решения, т.е. если для решения математической задачи у вас не будет необходимых данных, вы не сможете решить эту задачу); - своевременность (информация должна поступать вовремя, без опоздания); - актуальность (информация должна быть важной, ценной, нужной в момент ее получения).

1. Что такое информация для человека? 2. Приведите примеры декларативных и процедурных знаний. 3. Какие действия можно выполнять с информацией? Приведите примеры. 4. Что значит «оперативная» память человека и какую информацию она хранит? 5. Какими свойствами должна обладать информация?

Кодирование информации

При передаче информации происходит кодирование информации, и мы должны договориться о том, как понимать те или иные обозначения. Человек выражает свои мысли словами. Они являются алфавитным представлением информации. На уроках физики при рассмотрении какого-либо явления мы используем формулы. В этом случае говорят о языке алгебры. Формула - это математический код. Существует язык глухонемых, где символы - мимика и жесты; язык музыки, где символы - ноты и т.д. Основу любого языка составляет алфавит - конечный набор различных символов, из которых складывается сообщение. Одна и та же запись может нести разную смысловую нагрузку. Например, набор цифр 251299 может обозначать: массу объекта; длину объекта; расстояние между объектами; номер телефона; дату 25 декабря 1999 года. Эти примеры говорят, что для представления информации могут использоваться разные коды, и поэтому надо знать законы записи этих кодов, т.е. уметь кодировать. Код - набор условных обозначений для представления информации. Кодирование - процесс представления информации в виде кода. Кодирование сводится к использованию совокупности символов по строго определенным правилам. При переходе улицы мы встречаемся с кодированием информации в виде сигналов светофора. Водитель передает сигнал с помощью гудка или миганием фар. Кодировать информацию можно устно, письменно, жестами или сигналами любой другой природы. По мере развития техники появились разные способы кодирования информации. Во второй половине XIX века американский изобретатель Морзе изобрел удивительный код, который служит человечеству до сих пор. Характерной особенностью азбуки Морзе является переменная длина кода разных букв, поэтому код Морзе называют неравномерным кодом. Буквы, которые встречаются в тексте чаще, имеют более короткий код, чем редкие буквы. Это сделано для того, чтобы сократить длину всего сообщения. Но из-за переменной длины кода букв возникает проблема отделения букв друг от друга в тексте. Поэтому для разделения приходится использовать паузу (пропуск). Следовательно, телеграфный алфавит Морзе является троичным, т.к. в нем используются три знака: точка, тире, пропуск. В качестве источников информации может выступать человек, техническое устройство, предметы, объекты живой и неживой природы. Получателей сообщения может быть несколько или один. В процессе обмена информацией мы совершаем две операции: кодирование и декодирование. При кодировании происходит переход от исходной формы представления информации в форму, удобную для хранения, передачи или обработки, а при декодировании - в обратном направлении. Декодирование - это процесс восстановления содержания закодированной информации. Способ кодирования зависит от цели, ради которой осуществляется. Существует три основных способа кодирования информации: Графический - с помощью рисунков или значков; Числовой - с помощью чисел; Символьный - с помощью символов того же алфавита, что и текст. Множество кодов очень прочно вошло в нашу жизнь. Так: Ø числовая информация кодируется арабскими, римскими цифрами. (часы в классе) Ø для общения мы используем код - русский язык, в Англии - английский и т.д. Ø с помощью нотных знаков записывается (кодируется) любое музыкальное произведение правила дорожного движения закодированы с помощью дорожных знаков Ø код используется для оценки ваших знаний в школе ("5" отлично и т.д.), вы пишите что-то в тетради - на самом деле вы кодируете информации с помощью специальных символов, эти символы - буквы. Ø свой код (почтовый индекс) имеет каждый населённый пункт. Людьми были придуманы специальные коды, к ним относятся: Азбука Брайля, азбука Морзе, флажковая азбука. В середине 19 века французский педагог Луи Брайль придумал специальный шрифт для слепых. Буквы этого шрифта выдавливались на листках плотной бумаги. Проводя пальцами по образовавшимся от уколов выступам, люди учатся различать буквы и могут читать специальные книги. Шифрование - это тоже кодирование, но с засекреченным методом, известным только источнику и адресату. Двоичное кодирование - это кодирование, при котором используется всего два символа. Вся информация, поступающая в компьютер (винчестер) кодируется числами 1 и 0, это может быть картинка, буквы, числа, так поступающую информацию видит компьютер.

Флажковая азбука на флоте:

1. Что такое алфавит? 2. Что происходит в процессе кодирования и декодирования информации? 3. Что такое двоичное кодирование? 4. С помощью флажковой азбуки зашифруйте фразу: «Учение да труд к славе ведут!»

5. 6. Расшифруйте (декодируйте), что здесь написано: ▬ ▬ ▬ ▬ ▬ ● ▬ ● ● ▬ ▬ ▬ ▬ ● ● ▬ ● ▬ ● ▬ ● ▬ ▬ 7. Зашифруйте с помощью азбуки Морзе слова: ИНФОРМАТИКА, ДАННЫЕ, АЛГОРИТМ. 8.

Чтобы рубить дрова, нужен

а чтобы полить огород -

Рыбаки сделали во льду и стали ловить рыбу.

Самый колючий зверь в лесу – это

9. Дана кодировочная таблица (первая цифра – номер строки, вторая – номер столбца):

С помощью кодировочной таблицы зашифруйте фразу: Я УМЕЮ РАБОТАТЬ С ИНФОРМАЦИЕЙ! А ТЫ? 10. Используя кодировочную таблицу, расшифруйте текст: 11. «Шифр Цезаря». Этот шифр реализует следующее преобразование текста: каждая буква исходного текста заменяется третьей после нее буквой в алфавите, который считается написанным по кругу. Используя этот шифр, зашифруйте фразы: ИНФОРМАЦИОННЫЕ ПРОЦЕССЫ, ДВОИЧНОЕ КОДИРОВАНИЕ. Двоичное кодирование Из предыдущего параграфа мы с вами узнали, что такое кодирование информации, какие существуют способы кодирования и для чего вообще кодируется информация. Так же мы узнали, что вся информация, поступающая в компьютер, представлена в виде двоичного кода. Но для того, чтобы мы могли двигаться дальше, нам необходимо дать информации несколько другое определение, т. е. посмотреть на информацию с технической точки зрения. Для человека информация – это знания, которые он получает из окружающего мира, а для компьютера или другого технического устройства информация – это набор сигналов или импульсов, распознавая которые, компьютер выполняет те или иные действия. Возникает вопрос – почему в компьютере используется двоичное кодирование? Почему не привычная нам десятичная система счисления? Ответ очень прост: двоичное кодирование использует всего два символа – 0 и 1, т.е. можно сказать так 0 – нет сигнала (выкл.), 1 – есть сигнал (вкл.). Такие два устойчивых состояния очень легко технически реализовать – на этом принципе и созданы все микросхемы компьютера. Заменим 0 на лампочку, которая не горит, а 1 на лампочку, которая горит. Если у нас всего одна лампочка, то с ее помощью можно закодировать только два сигнала: горит и не горит, если у нас две лампочки, то с их помощью мы можем закодировать уже 4 различных сигнала:

Если нам необходимо закодировать большее количество сигналов, то очевидно необходимо взять уже три лампочки. Давайте посмотрим, сколько различных сигналов можно закодировать, если использовать три лампочки:

Из таблицы видно, что с помощью трех лампочек мы можем закодировать уже восемь сигналов. Напрашивается вывод - чем больше нам нужно закодировать сигналов (информации), тем большее количество символов (лампочек) нам для этого понадобится.

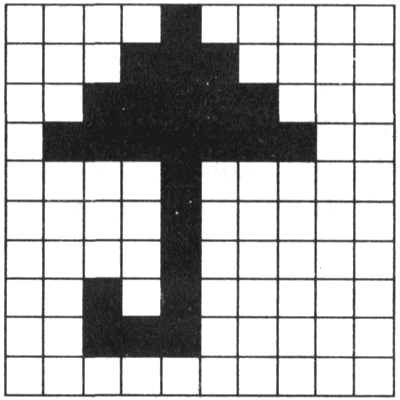

1. Что такое информация с технической точки зрения? 2. Почему в компьютере используется двоичное кодирование информации? 3. 4. Закодируйте картинку с помощью двоичного кола, приняв белый цвет за 0, а черный цвет за 1.

Количество информации Многие из вас уже знают, что информация измеряется в байтах, Кбайтах и т.д. Но возникают вопросы: почему ее стали измерять с помощью этих величин, кто это придумал? Ведь информация – это величина абстрактная, ее нельзя потрогать, взвесить на весах, измерить линейкой. Как же тогда определить количество информации?

Основоположником теории информации, теории кодирования информации является выдающийся американский математик Клод Шеннон, который в 40-х годах ХХ века, т.е. на заре создания ЭВМ предложил наименьшую единицу для измерения информации – бит. Он связал количество информации в сообщении с вероятностью его появления. В технике используется эта же единица – бит. Однако, надо помнить, что информация при этом имеет несколько другой смысл, т.е. информация рассматривается с технической точки зрения. Что же это за единица измерения количества информации – бит? Вспомним о двоичном кодировании. Один бит имеет два различных состояния (0 и 1). 1 бит – это такое количество информации, которое позволяет нам выбрать один вариант из двух возможных. Сигнал, который может иметь только два различных состояния, передает 1 бит информации. Вернемся к двоичному кодированию и вспомним, что с помощью одной лампочки (т.е. 1 бита) можно закодировать только два сигнала. С помощью двух лампочек (2 бита) можно закодировать 4 сигнала. С помощью трех лампочек (3 бита) можно закодировать 8 сигналов. Итак: 1 бит позволяет закодировать 21=2 различных варианта сигналов; 2 бита позволяют закодировать 22=4 различных варианта сигналов; 3 бита позволяют закодировать 23=8 различных вариантов сигналов. Понятно, что для каждого следующего бита нужно предыдущее количество бит умножить на 2.

Количество информации в 8 битах оказалось очень удобной величиной, и для нее придумали название – байт. Байт – единица количества информации в Международной системе СИ.

Обратите внимание, что только для измерения количества информации приставка «кило» означает умножение не на 1000, а на 1024 (это связано с 210).

Вопросы для повторения и задания: 1. Кто впервые разработал теорию кодирования? 2. Что нужно сделать с информацией, чтобы ее можно было измерить? 3. Что такое 1 бит, 1 байт? 4. Какие еще бывают единицы измерения информации? 5. Какое количество символов можно закодировать 8-ю битами? 6. В неделе 7 дней, сколько понадобится бит, чтобы присвоить неповторимый код для каждого дня недели? 7. Словарь Эллочки-«людоедки» (персонаж романа И. Ильфа и Е. Петрова «Двенадцать стульев») составляет 30 слов. Какое количество бит понадобится, чтобы закодировать весь словарный запас Эллочки? 8. У вас имеется 7 фонариков. Сколько различных сигналов можно передать, зажигая фонарики? 9. Примерно 150 лет назад французский педагог Луи Брайль придумал специальный шрифт для слепых. Каждая буква это шрифта состоит из шести выпуклых точек, которые в различных комбинациях возвышаются над листом бумаги. Сколько различных букв можно сделать в шрифте Брайля? 10. Вычислите точно, сколько байтов содержится в одном мегабайте и в одном гигабайте. 1Кбайт = 1024 байт 1 Мбайт = 1024 Кбайт =_________байт 1 Гбайт = 1024 Мбайт = _________байт 11. Переведите из одних единиц измерения информации в другие: 5 Кбайт = _________байт 40 байт = _________бит 1/16 Мбайта = ________Кбайтов =_________байтов 1Мбит =_________Кбайтов 7168 байтов = ___________Кбайтов 3Кбита = ___________байтов 2Гбайта = _________Кбайтов

12. Сравните величины: 4 Мбайта 4096 Кбайта 256 бит 30 байтов 12288 байтов 13 Кбайтов 24 Кбита 3 Кбайта 32800 байтов 1/32 Мбайта 3,2 Гбайт 4000 Мбайт 7 байтов 55 битов 8150 байтов 8 Кбайт

|

||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

Последнее изменение этой страницы: 2016-12-27; просмотров: 986; Нарушение авторского права страницы; Мы поможем в написании вашей работы! infopedia.su Все материалы представленные на сайте исключительно с целью ознакомления читателями и не преследуют коммерческих целей или нарушение авторских прав. Обратная связь - 216.73.216.230 (0.014 с.) |

Вопросы для повторения:

Вопросы для повторения: Люди издревле кодировали информацию: в виде рисунков, зарубок на дощечках, иероглифов, потом появилась письменность, создавались специальные символы для кодирования и т.д.

Люди издревле кодировали информацию: в виде рисунков, зарубок на дощечках, иероглифов, потом появилась письменность, создавались специальные символы для кодирования и т.д.

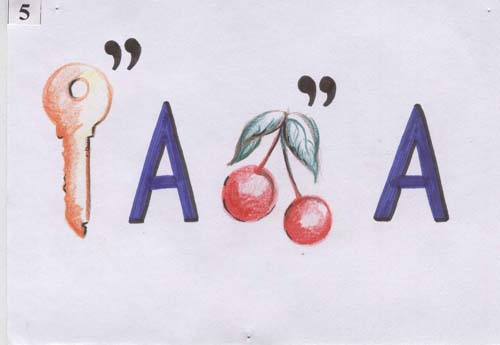

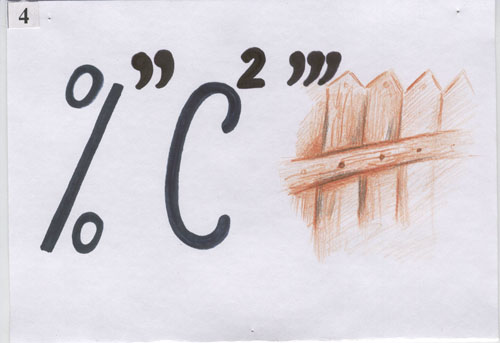

Разгадайте ребусы:

Разгадайте ребусы: Составьте таблицу двоичного кодирования для 4-х и 5-ти лампочек. Сколько сигналов можно закодировать с помощью 4-х лампочек и сколько с помощью 5-ти лампочек?

Составьте таблицу двоичного кодирования для 4-х и 5-ти лампочек. Сколько сигналов можно закодировать с помощью 4-х лампочек и сколько с помощью 5-ти лампочек? А ведь мы не зря уделили такое большое внимание кодированию информации. Значит для того, чтобы измерить информацию ее нужно сначала, что? Правильно – закодировать.

А ведь мы не зря уделили такое большое внимание кодированию информации. Значит для того, чтобы измерить информацию ее нужно сначала, что? Правильно – закодировать.