Заглавная страница Избранные статьи Случайная статья Познавательные статьи Новые добавления Обратная связь FAQ Написать работу КАТЕГОРИИ: ТОП 10 на сайте Приготовление дезинфицирующих растворов различной концентрацииТехника нижней прямой подачи мяча. Франко-прусская война (причины и последствия) Организация работы процедурного кабинета Смысловое и механическое запоминание, их место и роль в усвоении знаний Коммуникативные барьеры и пути их преодоления Обработка изделий медицинского назначения многократного применения Образцы текста публицистического стиля Четыре типа изменения баланса Задачи с ответами для Всероссийской олимпиады по праву

Мы поможем в написании ваших работ! ЗНАЕТЕ ЛИ ВЫ?

Влияние общества на человека

Приготовление дезинфицирующих растворов различной концентрации Практические работы по географии для 6 класса Организация работы процедурного кабинета Изменения в неживой природе осенью Уборка процедурного кабинета Сольфеджио. Все правила по сольфеджио Балочные системы. Определение реакций опор и моментов защемления |

Интеллектуальные системы. Основные классы систем и задач.Содержание книги

Похожие статьи вашей тематики

Поиск на нашем сайте

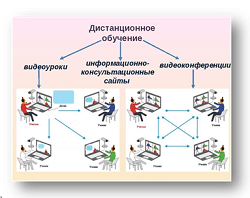

Интеллектуальные системы. Основные классы систем и задач. Понятие ИИС ИИС – такая компьютерная система, которая моделирует любое из свойств естественного интеллекта (совокупность возможностей живых организмов): · Условный рефлекс · Сложная программа поведения · Мышление Свойства ИИС: · Обучаемость · Адаптивность (адекватность) – согласование поведения с окружающей средой. · Умение найти верное решение в новой ситуации. Примеры ИИС: · Систем распознавания рукописного текста · Система распознавания речи · Автопилоты взлёта-посадки. · Программы перевода. · Экспертные системы. Критерии интеллектуальности ИС Критерием интеллектуальности – измерительная процедура, позволяющая установить, является ли объект пониманием данного интеллектуального свойства. Критерий обучаемости строится как статистическая процедура, которая должна зафиксировать, что в большинстве текстов достигается нужное поведение. Критерий адаптивности – измеримая процедура для адаптивности, она зависит от заданной ситуации и строится каждый раз по-разному. Способность решать новые задачи – процедура проверки способности системы решать задачу, за счёт нарушения ограничений первичной заданной ситуации. История развития ИИС Первые работы по ИИС были сделаны в конце 40-х гг. прошлого столетия. В связи со слабым развитием компьютеров это были системы, моделирующие отдельные свойства зрения, слуха, отдельные функции мозга, т.е. развивалось бионическое направление. С 60-х гг. прошлого века стало развиваться новое символьное направление, которое предлагало решение интеллектуальных задач, изобретённые человеком. Данное направление стали называть искусственным интеллектом. Задачи связаны с компьютерной лингвистикой (направлением ИС: цель – использование математических моделей для описания естественных языков) и с решением различных игр на компьютере. Методы – методы ограниченных переборов. Для развития игровой ситуации формировалось дерево решений, и исследовались алгоритмы перебора в глубину и в ширину. Ограничители перебора – оценочные функции (эвристики). В текущем столетии развиваются гибридные интеллектуальные системы, объединяющие 2 данных направления. Развитие задач робототехники, создание реальных интеллектуальных устройств потребовало интеграции символьных и вычислительных методов. Развитие мягких вычислений. Бионическое – символьное – логические методы – экспертные системы – вычислительный интеллект – гибридные системы. Классификация задач, решаемых ИИС В задачах анализа множество решений может быть перечислено и включено в систему. В задачах синтеза множество решений потенциально не ограничено и строится из решений компонент или подпроблем. Задачи анализа 1. Интерпретация данных – процесс определения смысла данных, результаты которого должны быть согласованными и корректными. Это одна из традиционных задач для экспертных систем. Обычно предусматривается многовариантный анализ данных. 2. Диагностика – процесс соотношения объекта с некоторым классом объектов и/или обнаружение неисправности в некоторой системе. Неисправность — это отклонение от нормы. Такая трактовка позволяет с единых теоретических позиций рассматривать и неисправность оборудования в технических системах, и заболевания живых организмов, и всевозможные природные аномалии. Важной спецификой является необходимость понимания функциональной структуры («анатомии») диагностирующей системы. 3. Поддержка принятия решений — это совокупность процедур, обеспечивающая лицо, принимающее решения, необходимой информацией и рекомендациями, облегчающие процесс принятия решения. Эти ЭС помогают специалистам выбрать и/или сформировать нужную альтернативу среди множества выборов при принятии ответственных решений. Задачи синтеза 1. Проектирование состоит в подготовке спецификаций на создание «объектов» с заранее определёнными свойствами. Спецификация – весь набор необходимых документов—чертёж, пояснительная записка и т.д. Основные проблемы — получение чёткого структурного описания знаний об объекте и проблема «следа». Для организации эффективного проектирования и в ещё большей степени перепроектирования необходимо формировать не только сами проектные решения, но и мотивы их принятия. Таким образом, в задачах проектирования тесно связываются два основных процесса, выполняемых в рамках соответствующей ЭС: процесс вывода решения и процесс объяснения. 2. Планирование – нахождение планов действий, относящихся к объектам, способным выполнять некоторые функции. В таких ЭС используются модели поведения реальных объектов с тем, чтобы логически вывести последствия планируемой деятельности. 3. Управление – функция организованной системы, поддерживающая определенный режим деятельности. Такого рода ЭС осуществляют управление поведением сложных систем в соответствии с заданными спецификациями. Комбинированные задачи 1. Мониторинг. Основная задача мониторинга — непрерывная интерпретация данных в реальном масштабе времени и сигнализация о выходе тех или иных параметров за допустимые пределы. Главные проблемы — «пропуск» тревожной ситуации и инверсная задача «ложного» срабатывания. Сложность – в размытости симптомов тревожных ситуаций и необходимость учёта временного контекста. 2. Прогнозирование позволяет предсказывать последствия некоторых событий или явлений на основании анализа имеющихся данных. Прогнозирующие системы логически выводят вероятные следствия из заданных ситуаций. В прогнозирующей системе обычно используется параметрическая динамическая модель, в которой значения параметров «подгоняются» под заданную ситуацию. Выводимые из этой модели следствия составляют основу для прогнозов с вероятностными оценками. 3. Обучение – использование компьютера для обучения какой-то дисциплине или предмету. Системы обучения диагностируют ошибки при изучении какой-либо дисциплины с помощью ЭВМ и подсказывают правильные решения. Они аккумулируют знания о гипотетическом «ученике» и его характерных ошибках, затем в работе они способны диагностировать слабости в познаниях обучаемых и находить соответствующие средства для их ликвидации. Кроме того, они планируют акт общения с учеником в зависимости от успехов ученика с целью передачи знаний. Классы ИИС Системы с интеллектуальным интерфейсом (коммуникативные способности): 1. Интеллектуальные БД – БД, которые отличаются от обычных возможностью выборки по запросу информации, которая может явно не храниться, а выводиться из имеющейся БД (например, вывести список товаров, цена которых выше отраслевой).; 2. Естественно-языковой интерфейс предполагает трансляцию естественно-языковых конструкций на машинный уровень представления знаний. При этом осуществляется распознавание и проверка написанных слов по словарям и синтаксическим правилам. Данный интерфейс облегчает обращение к интеллектуальным БД, а также голосовой ввод команд в системах управления.; 3. Гипертекстовые системы предназначены для поиска текстовой информации по ключевым словам в базах; 4. Контекстные системы – частный случай гипертекстовых и естественно-языковых систем; 5. Когнитивная графика. Данные системы позволяют осуществлять взаимодействие пользователя ИИС с помощью графических образов. Экспертные системы (решение сложных задач) – это ИИС, предназначенная для решения слабоформализуемых задач на основе накапливаемого в базе знаний опыта работы экспертов в проблемной области: 1. Классифицирующие системы – ЭС распознавания ситуаций, в них определяют принадлежность анализируемой ситуации к некоторому классу. 2. Доопределяющие системы – задачи, которые решаются на основе неопределенных исходных данных и применяемых знаний. ЭС должна доопределять недостающие знания, а в пространстве решений может получаться несколько возможных решений с различной вероятностью или уверенностью в необходимости их выполнения; 3. Трансформирующие системы – ЭС, которые предполагают повторяющееся преобразование знаний в процессе решения задач, что связано с характером результата, который нельзя заранее предопределить, а также с динамичностью самой проблемной области; 4. Многоагентные системы – это динамические ЭС, основанные на интеграции нескольких разнородных источников знаний. Эти источники обмениваются между собой получаемыми резуль-татами в ходе решения задач. Самообучающиеся системы (способность к самообучению): 1. Индуктивные системы позволяют обобщать примеры на основе принципа индукции "от частного к общему"; 2. Нейронная сеть – модель нервной системы, которая представляет собой совокупность большого числа сравнительно простых элементов – нейронов, топология соединения которых зависит от типа сети; 3. Системы, основанные на прецедентах. Прецеденты описываются множеством признаков, по которым строятся индексы быстрого поиска. В них допускается нечеткий поиск с получением множества допустимых альтернатив, каждая из которых оценивается некоторым коэффициентом уверенности; 4. Информационные хранилища отличаются от интеллектуальных баз данных, тем, что представляют собой хранилища значимой информации, регулярно извлекаемой из оперативных баз данных. Экспертные системы Экспертная система (ЭС) – это ИИС, предназначенная для решения слабоформализуемых задач на основе накапливаемого в базе знаний опыта работы экспертов в проблемной области. ЭС начали разрабатываться исследователями искусственного интеллекта в 1970-х годах, а в 1980-х получили коммерческое подкрепление. ЭС включает базу знаний (основывается на моделях представления знаний) с набором правил (эвристик) и механизмом вывода и позволяет на основании предоставляемых пользователем фактов: · распознать ситуацию, · поставить диагноз, · сформулировать решение · дать рекомендацию для выбора действия. Цель исследований по ЭС состоит в разработке программ, которые при решении задач, трудных для эксперта-человека, получают результаты, не уступающие по качеству и эффективности решениям, получаемым экспертом. ЭС разрабатываются с использованием математического аппарата нечеткой логики для эксплуатации в узких областях применения, поскольку их использование требует больших компьютерных ресурсов для обработки и хранения знаний. В силу больших финансовых и временных затрат в российских ЭИС ЭС не имеют большого распространения. Особенности ЭС · применяются для решения только трудных практических (не игрушечных) задач. · по качеству и эффективности решения не уступают решениям эксперта-человека. · решения экспертных систем обладают "прозрачностью", т.е. могут быть объяснены пользователю на качественном уровне. Это качество обеспечивается их способностью рассуждать о своих знаниях и умозаключениях. · способны пополнять свои знания в ходе взаимодействия с экспертом. Система функционирует в следующем циклическом режиме: · выбор (запрос) данных или результатов анализов, · наблюдение, · интерпретация результатов, · усвоение новой информации, · выдвижение с помощью правил временных гипотез · выбор следующей порции данных или результатов анализов. Такой процесс продолжается до тех пор, пока не поступит информация, достаточная для окончательного заключения. Важным свойством ЭС является возможность их применения для обучения и тренировки персонала (содержат знания с объяснениями, ПО (интерфейс между обучаемой и ЭС), знания о методах обучения и поведения пользователя). Технологию построения ЭС называют инженерией знаний. Этот процесс требует специфической формы взаимодействия создателя ЭС, которого называют инженером знаний, и одного или нескольких экспертов в некоторой предметной области. Инженер знаний «извлекает» из экспертов процедуры, стратегии, эмпирические правила, которые они используют при решении задач, и встраивает эти знания в ЭС. База знаний (БЗ) отражает знания экспертов. Наиболее важный параметр БЗ — качество содержащихся знаний. · включают самую релевантную, достоверную свежую информацию, · имеют совершенные системы поиска информации · имеют тщательно продуманную структуру и формат знаний. Особенности баз знаний: · факты носят частный характер, а правила — общий · в БЗ включены только основополагающие факты. · на её основе построить ЭС. Отличие БД от БЗ: · база данных содержит только факты, · база знаний — факты и правила. · наличие механизма вывода у БЗ Интроспекция: Нахождение противоречий, нестыковок в БЗ, слежение за правильной организацией БЗ. Экспертная деятельность Под сложностью понимается обычно одни из следующих свойств и их комбинаций: · Большой по размерности. · Большое разнообразие связей и компонент. · Взаимодействие детерминируемых и стохастических частей. · Развивается во времени. · Включает человека, коллектив, социум. Для систем, обладающих данными признаками, часто осуществляют экспертную деятельность. Эксперт, анализирующий объект, независимо от природы объекта отвечает на следующие вопросы: · Какие оценки можно присвоить значениям различных переменных, характеризующих состояние объекта? · Какие тенденции развития (динамика значений переменных) характеризует объект? · Как охарактеризовать состояние объекта в целом? · Каков прогноз развития объекта? · Какие рекомендации, планы можно предложить для достижения целевого состояния объекта? · Преобразование чётких рядов в нечёткие – фазификация (Какие оценки сложно присвоить значениям различных переменных, характеризующих состояние объекта?) · Оценка тенденции нечёткого ВР (Какие тенденции развития (динамики значений переменных) характеризуют объект?) · Интегральная оценка (Как охарактеризовать состояние объекта в целом?). · Прогнозирование развития (Каков прогноз развития объекта?). · Планирование (Какие рекомендации, планы можно предложить для достижения целевого состояния объекта?). См. вопрос 3 Функция активации. Особенности структуры НС составляют: 1. вид связей, 2. функции активации, 3. постсинаптические элементы: · Линейный элемент вычисляет взвешенную сумму входов, что эквивалентно скалярному произведению векторов входов и весов, и сравнивает результат с порогом. Линейные ПСЭ разделяют пространство образцов с помощью пересекающихся гиперплоскостей. · Нелинейный элемент; · Радиальный элемент вычисляют квадрат расстояния между 2 точками пространства, представляющими вектор весов и входов. Радиальные ПСЭ эквивалентны гиперсферам в пространстве образцов. · Элемент деления специально разработаны исключительно для сетей регрессии. Сегодня многослойный перцептрон (МП) — это самая популярная архитектура, которая имеет линейные ПСЭ и нелинейные ФА.

Виды нейронных сетей. Классификация нейронных сетей связана с характером передачи сигнала, т.е. с наличием или отсутствием обратных связей. Среди нейронных сетей разделяют сети с прямым распределением сигнала и сети с обратными связями. 1. Сети прямого распространения сигнала называют слоистыми сетями или персептронами (от англ. perception – восприятие). Персептроновым слоем называют не совокупность нейронов, а совокупность связей одного уровня. Перцептрон – математическая модель фрагмента нейронной системы головного мозга, осуществляющего восприятие внешнего объекта. Первые перцептроны создавались как модель искусственного глаза. В настоящее время перцептрон представляет собой многослойную нейронную сеть прямого распространения сигнала, способную к обучению. 2. Сети с обратными связями или сети прямого и обратного распространения сигнала. Для сетей с обратными связями моделирование прохождения сигнала осложняется тем, что необходимо учитывать возврат сигнала. Обычно такое моделирование требует введение внутреннего времени (внутренних тактов срабатывания). Виды нейронных сетей НС без обратных связей · многослойные перцептроны; · сети Кохонена; · нейронные сети с радиальными базисными функциями; · байесовские сети регрессии; · байесовские вероятностные НС; · линейные многослойные перцептроны. Полносвязные сети Многослойный перцептрон – самая известная и очень старая архитектура, в которой идут подряд несколько слоев нейронов — входной, один или несколько скрытых слоев, и выходной слой. Почти всегда обучается методом обратного распространения ошибки — что автоматически означает, что мы должны предоставить для обучения набор пар «входной вектор — правильный выход». Сеть такого типа обычно очень хорошо справляется с задачами, где: 1. ответ зависит только от того, что мы даем на вход сети, и никак не зависит от истории входов. 2. ответ не зависит/слабо зависит от высоких степеней и/или произведений параметров — функции этого типа сеть строить почти не умеет. 3. в наличии есть достаточно много примеров. Сильные стороны — изучена со всех сторон, хорошо работает на своих задачах, если на некоторой задаче не работает (действительно не работает, а не по криворукости, как это бывает чаще всего) — то это повод утверждать, что задача сложнее, чем казалось. Слабые стороны — неумение работать с динамическими процессами, необходимость большой обучающей выборки. Перспективы — никаких существенных. Большинство серьезных задач, которые все еще требуют решения, не входят в класс задач, решаемых многослойным перцептроном c методом обратного распространения ошибки. Радиальная базисная нейронная сеть (РБНС) состоит из двух слоев: 1. скрытого радиального базисного слоя из S1 нейронов 2. выходного линейного слоя из S2 нейронов. Элементы первого слоя РБНС вычисляют расстояния между входным вектором и векторами весов первого слоя, сформированных из строк матрицы W2,1. Вектор порогов B и расстояния поэлементно умножаются. Выход первого слоя можно выразить формулой: Нейронные сети регрессии (НСР) имеют такой же, как и РБНС первый слой, но второй слой строится специальным образом. Для аппроксимации функций часто используются обобщенные сети регрессии. 1. Скрытый радиальный базисный слой из S1 нейронов 2. Второй слой как и в случае РБНС выполняет поэлементное произведение строки W1,2 и вектора выхода первого слоя a1. Целевое значение – это значение аппроксимируемой функции в обучающей выборке. Вероятностные нейронные сети (ВНС) используются для решения проблемы классификации: 1. Слой радиальных базисных нейронов, который вычисляет расстояние и вектор индикаторов принадлежности другим входным векторам, используемым при обучении. 2. Слой суммирует эти значения для каждого класса входов и формирует выходы сети, как вектор вероятностей. Далее ФА определяет максимум вероятностей на выходе 2 слоя и устанавливает данный выход в 1, а остальные выходы в 0. Сеть классифицирует входные вектора, назначая входу единственный класс на основе максимальной вероятности принадлежности. Обучение НС Нейронные сети, как вычислительные элементы, обладают универсальностью, и очень важным интеллектуальным свойством – обучаемостью. Обучением называется процесс настройки весов нейронной сети. Обучение отличается от программирования тем, что не является алгоритмической задачей, а строится аналогично обучению живых организмов. Классическим методом обучения нейронных сетей является обучение с учителем, когда на каждую реакцию нейронной сети поступает оценка, утверждающая правильная эта реакция или нет. Основными элементами процесса обучения являются следующие составляющие: 1. Обучающая выборка – по возможности полное представление различных представителей классифицируемых объектов. 2. Правила изменения весов – правило должно обеспечивать уменьшение ошибки распознавания объектов. 3. Тестовая выборка – объекты, не принадлежащие изучаемой выборке и предназначенные для тестирования процесса обучения.

Рисунок 3 Линейная однослойная НС Если задана обучающая выборка, т. е., несколько строк со следующей структурой <Входы Х11,..., Х1n - выходы Y11,..., Y1m >, то можно ввести обозначение К: Хк1,....Хкn и Yк1,....Yкm, где К – номер образца в обучающей выборке. Последовательно используя строки обучающей выборки, необходимо вычислить реакцию нейронной сети, т. е. ее выход при текущих значениях матрицы весов. Чтобы приблизить выход сети к желаемому значению, можно изменять вектор весов. Уточним. Необходимо найти вектор весов, который бы давал нам заданный выход:

См. вопрос 10 Сети Кохонена Нейронные сети Кохонена — класс нейронных сетей, основным элементом которых является слой Кохонена. Слой Кохонена состоит из адаптивных линейных сумматоров («линейных формальных нейронов»). Как правило, выходные сигналы слоя Кохонена обрабатываются по правилу «победитель забирает всё»: наибольший сигнал превращается в единичный, остальные обращаются в нуль. По способам настройки входных весов сумматоров и по решаемым задачам различают много разновидностей сетей Кохонена: · Сети векторного квантования сигналов, тесно связанные с простейшим базовым алгоритмом кластерного анализа (метод динамических ядер или K-средних) · Самоорганизующиеся карты · Сети векторного квантования, обучаемые с учителем · Самоорганизующиеся карты решают задачу классификации. У нее есть сколько-то центров и после обучения к каждому этому центру она будет относить объекты по принципу ближайшего соседства. Обучается алгоритмом без учителя. См. вопрос 3 Схема ГА. ГА – адаптивный метод поиска, применяемый для решения задач функциональной оптимизации. Каждая хромосома оценивается мерой её «приспособленности» (fitness function) – в методах оптимизации – целевая функция. Наиболее приспособленные особи получают возможность воспроизвести потомство с помощью «перекрёстного скрещивания». Наименее приспособленные особи постепенно исчезают из популяции в процессе эволюции.

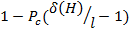

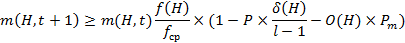

Рисунок 6 Общая схема ГА Оператор мутации Оператор мутации с определённой вероятностью заменяет случайный бит на противоположный. Вероятность мутации намного меньше, чем вероятность кроссовера. Сходимость ГА. Схема хромосомы – это строка длины l (длина любой строки популяции), состоящая из знаков алфавита {0; 1; *}, где знак * обозначает неопределенный символ. Порядок схемы – число определенных битов («0» или «1»). Длина схемы – расстояние между крайними определенными битами в схеме Строящими блоками называют схемы, обладающие высокой приспособленностью, низким порядком и короткой длиной. Сходимость алгоритма заключается в том, что он сходится к глобальному оптимуму. Стандартный ГА сходится. Дж. Голланд (1992) показал, что, если ГА явным образом обрабатывает n строк в каждом поколении, то он неявно обрабатывает порядка n3 коротких схем низкого порядка и с высокой приспособленностью. Это явление называется неявным параллелизмом. ГА экспоненциально увеличивает число примеров полезных схем или строящих блоков. Данное утверждение известно как «теорема схем». Острова – отдельные фрагменты популяции, оптимизируемые на определённом интервале времени автономным и обменивающиеся частями популяций с помощью определённого протокола. Теорема схем. Пусть t – номер поколения. H – число примеров полезной схемы, M(H, t) - число реализаций схемы H поколений t. Количество представителей схемы H в следующем поколение t+1 зависит от действия операции селекции и будет равно

fср – средняя приспособленность популяции, f. f(H) – средняя приспособленность тех строк в популяции, которые являются примерами H. Отобранные представители полезной схемы H могут быть разрушены последующим кроссинговерам, при этом вероятность разрушения длинной последовательности больше, чем у короткой. Вероятность, что схема переживёт кроссовер не меньше:

Кроме кроссинговера разрушаемой операцией является операция мутации. Если вероятность мутации Pm, а порядок схемы O(H), то вероятность разрушения можно определить по формуле O(H)• Pm, тогда окончательно соотношение между поколениями будет следующими:

Таким образом, теорема схем утверждает сходимость генетического алгоритма к стандартному максимуму. Общая сходимость генетического алгоритма к глобальному оптимуму не исключает обратного движения или деградации на отдельном участке развития генетического алгоритма. Теорема о сходимости доказана только для стандартного генетического алгоритма, а для мобильного генетического алгоритма эволюционной стратегии сходимость не обеспечивается, поэтому в случае использования алгоритмов таких видов сходимость приводит только к рациональному, в лучшем случае, приемлемому решению. С учётом значительной вычислительной затратности генетического алгоритма их необходимо распараллелить, причём распараллеливание ведётся за счёт распределения различных фрагментов исходной популяции по вычислителя, в результате возникли так называемые вычислительные алгоритмы с использованием островов. Методы гибридизации. Объединение программных инструментов для решения общей задачи может выполняться: 1. Комплексирование – объединение различных программ в единый комплекс, взаимодействие должно осуществляться только на основе общего формата данных. 2. Интеграция в единую программную систему – объединение не только на основе общего формата данных, но и на основе общего управления. Общее управление часто выполняет специальная главная программа, осуществляющая вызовы объединённых программ и передачу данных между ними. 3. Гибридизация – переработка алгоритма, различных методов с целью получения объединительного алгоритма с последовательной разработкой нового программного обеспечения. Например, для гибридизации нечётких систем и нейронных сетей необходимо не столько решить вопрос о формировании данных, сколько о том, какие лингвистические термины можно использовать на входе нейронных сетей, т.к. вход нейронных сетей числовой.

Связь лингвистического термина с числом в некоторых системах осуществляет функция принадлежности. Функция принадлежности может быть представлена в виде вектора чисел двумя способами: Способ 1 · Выделяем max интервал носителя [x1,x2], на котором осуществляется функция принадлежности. · Разделяем его на равные участки – кванты и для каждого значения xi определяем значение функции принадлежности µ(xi). В результате функция принадлежности представлена вектором знаний. 2. Способ 2 (метод a-срезов) · Интервал значений функции принадлежности [0, 1] делится на равные участки, каждой точке из этого интервала соответствует 2 точки функции принадлежности – точки левого и правого фронта. · Результирующий вектор формируется из множества получившихся пар точек.

Кроме преобразования лингвистического термина в числовую форму необходимо сохранить структуру правил нечёткой системы в нейронных сетях. Для этого используют специальные нейроны и специальную структуру нейронной сети. Специальными нейронами являются нейроны-функции принадлежности, логические «и-или» нейроны, нейроны, выполняющие импликацию. Данные нейроны могут быть получены из взвешенного суммирующего нейрона с помощью подбора коэффициентов. Но на практике используют специальные виды нейронов для повышения эффективности вычисления. В качестве специальной структуры нейронной сети используют специализацию слоёв сети: 1. Первый слой отвечает за распознавание функции принадлежности 2. Второй – за реализацию логической связки «и». 3. Третий – за реализацию логической связки «или». 4. Четвёртый выполняет импликацию. 5. Последний слой, выполняющий агрегацию, строится на классовых нейронах. Благодаря специализации структуры сохраняется объясняющая способность нечёткой системы.

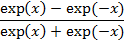

T-нормы

S-конормы

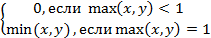

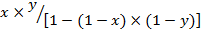

Монотонность Если x=u и y=v, то T(x,y)=T(u,v), S(x,y)=S(u,v) Специальные значениями T(0,y) = 0, S (0, y) = y; T(1,y) = y, S (1, y) = 1; Пары норм и конорм Каждая функция со свойствами Т называется Т-нормой, или триангулярной нормой, а со свойствами S – S-конормой, или триангулярной конормой. Для каждой пары справедливы следующие уравнения: T(х, у)= 1 - S(1-х,1- у), S(x, у) = 1 - Т(1- х, 1- у). Каждая пара триангулярных норм и конорм, которые подчиняются обобщенным отношениям де Моргана, называется парой относительных триангулярных норм. Все функции принадлежности (как для И, так и для ИЛИ-связок нечетких значений) выбираются такими же далекими друг от друга, как пары относительных триангулярных T-норм и S-конорм. Т-нормы выбираются для И, S-конормы — для ИЛИ. Пары норм и конорм

|

.

. , где

, где