Заглавная страница Избранные статьи Случайная статья Познавательные статьи Новые добавления Обратная связь FAQ Написать работу КАТЕГОРИИ: ТОП 10 на сайте Приготовление дезинфицирующих растворов различной концентрацииТехника нижней прямой подачи мяча. Франко-прусская война (причины и последствия) Организация работы процедурного кабинета Смысловое и механическое запоминание, их место и роль в усвоении знаний Коммуникативные барьеры и пути их преодоления Обработка изделий медицинского назначения многократного применения Образцы текста публицистического стиля Четыре типа изменения баланса Задачи с ответами для Всероссийской олимпиады по праву

Мы поможем в написании ваших работ! ЗНАЕТЕ ЛИ ВЫ?

Влияние общества на человека

Приготовление дезинфицирующих растворов различной концентрации Практические работы по географии для 6 класса Организация работы процедурного кабинета Изменения в неживой природе осенью Уборка процедурного кабинета Сольфеджио. Все правила по сольфеджио Балочные системы. Определение реакций опор и моментов защемления |

Лекция 2 Научные основы информатикиСодержание книги

Похожие статьи вашей тематики

Поиск на нашем сайте

2.1 Категории информатики 2.2 Аксиоматика информатики 2.3 Виды и свойства информации 2.4 Методы измерения информации Категории информатики Вся система категорий и понятий дисциплины информатика состоит из двух групп: - понятия, заимствованные из других наук; - понятия и аксиомы самой информатики. Группа 1. К ним относятся такие понятия, как информация, информационный шум, избыточность, точность, бит, байт и другие понятия математической теории связи. Из теории автоматического управления используются такие понятия, как цель управления, управляющая система, прямая и обратная связи и другие понятия других наук. Группа 2. К ним относятся: информационный ресурс, автоматизированные информационные системы, информационные технологии, энтропия, полезная работа ЭВМ, информационная среда, напряженность информационного поля, информационный поток, искусственный интеллект и другие понятия. Рассмотрим эти понятия на примере управляемых систем, в соответствии с рисунком 2.1. Энтропия (Э) – это мера отклонения от некоторого состояния, принимаемого за эталонное, оптимальное по критерию недоиспользования ИР. Т.е. это мера соответствия состояния управляемой системы ее целевой установке: Э = Хi - Ц, (2.1) где Э – энтропия объекта управления (ОУ); Хi – i -тое состояние ОУ; Ц – целевая функция управляющей системы (УС). Если Э=0, то состояние ОУ полностью соответствует целевой установке УС и о такой системе все известно, т.к. все известно о заданной целевой установке Ц. Информационная работа системы (ИРС) – это воздействие УС (Е) на ОУ путем выработки и передачи сообщений, обеспечивающих удержание объекта в исходном состоянии, а также перевод его в новое состояние для достижение новой цели.

Рисунок 2. 1 – Понятный аппарат информатики на примере управляемых систем Информационная работа имеет неэнтропийную природу, т.к. управляющее воздействие, т.е. цель всегда известны. Однако постановка новой цели объекту добавляет ему энтропию, т.е.: Ц1 + Ц2 = Эн, (2.2) где Ц1 – старая цель УС; Ц2 – новая цель УС; Эн – значение новой энтропии. Снятие новой энтропии требует дополнительной информационной работы. Таким образом, полезная информационная работа УС (ПИР) – это остаток от работы, затраченной на компенсацию энтропии самой УС (ЭУС), ее незнания в управлении, и исходной энтропии объекта (ЭОУ), а так же энтропии датчиков (Эд) системы:

ПИР = ЭЭВМ +ЭОУ+ЭД. (2.3) Информационная среда (ИС)– это весь набор условий для технологической переработки и эффективного использования знаний в системе. Напряженность информационного поля (НИП) – это та сила, с которой ОУ и его среда действуют на УС, вызывая ее действия по снятию возникшей новой энтропии, обеспечению достижения объектом новой цели в течение заданного времени. Информационный поток – полный поток M, воздействующий на объект за период его перехода в новое целевое состояние. Информационно – динамический объект (ИДО) – представляет собой АИС, управляющая система, которой выступает в виде творческой системы, создающей новые состояния объекта. Поэтому ИДО – это системы, в которых осуществляется обмен энергией в виде информационной и физической работы. Искусственный интеллект (ИИ) – искусственные системы, дублирующие функции (в пределах доступного) живых интеллектуальных систем. Инструментарием ИИ являются ЭВМ, роботы, экспертные системы, телекоммуникации. Творческая система – это интеллектуальные системы полного цикла, обеспечивающие переход знаний в силу, создающие объект. Они являются высшей формой информационных систем. Творческие системы созидают новые состояния объекта. Примером данных систем могут служить автоматизированные системы управления (АСУ), которые объединяют следующие подсистемы: - автоматизированные системы управления производством; - системы автоматизированного проектирования; - автоматизированные системы научных исследований и др. Аксиоматика информатики 2.2.1 Первая аксиома. Для сложных систем управления, состоящих из различных подсистем. К каждому элементу управляющей подсистемы идет исходный информационный поток от датчиков (рис. 2.1), равный

где N – количество сигналов, исходящих от наблюдателя; ЭС= ЭОУ · ЭД – энтропия этих сигналов ( 2.2.2 Вторая аксиома. Информационная напряженность каждого элемента управляющей системы

где Э j – энтропия j –го элемента УС; j = 1, m; m – число элементов в УС. При этом энтропия любого элемента управляющей системы является показателем его способности к творчеству: - если Э j = 1 – элемент управляющей системы воспринимает, ретранслирует команды и не вырабатывает собственной информации; - если Э j = 0 – элемент управляющей системы полностью осуществляет самостоятельное управление ОУ независимо от датчика; - если Э j = 0,5 – элемент управляющей системы в два раза усиливает направленный на него информационный поток. 2.2.3 Третья аксиома. Информационная напряженность всей управляющей системы равна сумме напряженности всех ее элементов, включая датчика:

2.2.4 Четвертая аксиома. Устанавливает зависимость между полным информационным потоком I полн, воздействующим на ОУ за период его перехода в новое целевое состояние, информационной напряженностью объекта Q и энергией E, затрачиваемой объектом управления на переход в новое состояние. Энергия, необходимая для перевода ОУ в новое целевое состояние, равна разности между информационной напряженностью УС и ее полным информационным потоком: E = Q – I полн. (2.7) 2.2.5 Пятая аксиома. Полный информационный поток I полн соответствует полезной работе управляющей системы за период перехода объекта в новое целевое состояние. 2.2.6 Шестая аксиома. Работа управляющей подсистемы A состоит из двух частей: А= b + c, (2.8) где b – внутренняя работа управляющей системы, затраченная на компенсацию ее исходной энтропии; c – внешняя работа, направленная на ОУ, т.е. информационная отдача УС. Чем выше исходная энтропия, тем большую внутреннюю работу должна осуществлять управляющая система. Виды и свойства информации Свойств любых объектов можно разделить на два больших класса. Внутренние – характеризующие свойства самого объекта, например, невидимость электромагнитного поля; Внешние – это свойства объекта, характеризующие его поведение при взаимодействии с другими объектами, например, при взаимодействии электромагнитного поля с проводниками возможно появление в проводниках ЭДС или электрического тока. Подобное разделение можно провести и для информации. С точки зрения потребителя можно выделить три группы внешних свойств информации. Качество информации – обобщенная характеристика, отражающая степень полезности ее для пользователя. Научность информации – логическая закономерность однозначно соответствующая закономерностям природы, общества, мышлению. Адекватность информации – свойство информации однозначно соответствовать отображаемому объекту или явлению. В свою очередь качество информации оценивается совокупностью критериев, которые характеризуют отдельные свойства информации: - релевантность – способность информации соответствовать нуждам (запросам) потребителя; - полнота – свойства информации исчерпывающе описывать отображаемый объект или процесс; - достоверность - свойства информации не иметь ошибок; - защищенность - свойства информации, характеризующее невозможность ее несанкционированного использования или изменения. По способу ее внутренней организации информацию можно разделить на две группы: - данные или логически неупорядоченный набор сведений; - логически упорядоченный набор данных. Ко второй группе относится особым образом организованная информация – базы знаний. Эти данные представляют собой информацию не о каком-то единичном факте, а о том, как устроены все факты определенного типа информации.

Методы измерения информации Как и любое физическое вещество информация имеет свои количественные характеристики. В современной информатике приняты следующие методы измерения информации: - объемный; - энтропийный; - алгоритмический. Объемный метод измерения характеризуется количеством символов, содержащихся в конкретном сообщении. В вычислительной технике вся информация, независимо от ее природы (текст, число, изображение и т.д.), представляется в двоичной форме записи, т.е. состоящей из различных комбинаций двух символов 0 и 1. Один такой символ в вычислительной технике называется битом, совокупность восьми таких символов называется байтом, а большое количество символов, которыми оперирует ЭВМ, называется словом. Энтропийный метод измерения информации используется в теории информации и кодирования. Он основывается на мере неопределенности появления некоторой совокупности событий и выражается вероятностью появления этих событий. Количество информации в сообщении при энтропийном методе оценки определяется тем, насколько уменьшается эта мера после получения сообщения. В теории информации используется следующая количественная мера: Э = log 2 m, где Э – энтропия; m – число возможных равновероятных событий. В случае, когда энтропия зависит не только от числа равновероятных событий выбора, но и от вероятности возможного выбора элемента информации К. Шеннон предложил следующую форму оценки энтропии: Э = log 2 (1/ Рi) = - log 2 Рi, где Рi – вероятность возможного выбора i -го элемента информации. Тогда среднее количество информации при m числе выборке с вероятностью Рi каждой выборки определится выражением:

Алгоритмическая оценка информации характеризуется сложностью (размером) алгоритма (программы), которая позволяет ее произвести. На разных машинах и разных языках программирования такая оценка может быть разной. Поэтому задаются некоторой вычислительной машиной (например, элементарной машиной Тьюринга), а предлагаемая количественная оценка информации определяется сложностью слова, как минимальное число внутренних состояний машины, требуемой для его воспроизведения. Структурная схема машины Тьюринга приведена на рисунке 2.2.

Рисунок 2.2 – Структурная схема машины Тьюринга На рисунке 2.2 обозначено:

УУ – управляющее устройство; СГ – считывающая головка; Лента – источник информации бесконечная лента. Управляющее устройство УУ определяет положение считывающей головки СГ { qi }. В каждой ячейке ленты записан символ { ai }. Таким образом, состояние машины { si } определится выражением: Si = qi × ai Следующее перемещение ленты задается параметром { pi }. Тогда новое состояние машины определится следующим образом: Si+1 = qi × ai × pi. Таким образом, полное состояние машины Тьюринга можно задать, определив множества Q{qi}, A{ai}, P{pi}. Алгоритм определения состояния машины Тьюринга является единицей алгоритмического метода оценки информации. Лекция 3 Системы счисления 3.1 Основные понятия 3.2 Двоичная система счисления 3.3 Смешанные системы счисления 3.4 Перевод чисел в системах счисления Основные понятия Системой счисления называется совокупность приемов наименования и записи чисел. При этом в любой системе счисления для представления чисел выбираются некоторые символы, которые называются базисными символами, а все остальные числа получаются в результате операций над базисными символами. В современном мире широко распространена десятичная система счисления, которая представлена десятью базисными символами: 0,1,2,3,4,5,6.7,8,9. Получение любых других чисел обеспечивается за счет различного позиционного сочетания базовых символов, например, число 1604 представлено всего четырьмя базисными символами, расположенными в соответствующих местах: 1 6 0 4 В римской системе счисления базисными символами являются числа 1, 5, 10, 50, 100, 500, 1000 с соответствующими знаковыми обозначениями: I, V, X, L, C, D, M. При этом другие числа получаются сложением или вычитанием базисного символа по следующему алгоритму: - если цифра справа меньше или равна цифре слева, то эти цифры складываются; - если цифра слева меньше, чем цифра справа то левая цифра вычитается из правой цифры. Так, например, число 14610 десятичной системы счисления в римской системе счисления имеет вид: CXLVI, где С – 10010, XL -4010, VI – 610. Системы счисления, в которых любое число получается путем сложения или вычитания базисных символов называются аддитивными. Например, римская система счислений. Системы счисления, в которых любое число представляется только позиционным весом базовой цифры, называются позиционными. Например, десятичная система, в которой значение цифры (ее вес) изменяется в зависимости от ее положения (позиции) в последовательности цифр, обозначающих число. При этом, система счислений основывается на том, что десять единиц каждого разряда объединяются в одну единицу соседнего старшего разряда, а каждый разряд имеет вес равный степени 10. Для числа 525,3510 цифра 5 повторена три раза, но каждый раз она означает различное число, а рассмотренное число можно представить следующим образом: 525, 35 = Таким образом, десятичная система записи любого числа Х 10 в виде последовательности цифр имеет вид:

и основывается на представлении этого числа в виде полинома

где каждый коэффициент

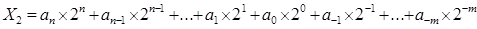

Определение. Число К единиц какого-либо разряда, объединенных в единицу старшего разряда называется основанием позиционной системы. Так, например, для десятичной системы объединением цифр 1 и 0 образуется старший разряд, т.е. основанием системы является число 10. Для двоичной системы К = 2, для троичной системы К=3, для восьмеричной системы К=8 и т. д. Двоичная система счисления В современной вычислительной технике, устройствах автоматики и связи широко используется двоичная система счислений, в которой для изображения числа используются только две базисные цифры: 0 и 1. При этом перевод числа в старший разряд определяется цифрой 2, которой в двоичной системе соответствует число 102. Таким образом, произвольное число Х в двоичной системе представляется в виде полинома следующего вида:

где каждый коэффициент Так, например изображения чисел десятичной системы в двоичной системе имеет вид: 010 - 02 110 - 12 210 - 102 310 - 112 410 - 1002 510 - 1012 610 - 1102 710 - 1112 810 - 10002 910 - 10012, где цифры 2 и 10 при значении каждого числа указывают его систему счислений. Таблица сложений для двоичной системы счислений имеет вид: 0+0=0 1+0=1 0+1=1 1+1=10 Таблица умножения в двоичной системе счислений имеет вид: 0х0=0 1х0=0 0х1=0 1х1=1 Так как в двоичной системе счислений при изображении любого числа используются только две цифры 0 и 1, то все электронные элементы ЭВМ могут находится только в дух состояниях: 1 - включено или 0 - выключено, а простота арифметических операций является причиной того, что современные ЭВМ используют двоичную систему счислений. Смешанные системы счисления Неудобство использования двоичной системы счисления из-за громоздкости записи чисел, особенно при разработке программ на машинном языке, привели к использованию восьмеричной и шестнадцатеричной систем счисления. В восьмеричной системе счисления базовыми цифрами являются: 0, 1, 2, 3, 4, 5, 6, 7. А запись любого числа в этой системе основывается на его разложении по степеням числа восемь с коэффициентами из базовых цифр. Например, число 8310 десятичной системы можно представить следующим образом: 8310 =6410+1610+310= В шестнадцатеричной системе счисления базисными являются цифры от 0 до 15. В этой системе для обозначения всех базисных цифр не хватает цифр десятеричной системы, поэтому для обозначения первых десяти цифр используют цифры десятичной системы от 0 до 9, а для обозначения последующих шести цифр используют буквы: 10 – a, 11 – b, 12 – c, 13 – d, 14 – e, 15 – f. Поэтому, например, число десятичной системы 175,510 в шестнадцатеричной системе имеет вид: 175,510= 16010 + 1510+ 810/1610= В ряде случаев, числа, заданные в одной системе счисления приходится изображать с помощью цифр другой системы счисления. Например, десятичные числа, с которыми мы привыкли работать, необходимо переводить в двоичные, с которыми должна работать ЭВМ. В этих случаях используются смешанные системы счисления, в которых каждый коэффициент Р -ичного разложения числа записывается в Q -ичной системе. В такой системе Р называется старшим основанием, а Q - младшим основанием, а сама система счисления называется Q-Р -ичной.. Для того, чтобы запись числа в смешанной системе счисления была однозначной, на представление любой Р -ичной цифры отводится одно и то же количество Q -ичных разрядов, достаточное для представления максимального числа Р -ичной системы. Так, для изображения числа в двоично-десятичной системе необходимо отвести четыре двоичных разряда потому, что максимальная цифра десятичной системы 910 отображается числом двоичной системы 10012, состоящей из четырех двоичных разрядов. Так например, число 19510 десятичной системы запишется в двоично-десятичной системе в виде: 0001 1001 01012-10, где последовательные тетраэды (четверки) двоичных чисел изображают цифры 1, 9, 5, записи числа в десятичной системе счисления. При решении задач с помощью ЭВМ исходные данные задаются обычно в десятичной системе, полученные решения также представляются в десятичной системе, а непосредственно в машине они могут обрабатываться в двоичной или восьмеричной, или в другой системе счисления. Таким образом, возникает необходимость перевода чисел из одной системы в другую.

|

||||||||||||||||||||||||||

|

Последнее изменение этой страницы: 2017-02-07; просмотров: 529; Нарушение авторского права страницы; Мы поможем в написании вашей работы! infopedia.su Все материалы представленные на сайте исключительно с целью ознакомления читателями и не преследуют коммерческих целей или нарушение авторских прав. Обратная связь - 52.14.138.123 (0.011 с.) |

, (2.4)

, (2.4) ).

). определяется информационным воздействием на него датчика (исходным информационным потоком) с учетом энтропии данного элемента:

определяется информационным воздействием на него датчика (исходным информационным потоком) с учетом энтропии данного элемента: ; (2.5)

; (2.5) . (2.6)

. (2.6)

,

, может быть одним из базисных чисел.

может быть одним из базисных чисел. ,

, может быть одним из базисных чисел 0 или 1.

может быть одним из базисных чисел 0 или 1. = 1238

= 1238 = af,816

= af,816