Заглавная страница Избранные статьи Случайная статья Познавательные статьи Новые добавления Обратная связь FAQ Написать работу КАТЕГОРИИ: ТОП 10 на сайте Приготовление дезинфицирующих растворов различной концентрацииТехника нижней прямой подачи мяча. Франко-прусская война (причины и последствия) Организация работы процедурного кабинета Смысловое и механическое запоминание, их место и роль в усвоении знаний Коммуникативные барьеры и пути их преодоления Обработка изделий медицинского назначения многократного применения Образцы текста публицистического стиля Четыре типа изменения баланса Задачи с ответами для Всероссийской олимпиады по праву

Мы поможем в написании ваших работ! ЗНАЕТЕ ЛИ ВЫ?

Влияние общества на человека

Приготовление дезинфицирующих растворов различной концентрации Практические работы по географии для 6 класса Организация работы процедурного кабинета Изменения в неживой природе осенью Уборка процедурного кабинета Сольфеджио. Все правила по сольфеджио Балочные системы. Определение реакций опор и моментов защемления |

Полигон частот. Выборочная функция распределения и гистограмма.Содержание книги

Похожие статьи вашей тематики

Поиск на нашем сайте

Для наглядного представления о поведении исследуемой случайной величины в выборке можно строить различные графики. Один из них – полигон частот: ломаная, отрезки которой соединяют точки с координатами (x 1, n 1), (x 2, n 2),…, (xk, nk), где xi откладываются на оси абсцисс, а ni – на оси ординат. Если на оси ординат откладывать не абсолютные (ni), а относительные (wi) частоты, то получим полигон относительных частот (рис.1). По аналогии с функцией распределения случайной величины можно задать некоторую функцию, относительную частоту события X < x. Определение 15.1. Выборочной (эмпирической) функцией распределения называют функцию F* (x), определяющую для каждого значения х относительную частоту события X < x. Таким образом,

где пх – число вариант, меньших х, п – объем выборки. Замечание. В отличие от эмпирической функции распределения, найденной опытным путем, функцию распределения F (x) генеральной совокупности называют теоретической функцией распределения. F (x) определяет вероятность события X < x, а F* (x) – его относительную частоту. При достаточно больших п, как следует из теоремы Бернулли, F* (x) стремится по вероятности к F (x). Из определения эмпирической функции распределения видно, что ее свойства совпадают со свойствами F (x), а именно: 1) 0 ≤ F* (x) ≤ 1. 2) F* (x) – неубывающая функция. 3) Если х 1 – наименьшая варианта, то F* (x) = 0 при х ≤ х 1; если хк – наибольшая варианта, то F* (x) = 1 при х > хк. Для непрерывного признака графической иллюстрацией служит гистограмма, то есть ступенчатая фигура, состоящая из прямоугольников, основаниями которых служат частичные интервалы длиной h, а высотами – отрезки длиной ni /h (гистограмма частот) или wi /h (гистограмма относительных частот). В первом случае площадь гистограммы равна объему выборки, во втором – единице (рис.2).

Вопрос 5. Оценка числовых характеристик

Закон распределения (функция распределения и ряд распределения или плотность вероятности) полностью описывают поведение случайной величины. Но в ряде задач достаточно знать некоторые числовые характеристики исследуемой величины (например, ее среднее значение и возможное отклонение от него), чтобы ответить на поставленный вопрос. Рассмотрим основные числовые характеристики дискретных случайных величин.

Математическое ожидание

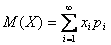

Определение 7.1. Математическим ожиданием дискретной случайной величины называется сумма произведений ее возможных значений на соответствующие им вероятности: М (Х) = х 1 р 1 + х 2 р 2 + … + хпрп. (7.1) Если число возможных значений случайной величины бесконечно, то Замечание 1. Математическое ожидание называют иногда взвешенным средним, так как оно приближенно равно среднему арифметическому наблюдаемых значений случайной величины при большом числе опытов. Замечание 2. Из определения математического ожидания следует, что его значение не меньше наименьшего возможного значения случайной величины и не больше наибольшего. Замечание 3. Математическое ожидание дискретной случайной величины есть неслучайная (постоянная) величина. В дальнейшем увидим, что это же справедливо и для непрерывных случайных величин.

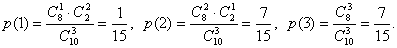

Пример 1. Найдем математическое ожидание случайной величины Х – числа стандартных деталей среди трех, отобранных из партии в 10 деталей, среди которых 2 бракованных. Составим ряд распределения для Х. Из условия задачи следует, что Х может принимать значения 1, 2, 3.

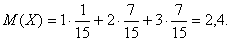

Пример 2. Определим математическое ожидание случайной величины Х – числа бросков монеты до первого появления герба. Эта величина может принимать бесконечное число значений (множество возможных значений есть множество натуральных чисел). Ряд ее распределения имеет вид:

Тогда

+ Свойства математического ожидания. 1) Математическое ожидание постоянной равно самой постоянной: М (С) = С. (7.2) Доказательство. Если рассматривать С как дискретную случайную величину, принимающую только одно значение С с вероятностью р = 1, то М (С) = С ·1 = С. 2) Постоянный множитель можно выносит за знак математического ожидания: М (СХ) = С М (Х). (7.3) Доказательство. Если случайная величина Х задана рядом распределения

то ряд распределения для СХ имеет вид:

Тогда М (СХ) = Сх 1 р 1 + Сх 2 р 2 + … + Схпрп = С (х 1 р 1 + х 2 р 2 + … + хпрп) = СМ (Х). Определение 7.2. Две случайные величины называются независимыми, если закон распределения одной из них не зависит от того, какие значения приняла другая. В противном случае случайные величины зависимы. Определение 7.3. Назовем произведением независимых случайных величин Х и Y случайную величину XY, возможные значения которой равны произведениям всех возможных значений Х на все возможные значения Y, а соответствующие им вероят-ности равны произведениям вероятностей сомножителей. 3) Математическое ожидание произведения двух независимых случайных величин равно произведению их математических ожиданий: M (XY) = M (X) M (Y). (7.4) Доказательство. Для упрощения вычислений ограничимся случаем, когда Х и Y принимают только по два возможных значения:

Тогда ряд распределения для XY выглядит так:

Следовательно, M (XY) = x 1 y 1· p 1 g 1 + x 2 y 1· p 2 g 1 + x 1 y 2· p 1 g 2 + x 2 y 2· p 2 g 2 = y 1 g 1(x 1 p 1 + x 2 p 2) + + y 2 g 2(x 1 p 1 + x 2 p 2) = (y 1 g 1 + y 2 g 2) (x 1 p 1 + x 2 p 2) = M (X)· M (Y). Замечание 1. Аналогично можно доказать это свойство для большего количества возможных значений сомножителей. Замечание 2. Свойство 3 справедливо для произведения любого числа независимых случайных величин, что доказывается методом математической индукции. Определение 7.4. Определим сумму случайных величин Х и Y как случайную величину Х +Y, возможные значения которой равны суммам каждого возможного значения Х с каждым возможным значением Y; вероятности таких сумм равны произведениям вероятностей слагаемых (для зависимых случайных величин – произведениям вероятности одного слагаемого на условную вероятность второго). 4) Математическое ожидание суммы двух случайных величин (зависимых или незави-симых) равно сумме математических ожиданий слагаемых: M (X + Y) = M (X) + M (Y). (7.5) Доказательство. Вновь рассмотрим случайные величины, заданные рядами распределения, приведен-ными при доказательстве свойства 3. Тогда возможными значениями X + Y являются х 1 + у 1, х 1 + у 2, х 2 + у 1, х 2 + у 2. Обозначим их вероятности соответственно как р 11, р 12, р 21 и р 22. Найдем М (Х + Y) = (x 1 + y 1) p 11 + (x 1 + y 2) p 12 + (x 2 + y 1) p 21 + (x 2 + y 2) p 22 = = x 1(p 11 + p 12) + x 2(p 21 + p 22) + y 1(p 11 + p 21) + y 2(p 12 + p 22). Докажем, что р 11 + р 22 = р 1. Действительно, событие, состоящее в том, что X + Y примет значения х 1 + у 1 или х 1 + у 2 и вероятность которого равна р 11 + р 22, совпадает с событием, заключающемся в том, что Х = х 1 (его вероятность – р 1). Аналогично дока-зывается, что p 21 + p 22= р 2, p 11 + p 21 = g 1, p 12 + p 22 = g 2. Значит, M (X + Y) = x 1 p 1 + x 2 p 2 + y 1 g 1 + y 2 g 2 = M (X) + M (Y). Замечание. Из свойства 4 следует, что сумма любого числа случайных величин равна сумме математических ожиданий слагаемых. Пример. Найти математическое ожидание суммы числа очков, выпавших при броске пяти игральных костей. Найдем математическое ожидание числа очков, выпавших при броске одной кости: М (Х 1) = (1 + 2 + 3 + 4 + 5 + 6)

Дисперсия. Для того, чтобы иметь представление о поведении случайной величины, недостаточно знать только ее математическое ожидание. Рассмотрим две случайные величины: Х и Y, заданные рядами распределения вида

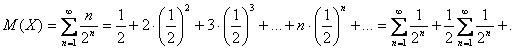

Найдем М (Х) = 49·0,1 + 50·0,8 + 51·0,1 = 50, М (Y) = 0·0,5 + 100·0,5 = 50. Как видно, математические ожидания обеих величин равны, но если для Х М (Х) хорошо описывает поведение случайной величины, являясь ее наиболее вероятным возможным значением (причем остальные значения ненамного отличаются от 50), то значения Y существенно отстоят от М (Y). Следовательно, наряду с математическим ожиданием желательно знать, насколько значения случайной величины отклоняются от него. Для характеристики этого показателя служит дисперсия. Определение 7.5. Дисперсией (рассеянием) случайной величины называется математическое ожидание квадрата ее отклонения от ее математического ожидания: D (X) = M (X – M (X))². (7.6) Пример. Найдем дисперсию случайной величины Х (числа стандартных деталей среди отобранных) в примере 1 данной лекции. Вычислим значения квадрата отклонения каждого возможного значения от математического ожидания: (1 – 2,4)2 = 1,96; (2 – 2,4)2 = 0,16; (3 – 2,4)2 = 0,36. Следовательно,

Замечание 1. В определении дисперсии оценивается не само отклонение от среднего, а его квадрат. Это сделано для того, чтобы отклонения разных знаков не компенсировали друг друга. Замечание 2. Из определения дисперсии следует, что эта величина принимает только неотрицательные значения. Замечание 3. Существует более удобная для расчетов формула для вычисления дисперсии, справедливость которой доказывается в следующей теореме: Теорема 7.1. D (X) = M (X ²) – M ²(X). (7.7) Доказательство. Используя то, что М (Х) – постоянная величина, и свойства математического ожидания, преобразуем формулу (7.6) к виду: D (X) = M (X – M (X))² = M (X ² - 2 X·M (X) + M ²(X)) = M (X ²) – 2 M (X)· M (X) + M ²(X) = = M (X ²) – 2 M ²(X) + M ²(X) = M (X ²) – M ²(X), что и требовалось доказать. Пример. Вычислим дисперсии случайных величин Х и Y, рассмотренных в начале этого раздела. М (Х) = (492·0,1 + 502·0,8 + 512·0,1) – 502 = 2500,2 – 2500 = 0,2. М (Y) = (02·0,5 + 100²·0,5) – 50² = 5000 – 2500 = 2500. Итак, дисперсия второй случайной величины в несколько тысяч раз больше дисперсии первой. Таким образом, даже не зная законов распределения этих величин, по известным значениям дисперсии мы можем утверждать, что Х мало отклоняется от своего математического ожидания, в то время как для Y это отклонение весьма существенно. Свойства дисперсии. 1) Дисперсия постоянной величины С равна нулю: D (C) = 0. (7.8) Доказательство. D (C) = M ((C – M (C))²) = M ((C – C)²) = M (0) = 0. 2) Постоянный множитель можно выносить за знак дисперсии, возведя его в квадрат: D (CX) = C ² D (X). (7.9) Доказательство. D (CX) = M ((CX – M (CX))²) = M ((CX – CM (X))²) = M (C ²(X – M (X))²) = = C ² D (X). 3) Дисперсия суммы двух независимых случайных величин равна сумме их дисперсий: D (X + Y) = D (X) + D (Y). (7.10) Доказательство. D (X + Y) = M (X ² + 2 XY + Y ²) – (M (X) + M (Y))² = M (X ²) + 2 M (X) M (Y) + + M (Y ²) – M ²(X) – 2 M (X) M (Y) – M ²(Y) = (M (X ²) – M ²(X)) + (M (Y ²) – M ²(Y)) = D (X) + D (Y). Следствие 1. Дисперсия суммы нескольких взаимно независимых случайных величин равна сумме их дисперсий. Следствие 2. Дисперсия суммы постоянной и случайной величин равна дисперсии случайной величины. 4) Дисперсия разности двух независимых случайных величин равна сумме их дисперсий: D (X – Y) = D (X) + D (Y). (7.11) Доказательство. D (X – Y) = D (X) + D (- Y) = D (X) + (-1)² D (Y) = D (X) + D (X). Дисперсия дает среднее значение квадрата отклонения случайной величины от среднего; для оценки самого отклонения служит величина, называемая средним квадратическим отклонением. Определение 7.6. Средним квадратическим отклонением σ случайной величины Х называется квадратный корень из дисперсии:

Пример. В предыдущем примере средние квадратические отклонения Х и Y равны соответственно

|

||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

Последнее изменение этой страницы: 2016-04-25; просмотров: 729; Нарушение авторского права страницы; Мы поможем в написании вашей работы! infopedia.su Все материалы представленные на сайте исключительно с целью ознакомления читателями и не преследуют коммерческих целей или нарушение авторских прав. Обратная связь - 3.149.29.190 (0.011 с.) |

Рис. 1.

Рис. 1. , (15.1)

, (15.1) Рис.2.

Рис.2. , если полученный ряд сходится абсолютно.

, если полученный ряд сходится абсолютно. Тогда

Тогда

..+

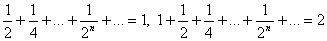

..+ (при вычислении дважды использовалась формула суммы бесконечно убывающей геометрической прогрессии:

(при вычислении дважды использовалась формула суммы бесконечно убывающей геометрической прогрессии:  , откуда

, откуда  ).

). Тому же числу равно математическое ожидание числа очков, выпавших на любой кости. Следовательно, по свойству 4 М (Х)=

Тому же числу равно математическое ожидание числа очков, выпавших на любой кости. Следовательно, по свойству 4 М (Х)=

. (7.12)

. (7.12)