Заглавная страница Избранные статьи Случайная статья Познавательные статьи Новые добавления Обратная связь FAQ Написать работу КАТЕГОРИИ: ТОП 10 на сайте Приготовление дезинфицирующих растворов различной концентрацииТехника нижней прямой подачи мяча. Франко-прусская война (причины и последствия) Организация работы процедурного кабинета Смысловое и механическое запоминание, их место и роль в усвоении знаний Коммуникативные барьеры и пути их преодоления Обработка изделий медицинского назначения многократного применения Образцы текста публицистического стиля Четыре типа изменения баланса Задачи с ответами для Всероссийской олимпиады по праву

Мы поможем в написании ваших работ! ЗНАЕТЕ ЛИ ВЫ?

Влияние общества на человека

Приготовление дезинфицирующих растворов различной концентрации Практические работы по географии для 6 класса Организация работы процедурного кабинета Изменения в неживой природе осенью Уборка процедурного кабинета Сольфеджио. Все правила по сольфеджио Балочные системы. Определение реакций опор и моментов защемления |

О решении нелинейных систем методами спускаСодержание книги Похожие статьи вашей тематики

Поиск на нашем сайте

Общий недостаток всех рассмотренных выше методов решения систем нелинейных уравнений — это сугубо локальный характер сходимости, затрудняющий их применение в случаях (довольно типичных), когда имеются проблемы с выбором хороших начальных приближений. Помощь здесь может прийти со стороны численных методов оптимизации — ветви вычислительной математики, обычно выделяемой в самостоятельную дисциплину. Для этого нужно поставить задачу нахождения решений данной нелинейной системы как оптимизационную или, иначе, экстремальную задачу. Ради геометрической интерпретации проводимых ниже рассуждений и их результатов ограничимся рассмотрением системы, состоящей из двух уравнений с двумя неизвестными (4.3.1). Из функций f u g системы (4.3.1) образуем новую функцию

Так как эта функция неотрицательна, то найдется точка (х*, у*)такая, что

т.е. (х*, у*)= argminФ(x, у). Следовательно, если тем или иным способом удается получить точку (х*, у*), минимизирующую функцию Ф(х,у), и если при этом окажется, что min Ф(х,y) = Ф(х*, у*)=0, то (х*, у*) - искомое решение системы (4.3.1), поскольку

Последовательность точек (

где Итак, при построении численного метода вида (4.5.2) минимизации функции Ф(х, у)следует ответить на два главных вопроса: как выбирать направление спуска При выборе направления спуска естественным является выбор такого направления, в котором минимизируемая функция убывает наиболее быстро. Как известно из математического анализа функций нескольких переменных, направление наибольшего возрастания функции в данной точке показывает ее градиент в этой точке. Поэтому примем за направление спуска вектор

— антиградиент функции Ф(х, у). Таким образом, из семейства методов (4.5.2) выделяем градиентный метод

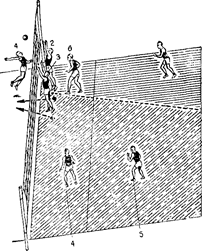

Оптимальный шаг в направлении антиградиента —- это такой шаг, при котором значение Геометрическая интерпретация этого метода хорошо видна из рис. 1, 2. Характерны девяностоградусные изломы траектории наискорейшего спуска, что объясняется исчерпываемостью спуска и свойством градиента (а значит, и антиградиента) быть перпендикулярным к касательной к линии уровня в соответствующей точке

Рис. 1. Пространственная интер- Рис. 2. Траектория наискорей-претация метода наискорейшего шего спуска для функции (4.5.1) спуска для функции (4.5.1)

Наиболее типичной является ситуация, когда найти точно (аналитическими методами) оптимальное значение ак не удается. Следовательно, приходится делать ставку на применение каких-либо численных методов одномерной минимизации и находить ак лишь приближенно. Несмотря на то, что задача нахождения минимума функции одной переменной Зачастую успешной является такая стратегия градиентного метода, при которой шаговый множитель ак в (4.5.3) берется либо сразу достаточно малым постоянным, либо предусматривается его уменьшение, например, делением пополам для удовлетворения условию релаксации на очередном шаге. Хотя каждый отдельный шаг градиентного метода при этом, вообще говоря, далек от оптимального, такой процесс по количеству вычислений функции может оказаться более эффективным, чем метод наискорейшего спуска. Главное достоинство градиентных методов решения нелинейных систем — глобальная сходимость. Нетрудно доказать, что процесс градиентного спуска приведет к какой-либо точке минимума функции из любой начальной точки. При определенных условиях найденная точка минимума будет искомым решением исходной нелинейной системы. Главный недостаток — медленная сходимость. Доказано, что сходимость таких методов — лишь линейная, причем, если для многих методов, таких как метод Ньютона, характерно ускорение сходимости при приближении к решению, то здесь имеет место скорее обратное. Поэтому есть резон в построении гибридных алгоритмов, которые начинали бы поиск искомой точки — решения данной нелинейной системы — глобально сходящимся градиентным методом, а затем производили уточнение каким-то быстросходящимся методом, например, методом Ньютона (разумеется, если данные функции обладают нужными свойствами). Разработан ряд методов решения экстремальных задач, которые соединяют в себе низкую требовательность к выбору начальной точки и высокую скорость сходимости. К таким методам, называемым квазиньютоновскими, можно отнести, например, метод переменной метрики (Дэвидона-Флетчера-Пауэлла), симметричный и положительно определенный методы секущих. При наличии негладких функций в решаемой задаче следует отказаться от использования производных или их аппроксимаций и прибегнуть к так называемым методам прямого поиска (циклического покоординатного спуска, Хука иДживса, Розенброка и т.п.).

Практическая часть Вычисление погрешностей Задание Пусть a, b, y – приближенные числа с верными в строгом смысле значащими цифрами, х – верное число. Вычислите:

Оцените погрешность результата. Результаты расчетов расположите в таблице. Решение Представлено на рисунке 1.1.

Рисунок 1.1 – Результаты расчетов.

|

||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

Последнее изменение этой страницы: 2016-08-15; просмотров: 917; Нарушение авторского права страницы; Мы поможем в написании вашей работы! infopedia.su Все материалы представленные на сайте исключительно с целью ознакомления читателями и не преследуют коммерческих целей или нарушение авторских прав. Обратная связь - 216.73.216.141 (0.011 с.) |

. (4.5.1)

. (4.5.1)

,

,

) — приближений к точке (х*; у*) минимума Ф(х, у)— обычно получают по рекуррентной формуле

) — приближений к точке (х*; у*) минимума Ф(х, у)— обычно получают по рекуррентной формуле , k =0,1,2,..., (4.5.2)

, k =0,1,2,..., (4.5.2) — вектор, определяющий направление минимизации, а ак - скалярная величина, характеризующая величину шага минимизации (шаговый множитель). Учитывая геометрический смысл задачи минимизации функции двух переменных Ф(х,.у) — «спуск на дно» поверхности z=Ф(x,y) (см. рис.1), итерационный метод (4.5.2) можно назвать методом спуска, если вектор

— вектор, определяющий направление минимизации, а ак - скалярная величина, характеризующая величину шага минимизации (шаговый множитель). Учитывая геометрический смысл задачи минимизации функции двух переменных Ф(х,.у) — «спуск на дно» поверхности z=Ф(x,y) (см. рис.1), итерационный метод (4.5.2) можно назвать методом спуска, если вектор  такое, что

такое, что  и если множитель ак подбирается так, чтобы выполнялось условие релаксации

и если множитель ак подбирается так, чтобы выполнялось условие релаксации  , означающее переход на каждой итерации в точку с меньшим значением минимизируемой функции.

, означающее переход на каждой итерации в точку с меньшим значением минимизируемой функции.

. (4.5.3)

. (4.5.3) — наименьшее среди всех других значений Ф(х,у)в этом фиксированном направлении, т.е. когда точка (

— наименьшее среди всех других значений Ф(х,у)в этом фиксированном направлении, т.е. когда точка ( )является точкой условного минимума. Следовательно, можно рассчитывать на наиболее быструю сходимость метода (4.5.3), если полагать в нем такой выбор шагового множителя, называемый исчерпывающим спуском, вместе с формулой (4.5.3) определяет метод наискорейшего спуска.

)является точкой условного минимума. Следовательно, можно рассчитывать на наиболее быструю сходимость метода (4.5.3), если полагать в нем такой выбор шагового множителя, называемый исчерпывающим спуском, вместе с формулой (4.5.3) определяет метод наискорейшего спуска.

намного проще, чем решаемая задача, применение тех или иных численных методов нахождения значений

намного проще, чем решаемая задача, применение тех или иных численных методов нахождения значений  той или иной точностью требует вычисления нескольких значений минимизируемой функции. Так как это нужно делать на каждом итерационном шаге, то при большом числе шагов реализация метода наискорейшего спуска в чистом виде является достаточно высокозатратной. Существуют эффективные схемы приближенного вычисления квазиоптимальных ак, в которых учитывается специфика минимизируемых функций (типа сумм квадратов функций).

той или иной точностью требует вычисления нескольких значений минимизируемой функции. Так как это нужно делать на каждом итерационном шаге, то при большом числе шагов реализация метода наискорейшего спуска в чистом виде является достаточно высокозатратной. Существуют эффективные схемы приближенного вычисления квазиоптимальных ак, в которых учитывается специфика минимизируемых функций (типа сумм квадратов функций).