Заглавная страница Избранные статьи Случайная статья Познавательные статьи Новые добавления Обратная связь FAQ Написать работу КАТЕГОРИИ: ТОП 10 на сайте Приготовление дезинфицирующих растворов различной концентрацииТехника нижней прямой подачи мяча. Франко-прусская война (причины и последствия) Организация работы процедурного кабинета Смысловое и механическое запоминание, их место и роль в усвоении знаний Коммуникативные барьеры и пути их преодоления Обработка изделий медицинского назначения многократного применения Образцы текста публицистического стиля Четыре типа изменения баланса Задачи с ответами для Всероссийской олимпиады по праву

Мы поможем в написании ваших работ! ЗНАЕТЕ ЛИ ВЫ?

Влияние общества на человека

Приготовление дезинфицирующих растворов различной концентрации Практические работы по географии для 6 класса Организация работы процедурного кабинета Изменения в неживой природе осенью Уборка процедурного кабинета Сольфеджио. Все правила по сольфеджио Балочные системы. Определение реакций опор и моментов защемления |

Истоки вычислительной моделиСодержание книги

Поиск на нашем сайте

В программу моего обучения в Гарварде входило «Общее образование». На практике это означало, что если я способен объяснить, для чего мне нужен тот или иной курс, то могу его посещать. Поэтому, заручившись благословением – или, во всяком случае, подписью – своего научного руководителя, Нобелевского лауреата Шелдона Глэшоу, я составил для себя программу сам. Ее основными элементами были лекции Роберта Фитцджеральда о просодии и Гомере, Вергилии и Данте, а также лекции Леона Кирхнера о камерной музыке и семинар Бернарда Коэна «Влияние физики на общество». Глэшоу также настоял на том, чтобы я прослушал немного лекций по физике. Я выбрал два курса, с которых начался мой путь к вычислительной модели Вселенной. Первым был курс Майкла Тинкэма по статистической механике, замечательный синтез квантовой механики (физики атомов и молекул) и термодинамики (тепло и работа). Как наука статистическая механика возникла в последние годы XIX в. и привела к созданию лазеров, электрических лампочек, транзисторов и многих других изобретений. Основная идея курса Тинкэма состояла в том, что термодинамическая величина, известная как энтропия и представляющая собой меру тепловой энергии, которая не может быть превращена в механическую энергию в замкнутой термодинамической системе, может также восприниматься как мера информации. Понятие энтропии (от древнегреческого «в превращении») впервые ввел Рудольф Клаузиус в 1865 г. Тогда она представлялась таинственной термодинамической величиной, которая ограничивает мощность паровых двигателей. Тепло – это много энтропии. Механизмы, работающие на основе тепловой энергии, например паровые двигатели, должны что-то делать с этой энтропией; как правило, они избавляются от нее посредством выхлопа. Они не могут превратить всю тепловую энергию в полезную работу. Клаузиус же отметил, что энтропия имеет тенденцию увеличиваться. В конце XIX в. основатели статистической механики, Максвелл, Больцман и Гиббс, поняли, что энтропия – это еще и форма информации. Энтропия – мера количества битов недоступной информации, содержащейся в атомах и молекулах, из которых состоит мир. Тут-то и появилось второе начало термодинамики, которое объединило это наблюдение с тем фактом, что законы физики, как мы скоро увидим, сохраняют информацию. Природа не разрушает биты. Да, но ведь нужно бесконечное число битов энтропии, чтобы точно определить положение и скорость даже одного-единственного атома, возразили мои одногруппники. Это не так, ответил Тинкэм. Законы квантовой механики, управляющие поведением физических систем на микроскопическом уровне, гарантируют, что атомы и молекулы хранят лишь конечное количество информации. Черт побери! Это было очень увлекательно, хотя я еще не все понимал. Хорошо, все физические системы можно описать с точки зрения информации. Максвелл, Больцман и Гиббс выяснили это за пятьдесят лет до того, как было изобретено слово «бит»! Тогда причем же здесь квантовая механика? Мне стало любопытно, и я записался на вводный курс квантовой механики Нормана Рэмзи. Он – один из самых опытных специалистов по квантово-механическому «массажу» в мире. Рэмзи разработал многие из методов, с помощью которых можно убедить атомы и молекулы отдавать нам свою энергию и раскрывать свои тайны. Кстати, эти методы принесли ему Нобелевскую премию. Но то, что казалось Рэмзи простым, для меня оставалось неясным. Например, как это возможно, что электрон может быть в двух местах одновременно? На основании детальных экспериментальных данных Рэмзи показывал нам, что электрон не только может находиться во многих местах одновременно, но и должен там быть (там, и там, и там тоже). Возможно, в ранний час, в аудитории, освещенной только тусклым светом проектора, я впадал в некое трансовое состояние – но все равно не понимал сути квантовой механики. Я вышел из этого транса лишь несколько лет спустя, когда стал работать вместе с Рэмзи в Институте Лауэ-Ланжевена в Гренобле, Франция, над экспериментом по измерению поляризации электрического заряда в нейтроне. Нейтрон и его заряженный партнер, протон, – это частицы, из которых состоят ядра атомов. Нейтроны и протоны, в свою очередь, состоят из электрически заряженных частиц, кварков. Поляризация электрического заряда, которую хотел измерить Рэмзи, соответствовала расстоянию между кварками внутри нейтрона, которое составляет одну миллиардную миллиардной миллиардной доли метра (10–27 м); если сравнить его с размером нейтрона, то это расстояние меньше, чем сам нейтрон относительно человека. В экспериментах мы брали нейтроны из ядерного реактора, «охлаждали» их до «скорости пешехода» (на заключительном этапе охлаждения мы заставляли нейтроны «бежать в гору» до тех пор, пока они почти не останавливались от усталости), затем подвергали их воздействию электрических и магнитных полей, а затем «массировали», приводя в состояние, в котором они были готовы раскрыть свои секреты. Конечно, чтобы нейтрон захотел что-то показать, обращаться с ним нужно очень бережно. В таком эксперименте все надо было сделать правильно, иначе ничего не получится. Но наши нейтроны были непостоянными и непредсказуемыми. Неважно, как долго мы полировали для них электроды и откачивали воздух из установки, они отказывались с нами «разговаривать». В этот период вынужденного простоя Рэмзи поручил мне выполнить простой расчет, смысл которого был в том, что нейтрон одновременно вращается и по часовой стрелке, и против нее, при этом все время «разговаривая» с окружающими его частицами света, фотонами. Кажется, это был первый случай, когда мне нужно было делать вычисления для реального эксперимента, а может быть, Рэмзи просто щелкнул пальцами, но в итоге я вышел из транса! Я увидел, что нейтроны просто обязаны вращаться по часовой стрелке и против нее – в одно и то же время. У них нет выбора – таков уж их характер. Язык, на котором говорили нейтроны, не был обычным, где есть «да» или «нет»: в нем было «да» и «нет» сразу. И если я хотел «поговорить» с нейтронами и добиться от них ответа, то должен был научиться слышать, как они говорят «да» и «нет» одновременно. (Если это ставит вас в тупик, так и должно быть!) Но я, наконец, выучил первые слова на квантовом языке любви[16]. В следующей главе вы тоже будете учиться говорить на этом языке. Из курса Майкла Тинкэма по статистической механике я усвоил новое понимание физических объектов: можно считать, что они сделаны из информации. Из курса Рэмзи по квантовой механике я узнал, как законы физики управляют представлением и обработкой этой информации. По большей части, научная работа, которой я занимался с тех пор, как прослушал эти курсы, была связана с взаимодействием между физикой и информацией. Вычислительная природа самой Вселенной является результатом этого взаимодействия.

Атомная гипотеза

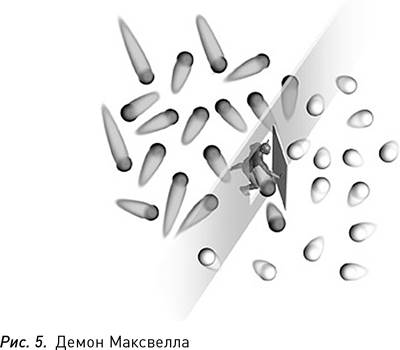

Математическую теорию информации предложили Гарри Найквист, Клод Шеннон, Норберт Винер и другие ученые[17]в середине XX в. Эти исследователи использовали математические доказательства для вывода формул, позволяющих определить количество битов информации, которую можно надежно пересылать по различным каналам связи, например по телефонной линии. Говорят, что однажды Шеннон показал выведенную им формулу для вычисления количества информации математику Джону фон Нейману и спросил его, как можно обозначить величину, которую он только что определил. Фон Нейман немедленно ответил: «H». «Почему H?» – спросил Шеннон. «Потому что так называл ее Больцман», – ответил фон Нейман. Как оказалось, основные формулы теории информации уже давно вывели Максвелл, Больцман и Гиббс! Чтобы понять, какое отношение имеет информация к атомам, вспомним истоки атомной гипотезы. Древние греки предположили, что все вещество состоит из атомов (древнегреческое atomos означает «неделимый»). Атомная гипотеза была основана на эстетической идее, на отвращении к бесконечному. Древние просто не хотели верить, что вещество можно без конца делить на все более и более мелкие части. В XVII в. Исаак Ньютон и Готфрид Вильгельм Лейбниц изобрели дифференциальное исчисление – математический метод для работы с бесконечно малыми величинами. Это позволило описать твердые, жидкие и газообразные вещества на основании математической модели, в которой они считаются непрерывными субстанциями, которые можно делить неограниченное число раз. Мощь и элегантность дифференциального исчисления, а также отсутствие прямых доказательств существования атомов, дали начало научным теориям, основанным на континууме. Но ко второй половине XIX в. стали появляться данные наблюдений, указывающие на то, что, как и предполагала атомная гипотеза, вещество действительно может состоять из очень мелких отдельных фрагментов и не является непрерывным. Например, если посмотреть в микроскоп на крошечные пылинки в жидкости, мы увидим, что они исполняют забавный танец под названием «броуновское движение». Пылинки движутся, потому что их со всех сторон бомбардируют молекулы жидкости, в которой они находятся. Когда (случайно) пылинка получает больше ударов молекул воды слева, чем справа, она смещается вправо. Если больше молекул жидкости сталкивается с пылинкой сверху, они гонят ее ко дну. В начале XX в. Эйнштейн (тот самый!) предложил изящную количественную теорию броуновского движения. Он показал, что наблюдаемое движение совпадает с расчетом в модели, где «подвешенные» в жидкости пылинки бомбардируются намного меньшими частицами, и оценил их размер и массу. Так атомная гипотеза вернулась на передний край науки. Задолго до этой работы Эйнштейна, однако, представление об атомах использовалось как надежное основание для описания поведения теплоты и энергии. Теплота, как уже было известно, является формой энергии. Еще в XVIII в. Джеймс Уатт провел знаменитую демонстрацию: он погрузил в воду мортиру и стал рассверливать цилиндр ствола большим сверлом на лошадиной тяге. Лошади двигались по кругу, сверло вращалось и срезало металл, формируя отверстие ствола. В конце концов вода закипела, наглядно продемонстрировав превращение лошадиных сил в тепло. К середине XIX в. взаимообмен между механической энергией и теплотой был установлен вполне надежно и был провозглашен первым началом термодинамики: энергия сохраняется, когда механическая энергия превращается в тепло. В отличие от механической энергии, энергия в форме тепла, как оказалось, обладала таинственным свойством, названным энтропией. Энтропия не позволяла части тепла превращаться в полезную работу. Как и энергию, энтропию можно было определить количественно в ходе эксперимента: всякий раз, когда механическая энергия превращалась в теплоту, создавалось количество энтропии, равное энергии, деленной на температуру. Когда же теплота превращалась в механическую энергию, как в одном из паровых двигателей Уатта, количество энтропии в охлажденном паре выхлопа оказывалось больше или равно количеству энтропии в горячем паре, приводящем двигатель в действие. Иначе говоря, энтропия, чем бы она ни была, никогда не уменьшалась. Но что это за штука, энтропия? Ответ дает атомная гипотеза. Теплота – это форма энергии, и энтропия связана с теплотой. Если вещи состоят из атомов, то существует простое объяснение теплоты – это просто энергия движения атомов. Тогда и у энтропии есть простая интерпретация: для описания движения атомов нужно много битов информации. Величина, называемая энтропией, пропорциональна количеству битов, необходимых для того, чтобы описать то, как движутся атомы. Ученые XIX в. уже могли согласиться с тем, что теплоту можно воспринимать как энергию движущихся атомов. В конце концов, начиная с работ Галилея и Ньютона, написанных двумя столетиями ранее, было известно, что все, что движется, обладает энергией – так называемой кинетической (от греческого kinesis, «движение»), связанной с этим движением. Чем быстрее движется предмет, тем больше у него кинетической энергии. Когда механическая энергия превращается в теплоту, как в эксперименте Уатта, где лошади сверлили ствол мортиры и при этом нагревали воду, механическая работа, произведенная лошадьми, превращается в кинетическую энергию молекул воды. Точно так же, когда горячий газ перемещает поршень в паровом двигателе, это происходит благодаря тому, что молекулы воды, формирующие пар, все время ударяются о поршень, оказывая давление на него. Когда механическая энергия превращается в кинетическую энергию атомов и молекул и наоборот, первое начало термодинамики гарантирует, что общая энергия остается неизменной. Для ученых XIX в. не было естественным думать об энтропии как об информации. Сейчас, в разгар очередной информационной революции, нас уже не удивляет, что информация – не менее фундаментальная величина, чем энергия. В конце XIX в., однако, вообще не было очевидно, что информация является некоей величиной. В середине XIX в. Джеймс Клерк Максвелл детально разработало теорию теплоты в терминах движения атомов. Он выяснил, как быстро движутся атомы в зависимости от температуры: как оказалось, кинетическая энергия атомов пропорциональна температуре. Чем выше температура объекта, тем быстрее движутся его атомы. Эта «пляска» атомов также связана с энтропией: чем быстрее атомы движутся, тем больше нужно информации для описания их движений и тем большей энтропией они обладают. Температура – это мера компромисса между информацией и энергией: при высокой температуре атомам нужно больше энергии, чтобы записать один бит информации, а при низкой атомам нужно для этого меньше энергии. Температура – это, в сущности, энергия в расчете на один бит. Когда энергия в форме теплоты переходит от горячего объекта к холодному, энтропия увеличивается: то же самое количество энергии хранит меньше информации, когда объект горячий, чем когда объект холодный. Состояние максимальной энтропии достигается в том случае, когда температура всех объектов одинакова. Максвелл понял, что если можно было бы получить информацию о поведении атомов газа на микроскопическом уровне, то можно было бы уменьшить его энтропию; значит, энтропия так или иначе связана с информацией. В своем знаменитом сочинении «Об уменьшении энтропии разумными существами» (On the Decrease of Entropy by Intelligent Beings) Максвелл описал крошечное разумное существо, так называемого «демона», который может направлять тепловые потоки от холодных тел к горячим, нарушая самым наглядным образом второе начало термодинамики. Предположим, сосуд с гелием в виде газа разделен перегородкой на два отделения. В перегородке есть маленькая дверца, в которую могут одновременно протиснуться всего несколько атомов газа. Демон отслеживает атомы, находящиеся рядом с дверцей, и открывает ее всякий раз, когда атомы, приближающиеся к ней с холодной стороны, движутся быстрее (то есть они более горячие), чем атомы, приближающиеся к ней с горячей стороны. Каждый раз, когда демон открывает дверцу, более горячие атомы перемещаются на горячую сторону, а более холодные атомы перемещаются на холодную сторону. По мере того как демон пропускает все больше быстрых атомов на горячую сторону и все больше медленных атомов на холодную сторону, горячее отделение сосуда с газом становится горячее, а холодное отделение становится холоднее. Этот поддерживаемый демоном поток тепла из холодного отделения в горячее явным образом нарушает второе начало термодинамики, которое гласит, что тепловые потоки текут от горячих предметов к холодным, но не наоборот. Но только способность демона получать информацию об атомах позволяет ему добиться этого кажущегося нарушения физического закона.

Демон Максвелла – воображаемое существо, которое отклоняет быстрые, горячие, молекулы в одну половину сосуда, а медленные, холодные, молекулы – в другую его половину, нарушая явным образом второе начало термодинамики

Как мы увидим, на самом деле демон не может нарушить второе начало термодинамики, так как в правильной формулировке оно гласит, что энтропия/информация газа и демона, взятых вместе, уменьшаться не могут[18]. Второе начало термодинамики остается в силе. Тем не менее действия демона иллюстрируют очевидную связь между информацией и энтропией. К концу XIX в. Больцман, Гиббс и немецкий физик Макс Планк уточнили формулы, описывающие энергию и энтропию систем, состоящих из атомов. В частности, они обнаружили, что энтропия системы пропорциональна количеству битов, необходимых для описания микроскопического состояния атомов, соответствующего некоторому макросостоянию. Этот результат был столь полезен для описания обмена между теплотой и энергией, что формула, которая его описывает, выгравирована на могиле Больцмана. Энтропия традиционно обозначается символом S, а число различных возможных микросостояний (или «цветов лица», complexions, как называл их Планк) – символом W. Здесь W может быть числом микросостояний отдельного атома или системы, состоящей из атомов. Эпитафия на могиле Больцмана гласит: «S = k log W», и это просто математически изысканный способ сказать, что энтропия объекта пропорциональна числу битов, записанных его микросостоянием. То же самое можно выразить и по-другому: энтропия пропорциональна длине числа возможных микросостояний, если записать его в двоичной системе счисления. В этой формуле k называют постоянной Больцмана. Пауль и Татьяна Эренфест[19], которые сделали важный вклад на начальном этапе исследований энтропии, указывали, что эту формулу на самом деле впервые предложил Планк, и поэтому константу, которую мы называем «постоянной Больцмана», они называли «постоянной Планка». Но, как мы увидим, когда будем рассматривать квантовую механику, именем Планка уже названа довольно важная константа. Чтобы избежать путаницы, а также увековечить заслуги Больцмана, символу «k» дали его имя. (Больцман славился своим угрюмым характером – он покончил с собой вскоре после визита в Соединенные Штаты в 1906 г. Остается только гадать, что бы он сделал, если бы узнал, что на его могильном камне выбита чужая формула.) Максвелл, Больцман, Гиббс и Планк обнаружили, что энтропия пропорциональна числу битов информации, записанной в микроскопических движениях атомов. Конечно, эти ученые XIX в. еще не думали, что их открытие относится главным образом к информации. В то время энтропию не измеряли в битах, и они считали, что их открытие корректно описывает термодинамическую энтропию – величину, которая ограничивает эффективность тепловых машин. Они были правы, разумеется, и поскольку тогда энтропию не измеряли в битах, полученную ими безразмерную величину log W нужно было умножить на постоянную Больцмана, чтобы преобразовать энтропию с точки зрения информации в обычную термодинамическую энтропию Клаузиуса. Неважно, осознавали они это или нет, но пионеры статистической механики вывели формулу для вычисления информации за пятьдесят лет до того, как возникла математическая теория информации. Но как физическая система, например газ, записывает и сохраняет информацию? Возьмем детский воздушный шарик, заполненный гелием. Атомы гелия в воздушном шарике носятся с места на место, сталкиваясь друг с другом и с оболочкой шарика. Каждый атом гелия есть носитель информации, а именно – количества информации, необходимого для описания того, где он находится (положение), куда и как быстро он движется (скорость). Чтобы измерить количество информации, которую содержит атом, следует определить самый малый масштаб, то есть степень точности, с которой могут быть описаны положение и скорость атома. Тогда число битов, которые содержит данный атом, будет равно числу битов, необходимых для того, чтобы определить его положение и скорость с точностью, заданной этим самым малым масштабом. Позже мы увидим, что пределы точности, с которыми могут быть измерены положение и скорость, определяются квантовой механикой. С учетом этого естественного масштаба каждый атом в воздушном шарике содержит около 20 битов. Количество информации, записанной всеми атомами гелия в воздушном шарике, является произведением этой величины на количество атомов, а их примерно 6х1023. Таким образом, гелий в воздушном шарике содержит примерно десять миллионов миллиардов миллиардов (1025) битов информации. Это очень много информации. Книга, которую вы держите в руках, содержит лишь несколько миллионов битов информации[20]. Миллионы книг библиотеки Конгресса содержат миллионы миллионов битов. Все компьютеры в мире в настоящее время содержат миллиард миллиардов битов, если не больше. И все же все биты информации, созданные человеком в письменном или электронном виде, все равно не могут сравниться с количеством информации, записанной атомами гелия в одном воздушном шарике. Конечно, биты информации, которую содержат атомы гелия в воздушном шарике, не тянут на приключенческий роман. Как и тексты, напечатанные обезьяной на пишущей машинке, биты, запечатленные атомами, с очень высокой вероятностью представляют собой бессмыслицу. Даже если положения и скорости атомов гелия в какой-то момент времени вдруг можно расшифровать как полный текст «Гамлета» (а мы уже знаем, что это крайне маловероятно), секунду спустя эти биты снова «рассыплются» в случайную картину.

Принцип Ландауэра

Второе начало термодинамики гласит, что общая сумма информации никогда не уменьшается. Для нашего воздушного шарика это значит, что количество битов информации, записанной атомами гелия, не станет меньше, если воздушный шарик останется в состоянии покоя. Конечно, если мы охладим воздушный шарик, сожмем или проткнем его, количество битов, хранимых атомами гелия в нем, может уменьшиться – но только за счет увеличения числа битов, записанных атомами воздуха, окружающими воздушный шарик. Информацию можно создать, но невозможно уничтожить. Воздействием на бит его значение можно инвертировать, то есть заменить противоположным или заставить бит «переключиться». Информация при этом трансформируется: 0 превращается в 1 и наоборот. И в то же время она сохраняется: если мы знаем, что до воздействия значение бита было 0, то мы знаем, что после «щелчка» его значение будет 1. Существует, конечно, и стирание – это процесс, который уничтожает информацию. В процессе стирания бит с первоначальным значением 0 остается нулем, а бит со значением 1 превращается в 0. Стирание разрушает информацию, имевшуюся в этом бите. Но законы физики не допускают существования процесса, который просто стирает биты, и ничего больше. Любой процесс, который стирает бит в одном месте, должен перенести то же самое количество информации в какое-то другое место. Это называется принципом Ландауэра, по имени Рольфа Ландауэра, пионера физики информации, который и обнаружил его в начале 1960-х гг. Чтобы увидеть принцип Ландауэра в действии, давайте посмотрим, как биты стираются в компьютерах. Как мы говорили во второй главе, в современном электронном компьютере биты хранятся в конденсаторе. Конденсатор – это ведро для электронов. Когда мы заряжаем конденсатор, то помещаем электроны в ведро; когда мы разряжаем его, то извлекаем электроны из ведра. В компьютере незаряженный конденсатор хранит 0, а заряженный конденсатор хранит 1. Чтобы стереть бит в электронном компьютере, достаточно «вытряхнуть» ведро: замкнуть выключатель и позволить электронам, находящимся в конденсаторе, из него выйти. Если конденсатор разряжен, ведро пустое, и наш бит теперь имеет значение 0. Но теперь микросостояние электронов «помнит», был ли заряжен конденсатор или нет: выходя из конденсатора, электроны нагреваются! Такое изменение температуры остается указателем на начальное состояние конденсатора. Бит информации превратился в микроскопическое движение электронов. Другой способ стереть бит состоит в том, чтобы поменять его с другим битом, имеющим значение 0. Однако передача информации между битами сохраняет ее: чтобы вернуть первоначальные значения битов, достаточно просто снова поменять их местами. В начале первый бит может иметь значение 0 или 1, и поэтому у него есть бит энтропии. Второй бит имеет значение 0; у него нет никакой энтропии. После того как биты поменялись местами, значение первого будет 0: либо он сохранил 0, либо была стерта 1. Но теперь второй имеет значение 0 или 1: у него есть бит энтропии – той же самой энтропии, которую имел первый бит в начале. Когда биты меняются местами, информации и энтропия перемещаются из одного места в другое, но общее количество информации остается постоянным. Такую передачу информации можно использовать для того, чтобы стереть бит в одном регистре, сохраняя копию бита в другом регистре. Возвращаясь к примеру конденсатора в компьютере, отметим, что разрядка, или стирание его бита, по сути, «заменяет» информацию, записанную в конденсаторе, информацией, запечатленной электронами. Законы физики сохраняют информацию в процессе ее преобразования. На языке математики динамические законы физики для замкнутых физических систем гласят, что каждое исходное состояние переходит в одно и только одно результирующее состояние, а каждое результирующее состояние может возникнуть из одного и только одного исходного состояния. Таким образом, можно вернуться назад: если нам известно нынешнее физическое состояние системы, то, в принципе, следуя физической динамике этой системы, можно определить ее состояние в более ранний или в более поздний момент. Например, если нам известно точное состояние атомов газа гелия в воздушном шарике в один момент времени и мы можем в деталях проследить динамику атомов, сталкивающихся друг с другом и с внутренней стороной оболочки воздушного шарика, то благодаря тому, что каждое состояние динамически развивается в полностью определенное следующее состояние, мы будем знать состояние атомов гелия в более поздние моменты времени. И наоборот, из-за того, что каждое состояние развивается из полностью определенного состояния, если нам известно состояние в настоящий момент и мы можем в деталях проследить динамику событий, можем определить и состояние в предыдущие моменты времени. Пусть состояние бита изменяется на противоположное, если мы знаем, каким оно было перед инверсией, то узнаем и то, каким оно будет после инверсии. Физическая динамика сохраняет информацию. Именно это сохранение не позволяет тепловым механизмам, например паровым машинам или автомобильным двигателям, извлекать из теплоты всю энергию. В горячем газе много энергии, но и много битов; температура газа пропорциональна средней энергии на бит. В горячем газе больше энергии на бит, в холодном – меньше. Когда мы извлекаем тепловую энергию газа, например если этот газ давит на поршень, биты остаются. Движущийся поршень превращает тепловую энергию в механическую, количество энергии на атом (и следовательно, на бит) падает, и расширяющийся газ остывает. Пока температура газа не достигла абсолютного нуля, каждый атом (и, следовательно, каждый из его битов) все еще требует некоторой энергии. Это количество энергии остается в газе и не может перейти в механическую энергию. Так как некоторая энергия должна остаться, не вся энергия может быть извлечена в форме работы. Веками изощренные изобретатели пытались придумать машину, которая могла бы извлекать больше энергии, чем это возможно в соответствии с данным объяснением. При этом они и по сей день пытаются игнорировать второе начало термодинамики. Такую машину традиционно называют perpetuum mobile, вечным двигателем[21]. Как можно догадаться, создать ее невозможно, потому что она не в состоянии предоставить дополнительную информацию. Может показаться, что после столетий бесплодных усилий люди должны были разочароваться в идее вечного двигателя. Но за последние пятнадцать лет меня много раз просили оценить предложения изобретателей, пытавшихся извлечь из физических систем больше энергии, чем позволяет второе начало термодинамики. Все эти предложения были неудачными. Со временем я так натренировался, что мог взять самый сложный чертеж подобной машины и тут же сказать, где изобретатель «замел информацию под коврик».

Распространение неведения

Законы физики сохраняют информацию. Количество битов, записанных системой (например, воздушным шариком с гелием), не уменьшается. Такое сохранение информации ограничивает эффективность тепловых машин и одновременно отвечает за второе начало термодинамики. Но здесь есть проблема. Согласно законам физики, общее количество информации не может также и увеличиваться. По существу, они гласят, что при отсутствии взаимодействия с другой системой количество информации в системе остается тем же. Но как же энтропия – а это форма информации – может увеличиваться, если при этом не увеличивается суммарное информационное содержание физической системы? Как может быть, что известная информация становятся неизвестной? В первоначальном виде энтропия рассматривалась как величина, измеряющая, насколько полезна энергия. Энергия с небольшим количеством энтропии – это полезная (свободная) энергия; энергия с большим количеством энтропии бесполезна. Возможно, легче понять увеличение энтропии в такой формулировке: энергия переходит из полезной формы в бесполезную. Горячая ванна остывает. В автомобиле заканчивается бензин. Молоко скисает. Как можно рассмотреть этот процесс с точки зрения информации? Ответ заключается в фундаментальном свойстве природы, который я называю «распространением неведения». Можно сказать, что неизвестные биты заражают известные. Мы видели, что энтропия – это информация о микроскопических движениях атомов, таких крошечных, что мы не можем увидеть их даже под самым мощным микроскопом. Каждый атом гелия в нашем воздушном шарике содержит двадцать битов. Но если мы не знаем, где находится отдельный атом в воздушном шарике и как быстро он движется (с точностью, позволенной квантовой механикой), то понятия не имеем, что это за биты. Другими словами, энтропия – невидимая информация – является также мерой неведения. Кое-какая информация об атомах в воздушном шарике у нас, конечно, есть. Например, мы можем измерить его макроскопическое состояние: размер, температуру, давление, которое атомы гелия оказывают на его стенки. Обычно у нас есть только несколько сотен битов макроскопической информации о физической системе, например о воздушном шарике. Для любой системы можно провести различие между битами, значения которых (0 или 1) мы знаем, и теми, значений которых мы не знаем. Биты, значений которых мы не знаем, составляют энтропию системы: бит энтропии – это бит неведения. Обратите внимание, что разделение информации на известную и неизвестную до некоторой степени субъективно. Разные люди знают разные вещи. Допустим, например, вы отправили мне короткое электронное письмо, содержащее 100 битов информации. Вы знаете, что это за биты, ведь это вы их отправили. Для вас информация этого электронного письма известна. Пока я не открою это письмо, я не знаю, что это за биты: для меня они все еще невидимы, и на этой стадии я бы посчитал эти 100 битов энтропией. Поэтому разные наблюдатели могут придавать разное значение энтропии системы. Помните демона Максвелла? Он контролирует микроскопические состояния газа, и у него больше информации, чем у наблюдателя, который просто знает температуру и давление газа. Соответственно, для демона в газе меньше энтропии, чем для стороннего наблюдателя. Для целей второго начала термодинамики важно общее количество информации в физической системе. Общее количество информации в физической системе, известной и неизвестной, не зависит от того, кто и как наблюдает за ней. Предположим, неизвестный бит информации взаимодействует с известным битом информации. После этого взаимодействия первый бит по-прежнему остается неизвестным, но теперь и второй бит тоже становится неизвестным. Неизвестный бит как бы заразил известный, распространяя неведение и увеличивая общую энтропию системы. Идеи вычисления, о которых мы говорили выше, можно использовать для того, чтобы прояснить «заразную» природу неведения. Возьмем два бита. Значение первого неизвестно – оно может быть или 0, или 1. Значение второго бита известно – скажем, это 0. Таким образом, оба бита вместе находятся в состоянии 00 или 10. Теперь применим к битам следующую простую логическую операцию. Инвертируем второй бит, но если и только если первый бит равен 1. Эту операцию можно назвать «условное не» (controlled-not), потому что она выполняет инверсию (или операцию «не») со вторым битом, используя как сигнал управления состояние первого бита (который в данном случае неизвестен). Итак, если первый бит будет равен 1, то операция «условное не» изменит второй бит с 0 на 1. Если значение первого бита – 0, то после операции «условное не» значение второго бита останется равным 0. Таким образом, после операции «условное не» пара битов будет или в состоянии 00, или в состоянии 11. Теперь два бита коррелируют – то есть имеют одно и то же значение. Если мы посмотрим на первый бит, то узнаем значение второго бита, и наоборот. Мы как не знали значение первого бита, так и не знаем его после выполнения операции: он по-прежнему находится в состоянии 0 или в состоянии 1. Но посмотрим на второй бит. Теперь он тоже может находиться в состоянии 0 или 1. Второй бит, значение которого до операции было 0, теперь тоже имеет неизвестное значение. Операция «условное не» заставила неизвестную информацию первого бита «заразить» второй бит – незнание распространилось! (Распространение неведения обратимо. Чтобы вернуть оба бита в исходное состояние, нужно выполнить операцию «условное не» повторно. Операция «условное не» является обратной по отношению к самой себе: выполнить ее дважды – все равно что не делать ничего вообще.) Распространение неведения увеличивает энтропию отдельных битов в системе. Энтропия первого бита по-прежнему составляет один бит, но энтропия второго увеличивается. Тем не менее энтропия пары битов, взятых вместе, остается постоянной! Перед операцией «условное не» два бита могли находиться в одном из двух состояний – 00 или 10. В системе один бит энтропии – в первом бите из пары. После операции «условное не» пара битов может находиться в одном из двух состояний – 00 или 11. Мы по-прежнему видим один бит энтропии, но теперь он распределен между двумя битами. Распространение неведения отражается в росте величины, которая называется «взаимная информация». У каждого бита после операции есть собственный бит энтропии, но у двух битов, взятых вместе, тоже есть только один бит энтропии. Взаимная информация равняется сумме энтропий, взятых по отдельности, минус энтропия двух битов, взятых вместе. Другими словами, у двух битов есть ровно один бит взаимной информации. Какую бы информацию они ни содержали, они содержат ее вместе.

Неведение атомов

«Заразный» характер информации относится и к сталкивающимся атомам, и к битам в вычислении. Идею о том, что энтропия отдельных атомов газа имеет тенденцию увеличиваться, впервые выдвинул Людвиг Больцман в 1880-х гг. Больцман определил величину, которую назвал «H», как степень, до которой мы знаем положение и скорость любого данного атома газа. Величина «H» Больцмана фактически является энтропией отдельного атома, умноженного на минус один. Больцман показал, что, когда положения и скорости атомов не коррелирует, то есть независимы друг от друга, столкновения между ними уменьшают «H» и увеличивают энтропию отдельных атомов. Последующие столкновения, утверждал он, продолжат увеличивать эту энтропию. Он пришел к выводу, что его H -теорема является обоснованием второго начала термодинамики и доказывает математически, что энтропия должна увеличиваться. Проблема H -теоремы Больцмана состоит в том, что она, строго говоря, не является истинной для атомов газа. Больцман был прав в том, чт

|

||

|

Последнее изменение этой страницы: 2016-04-23; просмотров: 354; Нарушение авторского права страницы; Мы поможем в написании вашей работы! infopedia.su Все материалы представленные на сайте исключительно с целью ознакомления читателями и не преследуют коммерческих целей или нарушение авторских прав. Обратная связь - 216.73.216.156 (0.019 с.) |