Заглавная страница Избранные статьи Случайная статья Познавательные статьи Новые добавления Обратная связь FAQ Написать работу КАТЕГОРИИ: ТОП 10 на сайте Приготовление дезинфицирующих растворов различной концентрацииТехника нижней прямой подачи мяча. Франко-прусская война (причины и последствия) Организация работы процедурного кабинета Смысловое и механическое запоминание, их место и роль в усвоении знаний Коммуникативные барьеры и пути их преодоления Обработка изделий медицинского назначения многократного применения Образцы текста публицистического стиля Четыре типа изменения баланса Задачи с ответами для Всероссийской олимпиады по праву

Мы поможем в написании ваших работ! ЗНАЕТЕ ЛИ ВЫ?

Влияние общества на человека

Приготовление дезинфицирующих растворов различной концентрации Практические работы по географии для 6 класса Организация работы процедурного кабинета Изменения в неживой природе осенью Уборка процедурного кабинета Сольфеджио. Все правила по сольфеджио Балочные системы. Определение реакций опор и моментов защемления |

Основные характеристики информационной системыСодержание книги

Поиск на нашем сайте

Символы, генерируемые источником сообщений, имеют некоторую продолжительность во времени и появляются через определенные интервалы времени. Для дискретного источника сообщений поток генерируемой информации можно определить следующим образом:

где v 0 = 1/ t 0 - средняя скорость генерации символов сообщения; t 0 - среднее время генерации одного символа; Н(X) - энтропия источника сообщений, характеризующая среднее количество информации на символ сообщения. Поток информации характеризует среднее количество информации, генерируемое источником сообщений в единицу времени. В случае сообщений, состоящих, например, из дискретных символов, для увеличения потока информации необходимо увеличивать энтропию сообщений, приходящуюся в среднем на один символ, а также сокращать промежутки времени между символами. Статические свойства источника сообщений в общем случае не совпадают со статистическими свойствами канала связи, зависящими от выбранного кода и статистических свойств помех. Наличие помех снижает пропускную способность канала связи С которая определяется как наибольшая возможная скорость передачи информации по данному каналу, т.е.

где Imax (T) - максимальное количество информации, которое может быть безошибочно передано по каналу за время Т; vmax - максимальная скорость передачи символов по каналу; max { I (Y, X)} - предельно возможное значение среднего количества информации, содержащегося в одном символе принятого сообщения. Если возможно надежно различить в канале М функций сигнала длительностью Т, то можно сказать, что канал может передавать log2 М битов за время T. Соответственно, скорость передачи будет (1/Т) log 2 M, или пропускная способность канала может быть определена как предел выражения Шеннон показал, что можно сообщения источника закодировать так, что среднее количество информации, приходящееся на символ источника, будет близко к максимальному. Это положение сформулировано в теореме Шеннона о кодировании для каналов без помех. Если производительность источника R меньше пропускной способности канала C, его сообщения можно закодировать так, что скорость передачи может быть как угодно близка к пропускной способности канала. В соответствии с определением,

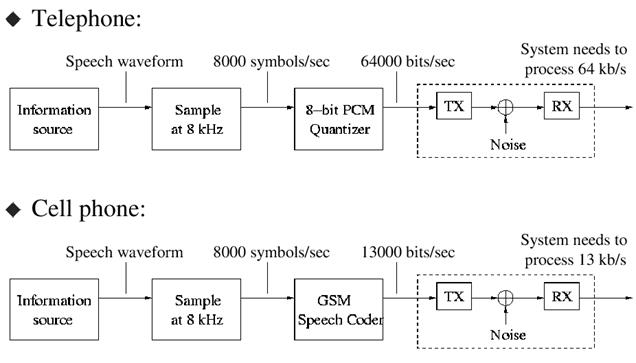

Для выполнения равенства необходимо, чтобы nk = - log 2 pk, т.е. кодирование нужно осуществить так, чтобы длину кодовых комбинаций сообщений ставить в зависимость от количества информации, которое переносится данным сообщением или от вероятности данного сообщения. Часто встречающиеся, т.е. малоинформативные сообщения, следует кодировать короткими комбинациями, редко встречающиеся - длинными. В этом случае в среднем все сообщения источника будут закодированы меньшим числом символов, чем при любом другом способе кодирования. По этой причине данный код называется оптимальным или эффективным, а т.к. при его создании учитываются вероятности сообщений, он называется статистическим и без разделительных знаков, т.к. возможно однозначное декодирование, если при передаче нет ошибок за счет помех. Одним из примеров такого оптимального кодирования являются мобильные радиотелефонные сотовые сети GSM. Реализованное в системах GSM полноскоростное кодирование речи предоставляет хорошее "сотовое качество" передаваемой речи. Однако благодаря быстрому развитию в течение последних нескольких лет алгоритмов кодирования речи с низкой скоростью битового потока сейчас стало возможным полностью избавиться от имиджа "сотового качества" и достигнуть в сотовых сетях такого же качества речи, как в обычной телефонной сети. В обычной цифровой телефонной сети, при частоте дискретизации 8 кГц и 8-ми битовой разрядности кода получаем скорость передачи сформированного сигнала 64 кбит/с, которая и является скоростью основного цифрового канала (рис. 44).

Рис. 44. Сравнение блок-схем цифрового и мобильного телефона GSM

Соответственно линия связи должна обеспечивать скорость передачи данных не менее 64 кбит/с. В сетях GSM в качестве речепреобразующего устройства выбран речевой кодек с регулярным импульсным возбуждением/долговременным предсказанием и линейным предикативным кодированием с предсказанием (RPE/LTR-LTP-кодек). Общая скорость преобразования речевого сигнала в итоге сокращается до 13 кбит/с, что позволяет передать большое число каналов в радиодиапазоне.

§1.5. Дискретизация и теорема отчетов (Котельникова)

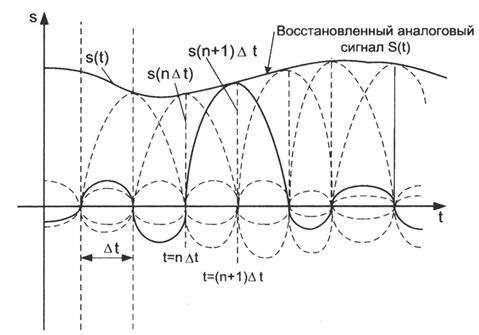

Для понимания теоремы Шеннона об информационном канале с шумом напомним определения понятий дискретизации и интерполяции. Определение. Представление непрерывного (аналогового) сигнала x(t) дискретной последовательностью отсчетов x(tk)=x(k, ∆t), по которым с заданной точностью можно восстановить исходный непрерывный сигнал, называется дискретизацией на равномерной сетке. Определение. Процесс восстановления дискретизированного сигнала называется интерполяцией. Допустим, у нас есть непрерывное изображение i(x,y). После дискретизации мы получаем дискретное изображение I(xk,ym). Затем интерполируем его и переходим к изображению i’(x,y). Естественно возникает вопрос: как нужно проводить дискретизацию, чтобы не происходила потеря информации, т.е. при каких условиях исходное изображение i(x,y) совпадает с восстановленным i’(x,y)? Ответ на этот вопрос может быть получен из теоремы Котельникова. Теорема. Пусть сигнал s (t) задан на бесконечной оси времени, -∞ < t < ∞, с ограниченной полосой спектра s (ω), тогда справедливо равенство:

где τ- интервал времени между соседними равноотстоящими отчетами сигнала s (t):

Т.о., сигнал, описываемый непрерывной функцией времени s (t) с ограниченным спектром, полностью определяется своими значениями, отсчитанными через интервалы времени τ=1/(2F), где F - ширина спектра сигнала. Частота 2 F называется частотой Найквиста или частотой дискретизации. Это минимальная частота, с которой нужно посылать импульсы, чтобы не было потери информации. В формуле (19) константу τ обычно называют периодом дискретизации, последовательность s (kτ) – последовательностью дискретизированных значений.

Рис. 45. Представление сигнала s (t) рядом (18)

На рис. 44 проиллюстрировано представление сигнала рядом (18), сплошная линия s (t) представляет сумму сплошного и пунктирных горбов функции в правой части (18), умноженных на величину амплитуд s (k t) в точках k t. На практике восстановленная функция, как правило, не совпадает точно c передаваемой функцией s (t). Ошибка обусловлена, например, тем, что спектр передаваемой функции обычно ограничен не резко. Это вытекает хотя бы из того факта, что все реальные сигналы ограничены во времени и, следовательно, имеют неограниченные строго спектры. Выбор интервалов отсчетов τ > 0 означает, что все спектральные составляющие спектра с частотами ω > Ωmax= π τ не передаются и не могут быть восстановлены. Если 2τ F > 1, то исходная функция не может быть восстановлена. Теорема была сформулирована В. А. Котельниковым в 1933 году в его работе «О пропускной способности эфира и проволоки в электросвязи» и является одной из основополагающих теорем в теории и технике цифровой связи.

|

||||

|

Последнее изменение этой страницы: 2021-03-10; просмотров: 183; Нарушение авторского права страницы; Мы поможем в написании вашей работы! infopedia.su Все материалы представленные на сайте исключительно с целью ознакомления читателями и не преследуют коммерческих целей или нарушение авторских прав. Обратная связь - 216.73.216.119 (0.011 с.) |

, (15)

, (15) , (16)

, (16) . Если по каналу без помех передается двоичная информация, т.е. log2 M = 2 то формула упрощается:

. Если по каналу без помех передается двоичная информация, т.е. log2 M = 2 то формула упрощается:  .

. , где H (X) – энтропия источника (см. (14)), T - средняя продолжительность кодовой комбинации:

, где H (X) – энтропия источника (см. (14)), T - средняя продолжительность кодовой комбинации:  , τ0 - длительность одного символа, n k - длина k -ой кодовой комбинации. Отсюда можно вывести:

, τ0 - длительность одного символа, n k - длина k -ой кодовой комбинации. Отсюда можно вывести: . (17)

. (17)

(18)

(18) (19)

(19)