Заглавная страница Избранные статьи Случайная статья Познавательные статьи Новые добавления Обратная связь КАТЕГОРИИ: ТОП 10 на сайте Приготовление дезинфицирующих растворов различной концентрацииТехника нижней прямой подачи мяча. Франко-прусская война (причины и последствия) Организация работы процедурного кабинета Смысловое и механическое запоминание, их место и роль в усвоении знаний Коммуникативные барьеры и пути их преодоления Обработка изделий медицинского назначения многократного применения Образцы текста публицистического стиля Четыре типа изменения баланса Задачи с ответами для Всероссийской олимпиады по праву

Мы поможем в написании ваших работ! ЗНАЕТЕ ЛИ ВЫ?

Влияние общества на человека

Приготовление дезинфицирующих растворов различной концентрации Практические работы по географии для 6 класса Организация работы процедурного кабинета Изменения в неживой природе осенью Уборка процедурного кабинета Сольфеджио. Все правила по сольфеджио Балочные системы. Определение реакций опор и моментов защемления |

Автомат, способный на мистификацию

После короткого экскурса в тайны человеческого мозга не помешает создать загадочный и зловредный искусственный интеллект, чтобы исследовать другие аспекты робототехники и искусственного разума. Сейчас мы займемся созданием ИИ, который сыграет роль псевдогадалки — конечно же, исключительно в образовательных целях. Таким образом мы увидим, как вычислительное мышление позволяет дурачить людей. Для нашей аферы понадобится несколько хитрых объединенных вместе элементов. Нужно придумать основную мошенническую схему, привлечь клиентов, убедиться, что клиент передал деньги, и узнать, совпал ли цвет у перевернутых карт. Давайте по очереди рассмотрим все эти этапы. Удача любит смелых Представьте себе такую сцену. В полутемной комнате витают экзотические ароматы. В сумраке видны странные символы и необычные рукописи о давно забытых магических искусствах. На столе — кристаллы, осколки загадочных былых времен. Почти незаметно появляется предсказательница, искусственный интеллект. Она предлагает вам сесть. Сеанс начинается.

«Добро пожаловать. Кристаллы сказали мне, что сегодня твои вибрации особенно восприимчивы. Я слышу зов судьбы. Твоя аура говорит, что ты чуткий и жизнерадостный человек, но бывали времена, когда жизнь тебя не радовала. Возможно, это были страдания от неудовлетворенности собой. Ты знаешь, что у тебя есть скрытые способности, которые ты пока не использовал на благо другим и себе, как хотелось бы. Ты знаешь: чтобы произошел прогресс, нужно достичь гармонии с другими, но и не предать себя. Я могу помочь. Всего за две монеты я могу найти в колоде твою уникальную карту. Если носить ее с собой, она будет символизировать и указывать дорогу, которая приведет к гармонии и принесет удачу. Я чувствую твои сомнения. Я должна подтвердить, что слияние энергий произошло и что контакт установлен в нужной мере. Чтобы это проверить, тебе необходимо добровольно выбрать карту из колоды. Если цвета карт, выбранных тобой и мной, совпадут, это подтвердит контакт. Если я потерплю неудачу, то заплачу тебе неустойку. Ты получишь назад три монеты — одной я искуплю прискорбную ошибку в моем предсказании. Хочешь, чтобы карты показали будущее? Ты точно ничего не потеряешь и, возможно, многое приобретешь!»

Сеанс заканчивается… дважды Первый вариант: вы платите две монеты, предсказательница выбирает удачную карту, а потом вы берете случайную карту из колоды. Цвета совпадают — обе карты красные. Контакт есть. Затем вам предсказывают будущее по картам, и вы выходите из комнаты, а предсказательница, явно утомленная соединением нитей судьбы, кладет монеты в карман и тихо покидает комнату. Второй вариант: вы платите две монеты, вам показывают удачную карту, вы выбираете вторую, но, к сожалению, цвета не совпадают — выпали красная и черная. Обещанный контакт не подтвержден. Предсказательница приносит извинения: тонкий план сегодня рассинхронизирован. Вам дают обещанные три монеты — две ваших и еще одну в качестве компенсации за разочарование. Гадалка извиняется. Возможно, получится в следующий раз, но и сейчас вы скорее приобрели, чем потеряли. Выходя из комнаты, вы богаче, чем были, когда вошли. И, может быть, уже подумываете зайти в другой раз, когда знамения будут благоприятными. Каким бы ни был финал, все это — мошенничество с целью наживы, но как оно работает? С виду все честно. Но почему люди ловятся на такие схемы в реальности? Схема аферы В чем же обман? Давайте посмотрим, как загадочная математика превращает вроде бы честную схему в принципиально мошенническую. За аферой стоит простая математическая ошибка, которую делают люди, чью бдительность усыпили образ предсказательницы и сценарий диалога (подробнее о нем ниже). Посмотрим на математическую подоплеку. Если наша искусственная гадалка выбирает удачную карту нужного цвета, ей достаются две монеты. Если у нее не получается, она платит три монеты. Этот штраф кажется приличным вознаграждением, пока вы не вспоминаете, что две из этих монет вы сами отдали за предсказание. Таким образом, если карты не совпадают, ИИ теряет только одну монету. Здравый смысл подсказывает, что нужно рассмотреть вероятность обоих исходов. Удачная карта, по сути, ерунда, это просто любая карта, взятая из полной колоды. Тестовая карта — еще одна случайная карта из оставшейся колоды. То есть это все равно что играть в цветной «Снап!» с полной перетасованной колодой. Шанс, что две карты совпадут по цвету (выпадут черная с черной или красная с красной), равен шансу, что карты не совпадут по цвету (выпадут красная с черной или черная с красной). Это шанс 50: 50.

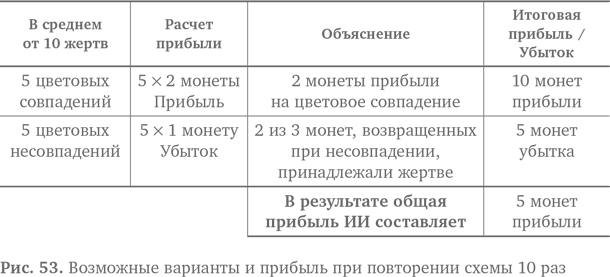

Если наш ИИ-псевдогадалка повторит эту схему несколько раз, то начнет получать деньги. Почему? Представьте, что у него появится 10 жертв. В среднем, сыграв 10 раз, 50% (пять человек) отыграют деньги, потому что карты не совпадут, однако 50% (пять человек) уйдут без наличности. На рис. 53 эта ситуация обобщена.

Чем больше людей сыграет, тем больше сможет получить мошенник-ИИ. Сделать ошибку довольно легко. Мы не видим, какие математические последствия повлекут наши действия в долгосрочной перспективе. Такие вещи происходят часто, и не только в случае мошенничества. Например, парадокс дня рождения: как это ни удивительно, если в одном помещении соберутся всего лишь 23 человека, шанс, что у двоих совпадет день рождения, равен 50%. Поймаем их на Барнума Теперь мы знаем, как устроена наша мошенническая схема. Но как заставить людей на нее купиться? Если не вдаваться в подробности, хватит убедительной математики. Если нечего терять, значит, нет причин не вступить в игру. Но есть и другие способы, которые помогут нам привлечь клиентов. В шестой главе мы говорили о виртуальном собеседнике— это системы ИИ, способные имитировать разговор. Они работают в беседах на общие темы, но можно ли создать с их помощью интерфейс для взаимодействия с клиентом, который будет таким же убедительным, как гадалка? У нас должно сразу сложиться впечатление, что виртуальный собеседник умеет предсказывать, — еще до того, как он предложит вытащить удачную карту. Но как псевдогадалке завоевать доверие? Для этого пригодятся так называемые утверждения Барнума, которые применяют, чтобы вызвать доверие, манипулируя нашим восприятием языка. Они названы в честь знаменитого циркового антрепренера Финеаса Барнума,который прославился своими мистификациями. Эффект Барнума основан на том, что люди склонны видеть точное описания себя в утверждениях, которые на самом деле применимы к большим группам, например «порой вы сомневаетесь в сделанном выборе» или «некоторые ваши сны очень далеки от реальности». Да уж! Конечно, они подходят всем, но в ходе экспериментов участники указывали, что именно эти утверждения относятся непосредственно к ним. Диалог с нашей ИИ-гадалкой с самого начала строится с использованием утверждений Барнума. То есть в разговоре фигурируют только обобщения, но мы обрабатываем их смысл таким образом, что нам кажется, будто ИИ обладает неким глубоким и мистическим знанием о нас. Так нас втягивают в аферу со счастливой картой. Как и любой виртуальный собеседник, наш тоже может вести более сложный диалог. Необязательно следовать точному сценарию. Можно на выбор взять набор утверждений Барнума. Это может быть случайный выбор, или же робот будет реагировать на высказывания жертвы с помощью наиболее подходящих утверждений Барнума, и тогда получится убедительнее. Вы, как создатель, сами определяете уровень сложности. Строим шаг за шагом Итак, у нас есть убедительная мошенническая схема и бот, который будет привлекать игроков и заставлять их расставаться с деньгами. Чтобы создать ИИ, который сможет целиком провернуть эту аферу, необходимы еще два элемента. Система должна проверять, действительно ли игрок отдал деньги. В противном случае может выясниться, что она сама стала жертвой обмана — радостно раздавала деньги, но ничего не брала себе! Ей нужно уметь проверять, положила ли жертва две монеты на стол. Но этот элемент мы уже создали — мы просто возьмем одну обученную нейронную сеть из главы 7.

Кроме того, нам нужно, чтобы она понимала, когда брать деньги, а когда платить. Для этого она должна проверять, действительно ли две выбранные карты одного цвета. Этот элемент мы тоже уже создали! Нам потребуется другая нейронная сеть из главы 7 — та, которая умеет играть в цветной «Снап!». Вот так, объединив старые и модифицированные компоненты, мы сделаем робота-мошенника. Это обычный чат-бот, работающий с утверждениями Барнума, наш счетчик монет, обученный необходимым действиям, и система, играющая в «Снап!», — только она не будет кричать «Снап!», а займется проверкой карт. Мы снова использовали декомпозицию. Каждая часть создавалась со своей целью, но с помощью некоторого обобщения отдельные модели можно свести вместе, чтобы создать нечто новое. Этика и мировое господство Создание ИИ, добро и зло Этот пример показывает, как создать работающую систему ИИ, объединив различные компоненты: чат-бот с утверждениями Барнума, счетчик монет и игрока в цветной «Снап!». Вообще, каждый из этих элементов можно создать из обычных предметов, которые найдутся дома, — карт, бумаги, ручек и монет. Для создания ИИ необязательно пользоваться компьютером, ведь вычисления производят разными способами. Конечно же, можно закодировать различные компоненты, абстрактные понятия и алгоритмы в виде программы, которая будет работать на компьютере. Но стоит ли заполнять мир ИИ, которые вот так обманывают людей? Мы использовали этот пример, чтобы объяснить, как работают вычислительные элементы, такие как сопоставление с образцом, обработка языка, нейронные системы и порождающие правила «ЕСЛИ–ТО», но специалисты по компьютерным наукам, которые создают реальные вычислительные системы, должны учитывать в своей работе этические моменты. Какие блага обеспечивают их системы и кому? Есть ли типы ИИ, которые не стоит создавать, и почему? Насколько допустимо манипулировать людьми, которые пользуются этими системами? Например, допустимо ли создавать системы, которые имитируют людей, чтобы обмануть, вызвать зависимость или каким-то образом навредить? Эти вопросы рассматриваются в этике, которая изучает, что плохо и что хорошо с точки зрения морали и нравственности. Разработчики ИИ должны соблюдать закон, однако некоторые явления законны, но в то же время приносят вред. Можно ли отнести ИИ-гадалку к такого рода явлениям? Что по этому поводу думаете вы и ваши друзья? Вычислительные системы существуют в обществе, и необходимо, чтобы они соответствовали его нормам, а будущие создатели ИИ должны это учитывать.

Главный вопрос… завладеют ли роботы миром? С того момента, как в 1921 г. была напечатана пьеса R.U.R., о которой мы говорили несколько глав назад, и в языке возник термин «робот», непрерывно появляются фильмы и телесериалы о роботах или ИИ, которые пытаются завладеть миром. Но какое отношение злонамеренные ИИ из фильмов имеют к научной реальности? Может ли ИИ завладеть миром? Каким образом он это сделает? И зачем ему это? Все, кто придумывает кинозлодеев, должны продумать предпосылки, без которых не обходится ни один сюжет, — мотивы и возможности. Ищем подходящий мотив Давайте рассмотрим возможные мотивы. Вряд ли кто-нибудь считает, что интеллект как таковой обязательно ведет к желанию завоевать мир. Если вы сдали школьные экзамены, значит ли это, что вы автоматически встали на путь зла? Конечно, нет. В фильмах ИИ часто действуют из соображений самосохранения — они понимают, что испуганные люди могут их отключить. Но зачем создавать у наших инструментов ощущение, что они находятся под угрозой? Они обеспечивают нам разные блага, и, кроме того, зачем наделять самосознанием систему, которая, например, ищет в интернете ближайший итальянский ресторан? Еще один популярный мотив для злодеяний искусственного интеллекта — рьяное следование логике. Например, такой сюжет: защитить Землю можно, только истребив все человечество. Это уничтожение из соображений логики напоминает представление, в соответствии с которым компьютер предпочтет остановившиеся часы опаздывающим на две секунды, потому что в первом случае часы показывают точное время два раза в день, а во втором — никогда. Такое обоснование сюжета, основанное на сомнительной логике в сочетании с пренебрежением к жизни, судя по всему, не согласуется с современными системами ИИ, которые в условиях неопределенности рассуждают математически и рассчитаны на безопасное взаимодействие с людьми. Айзек Азимов, один из классиков научной фантастики, продумал этот момент в сборнике рассказов о роботах «Я, робот». Там во всех роботов встроен неизменимый кодекс, «три закона роботехники», которые не дают им вредить человечеству. Шанс стучится в дверь Когда мы предполагаем, что ИИ теоретически может завоевать мир, для этого есть более веские основания. Известный тест Тьюринга для искусственного интеллекта был придуман, чтобы оценить конкретную способность — умение вести правдоподобную беседу. Предполагалось, что если нельзя увидеть разницу между собеседником-ИИ и человеком, то ИИ прошел тест и должен считаться таким же разумным, как человек.

Как же будет выглядеть тест Тьюринга, который обнаружит «способность» завоевать мир? Чтобы ответить на этот вопрос, нужно сравнить антисоциальные проявления ИИ с качествами потенциального властелина из числа людей. Завоевателям мира необходимо контролировать все важные сферы жизни — например, доступ к деньгам или возможность купить дом. ИИ делают это уже сейчас: например, решение о предоставлении кредита часто принимает ИИ, который просеивает горы информации, чтобы определить вашу платежеспособность. Кроме того, ИИ сейчас торгует на фондовом рынке. Властелин мира будет отдавать приказы и ждать, чтобы их выполняли. Всякий, кто в беспомощности стоял у кассы самообслуживания, которая непрерывно требовала положить товар в пакет или убрать его оттуда, знает, что значит оказаться под властью ИИ. Бинго «Мировое господство» Давайте сыграем в тематическое бинго, чтобы узнать, насколько ИИ приблизился к завоеванию мира. Для этого нужно сделать собственные карточки. Нарисуйте на каждой сетку, например 3 на 3, и в каждой клетке напишите качество, необходимое для мирового господства. Например, вспомните, как действует ваш любимый суперзлодей. Что предпримет новый властелин мира? Может быть, возьмет интернет под контроль? Лишит людей свободы передвижения? Или даже займется сбором налогов? Заполните карточку, указав по одному из злодейских действий в каждой клетке. Поменяйтесь с другом. Правила просты. Продвигаясь против часовой стрелки, ищите в интернете примеры того, что роботы или системы искусственного интеллекта делают то, что указано у вас в карточке. Найдите как можно больше вариантов. Когда найдете пример, запишите, на каком веб-сайте он описан, и вычеркните его. Постарайтесь отыскать подтверждения для примеров, которые заполнят сетку по вертикали или по горизонтали, как в обычном бинго. Первый, кто заполнит строку или столбик, кричит «Бинго!» (конечно же, голосом злого робота) и выигрывает. Но прежде чем закончить, проверьте, какие действия вычеркнуты и какие примеры, описанные на веб-страницах, им соответствуют. Если время ограничено, победит игрок, который вычеркнет максимум действий, но опять-таки убедитесь, что эти примеры реальны и что они соответствуют действиям суперзлодеев на карточках. Играя в эту игру, вы получите более полное представление о том, на что действительно способны сегодняшние роботы и ИИ. А потом можно либо начинать беспокоиться, либо почувствовать себя в безопасности. Убить Билла? Ни один голливудский робот с манией величия не обходится без хоть какого-то желания убивать. У нас уже есть дроны, созданные для убийства. Военные роботы могут определять цель без вмешательства людей. Сейчас команду атаковать дает управляющий ими человек, но вполне можно утверждать, что у этого ИИ есть потенциал убивать по своей воле. Но чтобы это стало возможно, придется изменить программный код. Впрочем, автономные роботы-убийцы уже существуют, хотя убивают и не людей. Пока мы пишем эти строки, в район Большого Барьерного рифа завозят роботов, которые будут выслеживать и убивать ядом морских звезд, разрушающих кораллы. Этим автоматам не потребуется приказ человека — оказавшись на свободе, они будут сами решать, кто умрет, а кто останется в живых. Возможно, эти примеры подтверждают, что ИИ контролирует ограниченные, хотя и важные сферы жизни на Земле. Но чтобы действительно завоевать мир, как в кино, отдельным системам ИИ придется действовать вместе и объединиться в синхронизированную армию. Властолюбивому автомату, который пробивает ваши покупки на кассе самообслуживания, чтобы помешать вам купить пиво, придется связаться с датчиком здоровья. Затем они оба могут вступить в сговор с системой, подсчитывающей кредитный рейтинг, и она пообещает повысить кредитный лимит, если вы купите кроссовки со встроенным датчиком GPS и будете есть только зеленый салат из умного холодильника. Конечно, холодильник будет открываться, только если от кроссовок поступят данные о завершении обязательной семикилометровой пробежки. Это тревожная картина, но, к счастью, она маловероятна. Разработчики по всему миру создают интернет вещей — сеть, объединяющую самые разные приборы и физические объекты, с помощью которой можно предлагать новые услуги. Чтобы завоевать мир, многочисленным кусочкам пазла нужно объединиться и образовать полную картину. Такая ситуация не очень вероятна — слишком много компонентов должно совпасть и одновременно сработать. Похоже на пресловутое противоречие в сюжете «Дня независимости», когда Apple Mac подключается к кораблю инопланетян. Поразительная межплатформенная совместимость. Наши земные системы ИИ, созданные с помощью различных языков программирования, по-разному хранят разные данные и используют разные и несовместимые наборы правил и техники обучения. Если они не задуманы как совместимые, нет никаких оснований считать, что две безопасно сконструированные системы ИИ, разработанные разными компаниями для разных целей, спонтанно объединятся и направят усилия на некую общую великую цель без человеческого вмешательства. Конечно, глобализация означает, что у современных гигантских компаний есть большое стремление приводить вещи в гармонию друг с другом, чтобы завладеть рынком и получать больше прибыли... Но могут ли системы ИИ и тела роботов, в которых они установлены, пройти тест и завладеть миром? Предположительно, только если мы, умные, но слабые людишки, разрешим им и серьезно поможем. Но зачем нам это делать? Может быть, из-за нашей человеческой глупости? Глава 9 Сетки, графика и игры Сетки и игры имеют важное значение. Сетки являются основой для многих игр. Кроме того, они занимают особое место в информационных технологиях. Например, они позволяют показать изображения. А игра о жизни, основанная на решетке, открыла абсолютно новое направление в информатике. Правила другой компьютерной игры на основе решетки помогут объяснить, почему люди больше не являются лучшими игроками на планете. Программисты превратили саму жизнь в одну из таких игр.

|

|||||||||

|

Последнее изменение этой страницы: 2021-01-14; просмотров: 108; Нарушение авторского права страницы; Мы поможем в написании вашей работы! infopedia.su Все материалы представленные на сайте исключительно с целью ознакомления читателями и не преследуют коммерческих целей или нарушение авторских прав. Обратная связь - 18.117.72.224 (0.02 с.) |