Заглавная страница Избранные статьи Случайная статья Познавательные статьи Новые добавления Обратная связь КАТЕГОРИИ: ТОП 10 на сайте Приготовление дезинфицирующих растворов различной концентрацииТехника нижней прямой подачи мяча. Франко-прусская война (причины и последствия) Организация работы процедурного кабинета Смысловое и механическое запоминание, их место и роль в усвоении знаний Коммуникативные барьеры и пути их преодоления Обработка изделий медицинского назначения многократного применения Образцы текста публицистического стиля Четыре типа изменения баланса Задачи с ответами для Всероссийской олимпиады по праву

Мы поможем в написании ваших работ! ЗНАЕТЕ ЛИ ВЫ?

Влияние общества на человека

Приготовление дезинфицирующих растворов различной концентрации Практические работы по географии для 6 класса Организация работы процедурного кабинета Изменения в неживой природе осенью Уборка процедурного кабинета Сольфеджио. Все правила по сольфеджио Балочные системы. Определение реакций опор и моментов защемления |

Биологический нейрон и его кибернетическая модельСтр 1 из 11Следующая ⇒

Оглавление 1. Введение . Основы из высшей математики Векторные пространства Матрицы и линейные преобразования векторов 3. Биологический нейрон и его кибернетическая модель Биологический нейрон Нейронные сети Структура простой рефлекторной нейронной сети Биологическая изменчивость и обучение нейронных сетей Формальный нейрон Обучение нейрона детектированию границы «черное - белое» Классификация нейронных сетей . Персептрон Розенблатта Теорема об обучении персептрона Линейная разделимость и персептронная представляемость . Принцип WTA в модели Липмана-Хемминга . Карта самоорганизации Кохонена . Нейронная сеть встречного распространения . Когнитрон и неокогнитрон Фукушимы Когнитрон - самоорганизующаяся многослойная нейросеть Неокогнитрон Неокогнитрон и инвариантное распознавание образов . Общее понятие сетей АРТ Дилемма стабильности-пластичности восприятия Принцип адаптивного резонанса Обучение сети АРТ Теоремы АРТ . Сжатие данных и ассоциативная память . Распознавание образов, классификация, категоризация . Современность нейросетевых технологий Черты современных архитектур Программное обеспечение Многообразие применения Вывод Практическая часть Список литературы Введение Искусственные нейронные сети (ИНС) - математические модели, а также их программные или аппаратные реализации, построенные по принципу организации и функционирования биологических нейронных сетей - сетей нервных клеток живого организма. Это понятие возникло при изучении процессов, протекающих в мозге, и при попытке смоделировать эти процессы. К рубежу 80-х годов были достигнуты значительные результаты в совсем молодой синергетике - науке о самоорганизации в неравновесных системах; систематизированы факты и проведены многочисленные новые эксперименты в нейрофизиологии, в частности, подробно изучено строение и механизм действия отдельных нейронов; сформулирован принцип работы и создана первая ЭВМ с параллельной архитектурой. Эти обстоятельства, по-видимому, стимулировали начало интенсивных исследований нейронных сетей, как моделей ассоциативной памяти. Широкий интерес к нейронным сетям был инициирован после появления работы Хопфилда (Hopfield J.J., 1982), который показал, что задача с изинговскими нейронами может быть сведена к обобщениям ряда моделей, разработанных к тому моменту в физике неупорядоченных систем. Работа сети Хопфилда (наиболее подробно обсуждаемая в физической литературе) состоит в релаксации начального "спинового портрета" матрицы двоичных кодов к одному из стационарных состояний, определяемых правилом обучения (правилом Хебба). Таким образом, данная сеть может применяться для задач распознавания.

В 1986 году появилась работа Румельхарта, Хинтона и Вильямса (Rumelhart D.E., Hinton G.E., Williams R.J., 1986), содержавшая ответ на вопрос, долгое время сдерживавший развитие нейроинформатики - как обучаются иерархические слоистые нейронные сети, для которых "классиками" еще в 40-50 х годах была доказана универсальность для широкого класса задач. В последующие годы предложенный Хинтоном алгоритм обратного распространения ошибок претерпел бесчисленное множество вариаций и модификаций. Многообразие предлагаемых алгоритмов, характеризующихся различной степенью детальности проработки, возможностями их параллельной реализации, а также наличием аппаратной реализации, приводит к особой актуальности исследования по сравнительным характеристикам различных методик. "Подмигните компьютеру - он поймет". В начале 90-х под таким заголовком в старейшей уважаемой газете Нью-Йорк Таймс появилась статья, рассказывающая о современных достижениях и направлениях в области интеллектуальных компьютерных систем. Среди магистральных путей развития данной отрасли эксперты издания выделили: · Компьютеры с высокой степенью параллелизма обработки информации, которые могут разделить ту или иную задачу на части и обрабатывать их одновременно, тем самым значительно сокращая общее время вычислений; · Компьютеры, в которых вместо электронных сигналов для передачи информации используется оптика. Оптические сигналы уже начали использоваться для передачи данных между компьютерами; · Компьютеры с нейронными сетями, представляющие собой машины, работающие аналогично тому, как по нашим современным представлениям, функционирует мозг.

Третье направление представляет наибольший интерес, так как нейронные сети - мощный и на сегодня, пожалуй, наилучший метод для решения задач распознавания образов в ситуациях, когда в экспериментальных данных отсутствуют значительные фрагменты информации, а имеющаяся информация предельно зашумлена. Высокая степень параллельности, допускаемая при реализации нейросистем, обеспечивает обработку недоступных оператору объемов информации за времена, меньшие или сравнимые с допустимыми временами измерений. Свой вклад в становление нейронауки внесли биология и физиология высшей нервной деятельности, психология восприятия, дискретная математика, статистическая физика и синергетика, и, конечно, кибернетика и, конечно, компьютерное моделирование. Нейронаука в современный момент переживает период перехода от юного состояния к зрелости. Развитие в области теории и приложений нейронных сетей идет в самых разных направлениях: идут поиски новых нелинейных элементов, которые могли бы реализовывать сложное коллективное поведение в ансамбле нейронов, предлагаются новые архитектуры нейронных сетей, идет поиск областей приложения нейронных сетей в системах обработки изображений, распознавания образов и речи, робототехники и др. Значительное место в данных исследованиях традиционно занимает математическое моделирование.

Основы из высшей математики Традиционно используемым для описания нейронных сетей математическим языком является аппарат векторной и матричной алгебры, кроме них дифференциальные уравнения, применяемые для анализа нейронных сетей в непрерывном времени, а также для построения детальных моделей нейрона; Фурье-анализ для описания поведения системы при кодировании в частотной области; теория оптимизации как основа для разработки алгоритмов обучения; математическая логика и булева алгебра - для описания двоичных сетей, и другие.

Векторные пространства

Основным структурным элементом в описании способов обработки информации нейронной сетью является вектор - упорядоченный набор чисел, называемых компонентами вектора. В предлагаемом рассмотрении не будем делать разницы в понятиях вектор (упорядоченная совокупность компонент) и образ (совокупность черт или признаков образа). Способы выбора совокупности признаков и формирования информационного вектора определяются конкретными приложениями.

Примеры векторов: а) булев вектор с 25 компонентами, нумеруемыми по строкам, б) действительный вектор из пространства R4. Множество векторов с действительными компонентами является частным случаем более общего понятия, называемого линейным векторным пространством V, если для его элементов определены операции векторного сложения "+" и умножения на скаляр".", удовлетворяющие перечисленным ниже соотношениям (здесь x, y, z - вектора из V, а a, b - скаляры из R): 1. x + y = y + x, результат принадлежит V (свойство коммутативности) 2. a . (x + y) = a . x + a . y, результат принадлежит V (свойством дистрибутивности) . (a + b) . x = a . x + b . x, результат принадлежит V (свойством дистрибутивности)

. (x + y) + z = x + (y + z), результат принадлежит V (свойством ассоциативности введенных операций.) . (a . b) . x = a . (b . x), результат принадлежит V 6. $ o из V: " x из V => o + x = x (существует нулевой элемент) . для скаляров 0 и 1, " x из V имеем 0 . x = o, 1 . x = x Для математического описания степени сходства векторное пространство может быть снабжено скалярной метрикой - расстоянием d(x,y) между всякими двумя векторами x и y. Пространства, с заданной метрикой называют метрическими. Для метрики должны выполняться условия неотрицательности, симметричности, а также неравенство треугольника: . d (x, y) >= 0, причем d (y, x) = 0 <=> x = y . d (x, y) = d (y, x) 3. " y, d (x, z) <= d (x, y) + d (y, z) Далее будем использовать в основном две метрики - Евклидово расстояние и метрика Хемминга. Евклидова метрика для прямоугольной системы координат определяется формулой:

Хеммингово расстояние dH используется обычно для булевых векторов (компоненты которых равны 0 или 1), и равно числу различающихся в обоих векторах компонент. Для векторов вводится понятие нормы ||x|| - длины вектора x. Пространство в котором определена норма векторов называется нормированным. Норма должна обладать следующими свойствами: 1. ||x|| >= 0, причем ||x|| = 0 <=> x = o . || a.x || = |a| ||x|| . ||x + y|| <= ||x|| + ||y|| Для образов, состоящих из действительных признаков мы будем в дальнейшем иметь дело именно с Евклидовым пространством. В случае булевых векторов размерности n рассматриваемое пространство представляет собой множество вершин n-мерного гиперкуба с Хемминговой метрикой. Расстояние между двумя вершинами определяется длиной кратчайшего соединяющего их пути, измеренной вдоль ребер. Важным для нейросетевых приложений случаем является множество векторов, компоненты которых являются действительными числами, принадлежащими отрезку [0,1]. Множество таких векторов не является линейным векторным пространством, так как их сумма может иметь компоненты вне рассматриваемого отрезка. Однако для пары таких векторов сохраняются понятия скалярного произведения и Евклидового расстояния. Вторым интересным примером, важным с практической точки зрения, является множество векторов одинаковой длины (равной, например, единице). Образно говоря, "кончики" этих векторов принадлежат гиперсфере единичного радиуса в n-мерном пространстве. Гиперсфера также не является линейным пространством (в частности, отсутствует нулевой элемент). Для заданной совокупности признаков, определяющих пространство векторов, может быть сформирован такой минимальный набор векторов, в разной степени обладающих этими признаками, что на его основе, линейно комбинируя вектора из набора, можно сформировать все возможные иные вектора. Такой набор называется базисом пространства.

2.2 Матрицы и линейные преобразования векторов

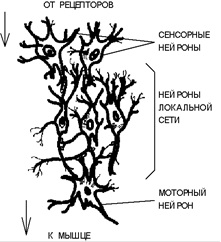

Равно тому, как был рассмотрен вектор - объект, определяемый одним индексом (номером компоненты или признака), может быть введен и объект с двумя индексами, матрица. Эти два индекса определяют компоненты матрицы Aij, располагаемые по строкам и столбцам, причем первый индекс i определяет номер строки, а второй j - номер столбца. Приведем некоторые тождества для операций над матрицами. Для всяких A,B и C и единичной матрицы I имеет место: . IA = AI = A . (AB)C = A(BC) . A(B+C) = AB + AC . (AT)T = A . (A+B)T = AT + BT . (AB)T = BTAT Биологический нейрон Элементом клеточной структуры мозга является нервная клетка - нейрон. Нейрон в своем строении имеет много общих черт с другими клетками биоткани: тело нейрона окружено плазматической мембраной, внутри которой находится цитоплазма, ядро и другие составляющие клетки. Однако нервная клетка существенно отличается от иных по своему функциональному назначению. Нейрон выполняет прием, элементарное преобразование и дальнейшую передачу информации другим нейронам. Информация переносится в виде импульсов нервной активности, имеющих электрохимическую природу. Нейроны крайне разнообразны по форме, которая зависит от их местонахождения в нервной системе и особенностей функционирования. Тело клетки содержит множество ветвящихся отростков двух типов. Отростки первого типа, называемые дендритами за их сходство с кроной раскидистого дерева, служат в качестве входных каналов для нервных импульсов от других нейронов. Эти импульсы поступают в сому или тело клетки размером от 3 до 100 микрон, вызывая ее специфическое возбуждение, которое затем распространяется по выводному отростку второго типа - аксону. Длина аксонов обычно заметно превосходит размеры дендритов, в отдельных случаях достигая десятков сантиметров и даже метров. Тело нейрона, заполненное проводящим ионным раствором, окружено мембраной толщиной около 75 ангстрем, обладающей низкой проводимостью. Между внутренней поверхностью мембраны аксона и внешней средой поддерживается разность электрических потенциалов. Это осуществляется при помощи молекулярного механизма ионных насосов, создающих различную концентрацию положительных ионов K+ и Na+ внутри и вне клетки. Проницаемость мембраны нейрона селективна для этих ионов. Внутри аксона клетки, находящейся в состоянии покоя, активный транспорт ионов стремится поддерживать концентрацию ионов калия более высокой, чем ионов натрия, тогда как в жидкости, окружающей аксон, выше оказывается концентрация ионов Na+. Пассивная диффузия более подвижных ионов калия приводит к их интенсивному выходу из клетки, что обуславливает ее общий отрицательный относительно внешней среды потенциал покоя, составляющий около -65 милливольт.

Общая схема строения биологического нейрона.

Под воздействием стимулирующих сигналов от других нейронов мембрана аксона динамически изменяет свою проводимость. Мембрана на короткое время, составляющее около 2 миллисекунд, изменяет свою полярность (деполяризуется) и достигает потенциала действия около +40 мв. В дальнейшем, по мере выхода ионов калия, положительный заряд с внутренней стороны мембраны меняется на отрицательный, и наступает так называемый период рефрактерности, длящийся около 200 мс. В течении этого времени нейрон является полностью пассивным, практически неизменно сохраняя потенциал внутри аксона на уровне около -70 мв. Импульс деполяризации клеточной мембраны, называемый спайком, распространяется вдоль аксона практически без затухания, поддерживаясь локальными ионными градиентами. Возбуждение нейрона в виде спайка передается другим нейронам, которые таким образом объединены в проводящую нервные импульсы сеть. Участки мембраны на аксоне, где размещаются области контакта аксона данного нейрона с дендритами другими нейронов, называются синапсами. В области синапса, имеющего сложное строение, происходит обмен информацией о возбуждении между нейронами. Механизмы синаптической передачи могут иметь химическую и электрическую природу. В химическом синапсе в передаче импульсов участвуют специфические химические вещества - нейромедиаторы, вызывающие изменения проницаемости локального участка мембраны. В зависимости от типа вырабатываемого медиатора синапс может обладать возбуждающим (эффективно проводящим возбуждение) или тормозящим действием. Обычно на всех отростках одного нейрона вырабатывается один и тот же медиатор, и поэтому нейрон в целом функционально является тормозящим или возбуждающим. Это важное наблюдение о наличии нейронов различных типов существенно используется при проектировании искусственных систем.

Нейронные сети

Взаимодействующие между собой посредством передачи через отростки возбуждений нейроны формируют нейронные сети. Переход от рассмотрения отдельного нейрона к изучению нейронных сетей является естественным шагом в нейробиологической иерархии. Выделяют несколько (обычно три) основных типов нейронных сетей, отличающихся структурой и назначением. Первый тип составляют иерархические сети, часто встречающиеся в сенсорных и двигательных путях. Информация в таких сетях передается в процессе последовательного перехода от одного уровня иерархии к другому.

Формальный нейрон

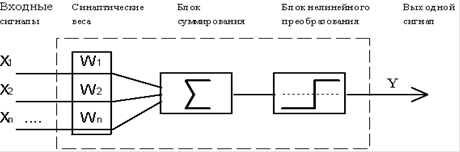

Функциональная схема формального нейрона МакКалока и Пиитса.

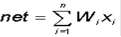

С современной точки зрения, формальный нейрон представляет собой математическую модель простого процессора, имеющего несколько входов и один выход. Вектор входных сигналов (поступающих через "дендриты") преобразуется нейроном в выходной сигнал (распространяющийся по "аксону") с использованием трех функциональных блоков: локальной памяти, блока суммирования и блока нелинейного преобразования. Вектор локальной памяти содержит информацию о весовых множителях, с которыми входные сигналы будут интерпретироваться нейроном. Эти переменные веса являются аналогом чувствительности пластических синаптических контактов. Выбором весов достигается та или иная интегральная функция нейрона. В блоке суммирования происходит накопление общего входного сигнала (обычно обозначаемого символом net), равного взвешенной сумме входов:

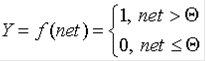

В модели Маккалока и Питтса отсутствуют временные задержки входных сигналов, поэтому значение net определяет полное внешнее возбуждение, воспринятое нейроном. Отклик нейрон далее описывается по принципу "все или ничего", т. е. переменная подвергается нелинейному пороговому преобразованию, при котором выход (состояние активации нейрона) Y устанавливается равным единице, если net > Q, и Y=0 в обратном случае. Значение порога Q (часто полагаемое равным нулю) также хранится в локальной памяти. Важным развитием теории формального нейрона является переход к аналоговым (непрерывным) сигналам, а также к различным типам нелинейных переходных функций. Опишем наиболее широко используемые типы переходных функций Y=f(net). · Пороговая функция (рассмотренная Маккалоком и Питтсом):

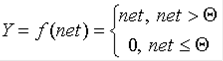

· Линейная функция, а также ее вариант - линейная функция с погашением отрицательных сигналов:

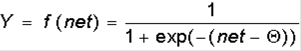

· Сигмоидальная функция:

Сигмоидальная функция обладает избирательной чувствительностью к сигналам разной интенсивности, что соответствует биологическим данным. Наибольшая чувствительность наблюдается вблизи порога, где малые изменения сигнала net приводят к ощутимым изменениям выхода. Напротив, к вариациям сигнала в областях значительно выше или ниже порогового уровня сигмоидальная функция не чувствительна, так как ее производная при больших и малых аргументах стремится к нулю.

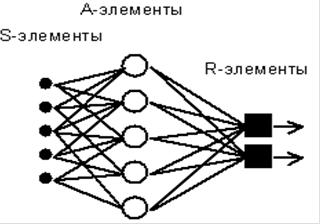

Персептрон Розенблатта Одной из первых искусственных сетей, способных к перцепции (восприятию) и формированию реакции на воспринятый стимул, явился PERCEPTRON Розенблатта (F.Rosenblatt, 1957). Персептрон рассматривался его автором не как конкретное техническое вычислительное устройство, а как модель работы мозга.

Элементарный персептрон Розенблатта.

Простейший классический персептрон содержит нейроподобные элементы трех типов, назначение которых в целом соответствует нейронам рефлекторной нейронной сети, рассмотренной в предыдущей лекции. S-элементы формируют сетчатку сенсорных клеток, принимающих двоичные сигналы от внешнего мира. Далее сигналы поступают в слой ассоциативных или A-элементов (для упрощения изображения часть связей от входных S-клеток к A-клеткам не показана). Только ассоциативные элементы, представляющие собой формальные нейроны, выполняют нелинейную обработку информации и имеют изменяемые веса связей. R-элементы с фиксированными весами формируют сигнал реакции персептрона на входной стимул. Представленная сеть обычно называется однослойной, так как имеет только один слой нейропроцессорных элементов. Однослойный персептрон характеризуется матрицей синаптических связей W от S- к A-элементам. Элемент матрицы

Неокогнитрон О распознавании образов независимо от их положения, ориентации, а иногда и размера и других деформации, говорят как об инвариантном относительно соответствующих преобразований распознавании. Дальнейшие исследования группы под руководством К. Фукушимы привели к развитию когнитрона и разработке новой нейросетевой парадигмы - НЕОКОГНИТРОНА, который способен к инвариантному распознаванию.

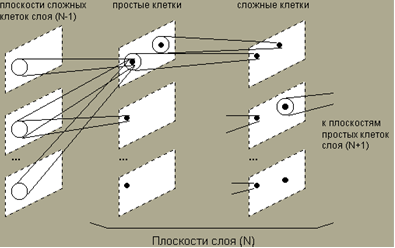

8.3 Неокогнитрон и инвариантное распознавание образов Неокогнитрон состоит из иерархии нейронных слоев, каждый из которых состоит из массива плоскостей. Каждый элемент массива состоит из пары плоскостей нейронов. Первая плоскость состоит из так называемых простых нейроклеток, которые получают сигналы от предыдущего слоя и выделяют определенные образы. Эти образы далее обрабатываются сложными нейронами второй плоскости, задачей которых является сделать выделенные образы менее зависимыми от их положения. Нейроны каждой пары плоскостей обучаются реагировать на определенный образ, представленный в определенной ориентации. Для другого образа или для нового угла поворота образа требуется новая пара плоскостей. Таким образом, при больших объемах информации, неокогнитрон представляет собой огромную структуру с большим числом плоскостей и слоев нейронов. Простые нейроны чувствительны к небольшой области входного образа, называемой рецептивной областью (или что тоже самое, областью связей). Простой нейрон приходит в возбужденное состояние, если в его рецептивной области возникает определенный образ. Рецептивные области простых клеток перекрываются и покрывают все изображение. Сложные нейроны получают сигналы от простых клеток, при этом для возбуждения сложного нейрона достаточно одного сигнала от любого простого нейрона. Тем самым, сложная клетка регистрирует определенный образ независимо от того, какой из простых нейронов выполнил детектирование, и, значит, независимо от его расположения. По мере распространения информации от слоя слою картинка нейронной активности становится все менее чувствительной к ориентации и расположению образа, и, в определенных пределах, к его размеру. Нейроны выходного слоя выполняют окончательное инвариантное распознавание.

Общая схема НЕОКОГНИТРОНА. Области связей показаны большими белыми кружками, а области конкуренции - маленькими темными. Неокогнитрон успешно проявил себя при распознавании символов. Нужно отметить, что структура этой сети необычайно сложна, и объем вычислений очень велик, поэтому компьютерные модели неокогнитрона будут слишком дорогими для промышленных приложений.

Общее понятие сетей АРТ Обучение сети АРТ

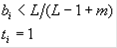

В начале функционирования все веса B и T нейронов, а также параметр сходства получают начальные значения. Согласно теории АРТ, эти значения должны удовлетворять условию

где m - число компонент входного вектора X, значение L>1. Процесс обучения происходит без учителя, на основе самоорганизации. Обучение производится для весов нейрона-победителя в случае как успешной, так и неуспеншной классификации. При этом веса вектора B стремятся к нормализованной величине компонент вектора C:

При этом роль нормализации компонент крайне важна. Вектора с большим число единиц приводят к небольшим значениям весов b, и наоборот. Таким образом, произведение

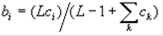

оказывается масштабированным. Масштабирование приводит к тому, что возможно правильное различение векторов, даже если один является подмножеством другого. Пусть нейрон X1 соответствует образу (100000), а нейрон X2 - образу (111100). Эти образы являются, очевидно, различными. При обучении без нормализации (т.е. bi ® ci) при поступлении в сеть первого образа, он даст одинаковые скалярные произведения, равные 1, как с весами нейрона X1, так и X2. Нейрон X2, в присутствии небольших шумовых отклонений в значениях весов, может выиграть конкуренцию. При этом веса его вектора T установятся равными (100000), и образ (111100) будет безвозвратно "забыт" сетью. При применении нормализации исходные скалярные произведения будут равны единице для нейрона X1, и значению 2/5 для нейрона X2 (при L=2). Тем самым, нейрон X1 заслуженно и легко выиграет конкурентное соревнование. Компоненты вектора T, как уже говорилось, при обучении устанавливаются равными соответствующим значениям вектора C. Следует подчеркнуть, что это процесс необратим. Если какая-то из компонент tj оказалась равной нулю, то при дальнейшем обучении на фазах сравнения соответствующая компонента cj никогда не получит подкрепления от tj=0 по правилу 2/3, и, следовательно, единичное значение tj не может быть восстановлено. Обучение, таким образом, сопровождается обнулением все большего числа компонент вектора T, оставшиеся ненулевыми компоненты определяют множество критических черт данной категории.

Обучающие образы C и сформированный вектор критических черт T - минимальный набор общих элементов категории.

Теоремы АРТ 1. По достижении стабильного состояния обучения предъявление одного из обучающих векторов будет сразу приводить к правильной классификации без фазы поиска, на основе прямого доступа. 2. Процесс поиска устойчив.3. Процесс обучения устойчив. Обучение весов нейрона-победителя не приведет в дальнейшем к переключению на другой нейрон.4. Процесс обучения конечен. Обученное состояние для заданного набора образов будет достигнуто за конечное число итерации, при этом дальнейшее предъявление этих образов не вызовет циклических изменений значений весов. Развитие теории АРТ продолжается. По высказыванию авторов теории, АРТ представляет собой нечто существенно более конкретное, чем философское построение, но намного менее конкретное, чем законченная программа для компьютера. Однако уже в современном виде, опираясь на свою более чем 20-летнюю историю, сети АРТ демонстрируют свои успешные применения в различных областях. АРТ сделала также важный шаг в общей проблеме моделирования пластично-стабильного восприятия.

Сбор данных для обучения. Выбор данных для обучения сети и их обработка является самым сложным этапом решения задачи. Набор данных для обучения должен удовлетворять нескольким критериям: Репрезентативность - данные должны иллюстрировать истинное положение вещей в предметной области; Непротиворечивость - противоречивые данные в обучающей выборке приведут к плохому качеству обучения сети; Исходные данные преобразуются к виду, в котором их можно подать на входы сети. Каждая запись в файле данных называется обучающей парой или обучающим вектором. Обучающий вектор содержит по одному значению на каждый вход сети и, в зависимости от типа обучения (с учителем или без), по одному значению для каждого выхода сети. Обучение сети на «сыром» наборе, как правило, не даёт качественных результатов. Существует ряд способов улучшить «восприятие» сети. Нормировка выполняется, когда на различные входы подаются данные разной размерности. Например, на первый вход сети подается величины со значениями от нуля до единицы, а на второй - от ста до тысячи. При отсутствии нормировки значения на втором входе будут всегда оказывать существенно большее влияние на выход сети, чем значения на первом входе. При нормировке размерности всех входных и выходных данных сводятся воедино; Квантование выполняется над непрерывными величинами, для которых выделяется конечный набор дискретных значений. Например, квантование используют для задания частот звуковых сигналов при распознавании речи; фильтрация выполняется для «зашумленных» данных. Кроме того, большую роль играет само представление как входных, так и выходных данных. Предположим, сеть обучается распознаванию букв на изображениях и имеет один числовой выход - номер буквы в алфавите. В этом случае сеть получит ложное представление о том, что буквы с номерами 1 и 2 более похожи, чем буквы с номерами 1 и 3, что, в общем, неверно. Для того, чтобы избежать такой ситуации, используют топологию сети с большим числом выходов, когда каждый выход имеет свой смысл. Чем больше выходов в сети, тем большее расстояние между классами и тем сложнее их спутать. Подготовка и нормализация данных. ) Выбор топологии сети. Выбирать тип сети следует исходя из постановки задачи и имеющихся данных для обучения. Для обучения с учителем требуется наличие для каждого элемента выборки «экспертной» оценки. Иногда получение такой оценки для большого массива данных просто невозможно. В этих случаях естественным выбором является сеть, обучающаяся без учителя, например, самоорганизующаяся карта Кохонена или нейронная сеть Хопфилда. При решении других задач, таких как прогнозирование временных рядов, экспертная оценка уже содержится в исходных данных и может быть выделена при их обработке. В этом случае можно использовать многослойный перцептрон или сеть Ворда. Собственно обучение. В процессе обучения сеть в определенном порядке просматривает обучающую выборку. Порядок просмотра может быть последовательным, случайным и т. д. Некоторые сети, обучающиеся без учителя, например, сети Хопфилда просматривают выборку только один раз. Другие, например, сети Кохонена, а также сети, обучающиеся с учителем, просматривают выборку множество раз, при этом один полный проход по выборке называется эпохой обучения. При обучении с учителем набор исходных данных делят на две части - собственно обучающую выборку и тестовые данные; принцип разделения может быть произвольным. Обучающие данные подаются сети для обучения, а проверочные используются для расчета ошибки сети (проверочные данные никогда для обучения сети не применяются). Таким образом, если на проверочных данных ошибка уменьшается, то сеть действительно выполняет обобщение. Если ошибка на обучающих данных продолжает уменьшаться, а ошибка на тестовых данных увеличивается, значит, сеть перестала выполнять обобщение и просто «запоминает» обучающие данные. Это явление называется переобучением сети или оверфиттингом. В таких случаях обучение обычно прекращают. В процессе обучения могут проявиться другие проблемы, такие как паралич или попадание сети в локальный минимум поверхности ошибок. Невозможно заранее предсказать проявление той или иной проблемы, равно как и дать однозначные рекомендации к их разрешению. Программное обеспечение

К настоящему времени сформировался обширный рынок нейросетевых продуктов. Подавляющее большинство продуктов представлено в виде моделирующего программного обеспечения. Ведущие фирмы разрабатывают также и специализированные нейрочипы или нейроплаты в виде приставок к обычным ЭВМ (как правило, персональным ЭВМ линии IBM PC AT). При этом программы могут работать как без нейро-приставок, так и с ними. В последнем случае быстродействие гибридной ЭВМ возрастает в сотни и тысячи раз. Некоторые наиболее извесные и популярные нейросистемы: NeuralWorks Professional II Plus, ExploreNet 3000, NeuroShell 2.0

Многообразие применения

Нейронные сети - универсальные аппроксимирующие устройства и могут с любой точностью имитировать любой непрерывный автомат. Результаты работ М. Доррера и др. дают подход к раскрытию механизма интуиции нейронных сетей, проявляющейся при решении ими психодиагностических задач. Нейронные сети широко используются в химических и биохимических исследованиях. Так же важна их роль при прогнозировании динамики фондовых рынков и других экономических задач. Возможно применение нейросетевых моделей в составе геоинформационных систем. И, конечно, в решении различных математических и физических задач и т.д.

Вывод ИНС представляют собой систему соединённых и взаимодействующих между собой простых процессоров (искусственных нейронов). Такие процессоры обычно довольно просты, особенно в сравнении с процессорами, используемыми в персональных компьютерах. Каждый процессор подобной сети имеет дело только с сигналами, которые он периодически получает, и сигналами, которые он периодически посылает другим процессорам. И тем не менее, будучи соединёнными в достаточно большую сеть с управляемым взаимодействием, такие локально простые процессоры вместе способны выполнять довольно сложные задачи. С точки зрения машинного обучения, нейронная сеть представляет собой частный случай методов распознавания образов, дискриминантного анализа, методов кластеризации и т. п. С математической точки зрения, обучение нейронных сетей - это многопараметрическая задача нелинейной оптимизации. С точки зрения кибернетики, нейронная сеть используется в задачах адаптивного управления и как алгоритмы для робототехники. С точки зрения развития вычислительной техники и программирования, нейронная сеть - способ решения проблемы эффективного параллелизма. А с точки зрения искусственного интеллекта, ИНС является основой философского течения коннективизма и основным направлением в структурном подходе по изучению возможности построения (моделирования) естественного интеллекта с помощью компьютерных алгоритмов. Нейронные сети не программируются в привычном смысле этого слова, они обучаются. Возможность обучения - одно из главных преимуществ нейронных сетей перед традиционными алгоритмами. Технически обучение заключается в нахождении коэффициентов связей между нейронами. В процессе обучения нейронная сеть способна выявлять сложные зависимости между входными данными и выходными, а также выполнять обобщение. Это значит, что, в случае успешного обучения, сеть сможет вернуть верный результат на основании данных, которые отсутствовали в обучающей выборке, а также неполных и/или «зашумленных», частично искаженных данных. Следует отметить, что вычислительные системы, основанные на искусственных нейронных сетях, обладают рядом качеств, которые присущи мозгу человека: массовый параллелизм; распределённое представление информации и вычисления; способность к обучению и обобщению; адаптивность; свойство контекстуальной обработки информации; толерантность к ошибкам; низкое энергопотребление. В заключение можно сказать, что в данной работе были рассмотрены историческое формирование и развитие нейронауки, общие основы и введения в область искусственных нейронных систем и нейросетевого моделирования, выделены виды их реализации и самого процесса аппаратного «восприятия», а так же описаны различные виды нейросетей и их особенности. Подчеркивается важность нейросетевых технологий в современной науке и жизни, которая объясняется многообразием их применения; уделяется внимание продолжающемуся развитию искусственной нейроиндустрии.

Практическая часть Лабораторная работа № 1 Слоёв сети.

|

|||||||||

|

Последнее изменение этой страницы: 2020-12-09; просмотров: 173; Нарушение авторского права страницы; Мы поможем в написании вашей работы! infopedia.su Все материалы представленные на сайте исключительно с целью ознакомления читателями и не преследуют коммерческих целей или нарушение авторских прав. Обратная связь - 18.222.125.171 (0.097 с.) |

отвечает связи, ведущей от i-го S-элемента к j-му A-элементу.

отвечает связи, ведущей от i-го S-элемента к j-му A-элементу.