Заглавная страница Избранные статьи Случайная статья Познавательные статьи Новые добавления Обратная связь КАТЕГОРИИ: ТОП 10 на сайте Приготовление дезинфицирующих растворов различной концентрацииТехника нижней прямой подачи мяча. Франко-прусская война (причины и последствия) Организация работы процедурного кабинета Смысловое и механическое запоминание, их место и роль в усвоении знаний Коммуникативные барьеры и пути их преодоления Обработка изделий медицинского назначения многократного применения Образцы текста публицистического стиля Четыре типа изменения баланса Задачи с ответами для Всероссийской олимпиады по праву

Мы поможем в написании ваших работ! ЗНАЕТЕ ЛИ ВЫ?

Влияние общества на человека

Приготовление дезинфицирующих растворов различной концентрации Практические работы по географии для 6 класса Организация работы процедурного кабинета Изменения в неживой природе осенью Уборка процедурного кабинета Сольфеджио. Все правила по сольфеджио Балочные системы. Определение реакций опор и моментов защемления |

Количество информации: вероятностный и объемный подходы

Вычисление количества информации Основатель теории информации К. Шеннон предложил способ вычисления количества информации, содержащейся в одном случайном объекте относительно другого случайного объекта. В простейшем случае рассматриваются две случайные величины: X=x1,..., xN; Y=y1,..., yM. Случайная величина X принимает свои значения с вероятностями P1, ….,PN соответственно, а случайная величина Y – Q1, ….,QM. Тогда количество информации относительно Y, содержащейся в X, определяется формулой

Здесь Pij – вероятность совмещения событий X=xi, Y=yj. Единицей информации является один бит (бинарный информационный терм). Количество информации в один бит, I=1 можно получить в частном случае, когда события независимы, и выполняются следующие равенства: Pi=Qj=0,5; Pij=0,5; i=j=1,2. Обратимся теперь к системотехническому подходу. Мерой неопределенности системы обычно служит ее энтропия. Для того, чтобы измерять ее в битах, вычислим энтропию системы с N входами, M выходами и K единицами в таблице вход-выход по формуле:

Из нее видно, что энтропия равна одному биту, когда число возможных состояний системы равно 2. Существуют два тривиальных случая, когда система пуста, и К=0, или когда система полностью определена, и K=MN. В обоих тривиальных случаях энтропия равна нулю, Н=0. Получив средство для измерения такого важного свойства системы, каким является мера неопределенности - энтропия, можно рассмотреть понятие информации. Для этого предположим, что для системы известна начальная энтропия Ннач. Если о ней ничего неизвестно, то в качестве начальной энтропии целесообразно выбирать энтропию тривиальных случаев, когда Ннач=0. Затем необходимо сформулировать задачу идентификации системы: для данной системы определить число единиц таблицы вход-выход. Эта задача соответствует тому методу, который был использован при определении понятия информации в [1]. Зная К и MN, легко вычислить энтропию системы, обозначив ее как конечную энтропию Нкон. Теперь информация, полученная в результате решения задачи идентификации, может быть определена как абсолютная величина полученного приращения энтропии: I=abs(Нкон - Ннач). Функция abs() используется для того, чтобы не получать отрицательных значений информации (дезинформации), когда Ннач > Нкон. Заметим также, что при Ннач=0 информация совпадает с конечной энтропией: I=Нкон.

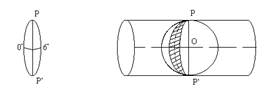

Таким образом, предложены различные подходы к определению понятия информации и вычислению ее количества. Все они связаны с получением новых сведений об объекте в процессе его исследования. Считается, что именно оно может привести к приращению знаний об объекте. Данные Для практического использования требуется систематизированная, предварительно подготовленная информация. Такаяинформация представлена в компьютере данными. Когда говорят о подготовке информации, часто подразумевают представление ее в определенном формате данных. Например, может идти речь о данных в текстовом редакторе MS Word, табличном процессоре MS Excel, в системе управления базами данных MS Access и др. В информационных системах термин данные имеет три различных значения: Ø Данные – как объекты, отличные от команд. Ø Данные – как входные данные в противоположность результатам, или выходным данным. Ø Данные– как текст, числа или изображения. Архитектура данных показана на рис.2.1. В ней отражена динамика переходов данных от двоичного разряда (бита – бинарного информационного терма) до файла как поименованной совокупности машинных слов, состоящих из целого числа байт (восемь бит).

Рис.2.1 Архитектура данных

Таким образом, информация и ее носители - данные являются главными объектами хранения, передачи и обработки.

|

|||||

|

Последнее изменение этой страницы: 2017-02-06; просмотров: 237; Нарушение авторского права страницы; Мы поможем в написании вашей работы! infopedia.su Все материалы представленные на сайте исключительно с целью ознакомления читателями и не преследуют коммерческих целей или нарушение авторских прав. Обратная связь - 3.144.243.184 (0.007 с.) |

.

. .

.