Заглавная страница Избранные статьи Случайная статья Познавательные статьи Новые добавления Обратная связь КАТЕГОРИИ: ТОП 10 на сайте Приготовление дезинфицирующих растворов различной концентрацииТехника нижней прямой подачи мяча. Франко-прусская война (причины и последствия) Организация работы процедурного кабинета Смысловое и механическое запоминание, их место и роль в усвоении знаний Коммуникативные барьеры и пути их преодоления Обработка изделий медицинского назначения многократного применения Образцы текста публицистического стиля Четыре типа изменения баланса Задачи с ответами для Всероссийской олимпиады по праву

Мы поможем в написании ваших работ! ЗНАЕТЕ ЛИ ВЫ?

Влияние общества на человека

Приготовление дезинфицирующих растворов различной концентрации Практические работы по географии для 6 класса Организация работы процедурного кабинета Изменения в неживой природе осенью Уборка процедурного кабинета Сольфеджио. Все правила по сольфеджио Балочные системы. Определение реакций опор и моментов защемления |

Задачи принятия многокритериальных нечетких решений

Пусть даны альтернативы A1, A2, A3 и матрица нечеткого отношения предпочтения на множестве альтернатив.

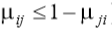

В ячейках матрицы записаны предпочтения альтернатив одной относительно другой. Должно выполняться следующее соотношение:

Вопрос: какую альтернативу выбрать? Решение: Вводим величину dt= 0.05 (5%)

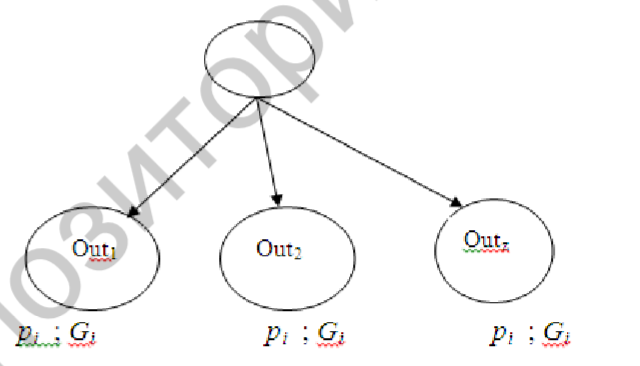

Принятие решений в условиях риска и неопределенности К технологии Data Mining относятся аналитические методы обработки информации, методы распознавания образов, методы прогнозирования, принятия решений, статистические методы, генетические алгоритмы. В условиях неопределенности интеллектуальная информационная система (ИИС) должна сделать выбор или последовательность выборов из совокупности различных всевозможных решений (действий), исход которых носит вероятностный или неопределенный характер. Принципы такого выбора назовем стратегией решения задачи в условиях неопределенности. Для формализации задачи введем понятие лотереи, как модели простейшей задачи выбора решения в условиях неопределенности. Лотерея характеризуется набором исходов: out1, out2, …, outz.

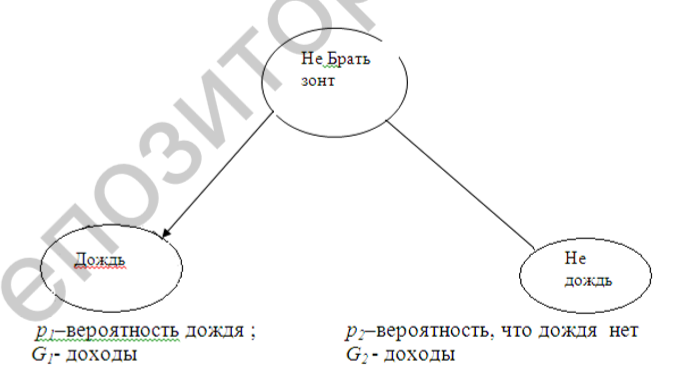

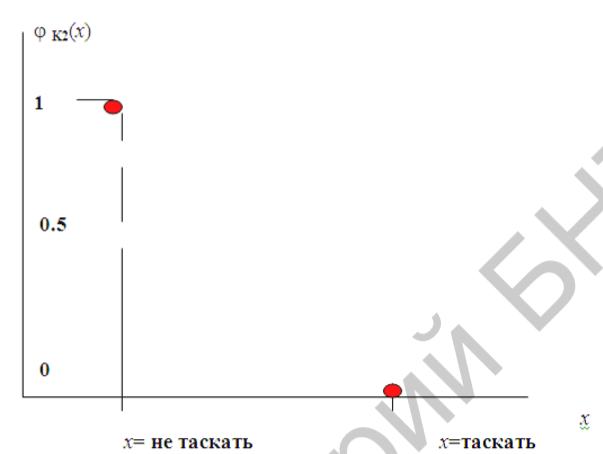

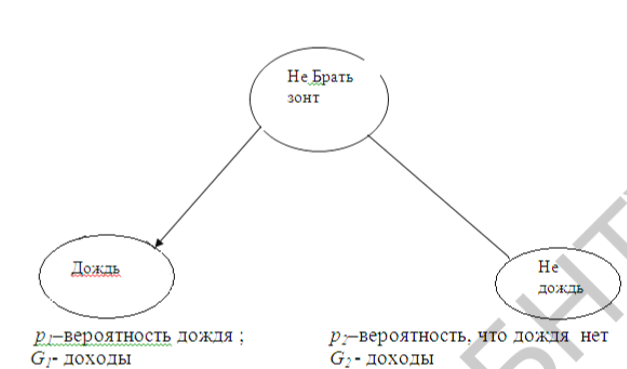

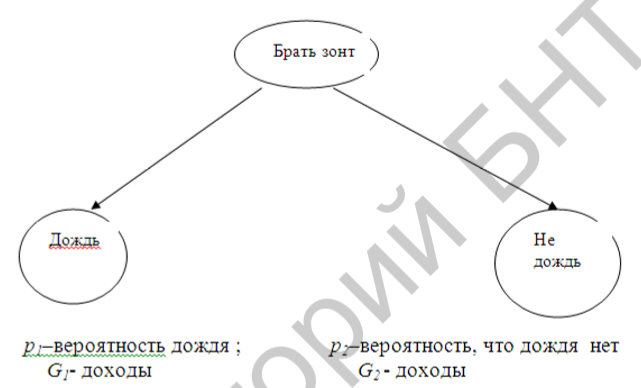

Сумма вероятностей pi = 1. Сыграть в лотерею – купить ее, но какую прибыль она принесет заранее не известно. Известно лишь что реализуется один из исходов out1, out2, … Проблема состоит в том, что перед лицом принимающим решение стоит задача выбора какой-то одной из альтернатив либо ни одной. Пример: Пусть некто решает брать ему зонтик или нет, здесь две лотереи – брать или не брать зонт. Рассмотрим первую лотерею – брать зонт.

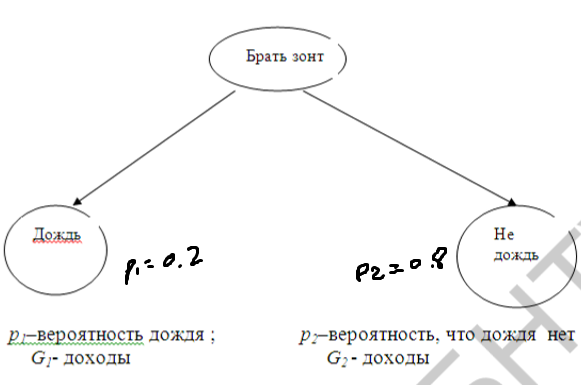

p1 = 0.2 p2 = 0.8 Для оценки дохода, вводится переменная F – полезность. Когда мы берем зонтик, то при наличии дождя можно принять F = G = 1. В случае если зонт взят, а дождя нет – F = G = 0. Оценим лотерею. Объективной ценой лотерии называется величина

pi = 0.2, G1 = 0 p2 = 0.8, G2 = 1

O = 0.2 * 0 + 0.8 * 1 = 0.8. при данных условиях зонт лучше не брать. В задаче о зонтике введем два критерия: 1. K1 – обеспечение одежды сухой. 2. K2 – затраты на ношение зонтика. Составляется матрица приоритетов критериев:

Оценки выставляются по шкале Саати. Kij = z -> Kji = 1/z;

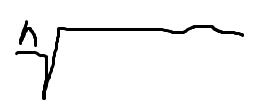

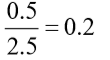

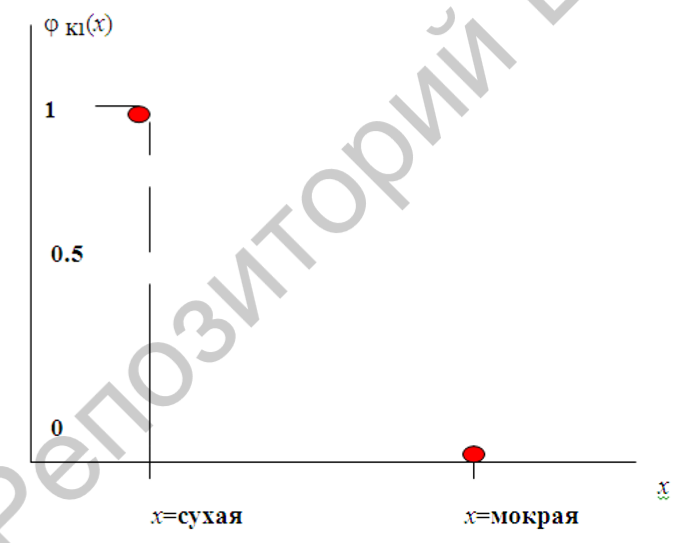

Далее находится произведение чисел в строках и из полученных произведений извлекается корень, степень которого является равной числу критериев. Далее подсчитывается сумма найденных корней и приоритеты критериев (веса) путем… Далее рассчитываются функции полезности по каждому критерию fi. Они также имеют субъективный характер, могут быть как дискретными так и непрерывными. Построим графики функции полезности для каждого из критериев.

Снова рассмотрим две лотереи.

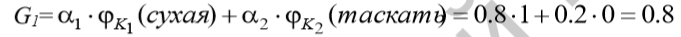

Рассчитаем G1:

Рассчитаем G2:

Оценим лотерею: O = 0.2*0.8+ 0.8*0.8 = 0.8; Для второй лотереи (не брать зонт)

Рассчитаем G1:

Рассчитаем G2:

Цена лотереи при данной раскладке: O = 0.2 * 0.2 + 0.8 * 1 = 0.84. Вывод: Эта оценка весьма незначительна превосходит первую лотерею, так что зонтик при этом раскладе можно как брать, так и не брать (результат практически одинаковый).

Рассмотрим расчет вероятностей. Достаточно общим случаем является применение теоремы Байеса. Это применение основано на использовании статистических таблиц. Пусть дана следующая таблица:

Формулировка теоремы Байеса: Пусть имеется n несовместных гипотез H1, H2, Hn. Несовместность означает, что никакие из них не могут произойти вместе (т.е. вероятность их совместного наступления равна нулю). Также известны вероятности событий p(H1), p(H2), p(Hn), причем, сумма вероятностей этих событий равна 1. Это означает, что события H1, H2, Hn, образуют полную группу событий, т.е. одно из них происходит обязательно. С событиями H1, H2, Hn, связано некоторое событие Е. Известны вероятности события Е, при условиях того, что какое-либо из событий H1, H2, Hn произошло p (E(H1)). Пусть известно что событие Е произошло, тогда вероятность того, что событие Hi произошло можно рассчитать по формуле Байеса. P(Hi/E) = (p(Hi) * p(E |Hi))/(p(H1) * p(E| H1) + p(H2) * p(E| H2), p(Hn) * p(E| Hn))= P(E * Hi) / P(E).

P(E * Hi) – совместная вероятность событий E и Hi P(E) – полная безусловная вероятность события Е

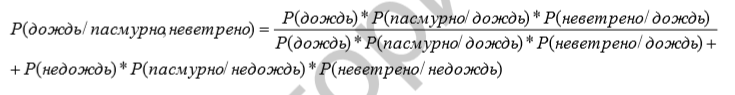

Пусть сегодня пасмурно (E1) и не ветрено (E2). Заметим, что все дни наблюдений были пасмурными и в пасмурную погоду дождя нет. Всего наблюдалось 60 дней. Определим из таблицы вероятность дождя полагая, что E1 и Е2 независимы.

P(Дождь) = 18/60; P(пасмурно) = 18/18 = 1; P(не ветрено / дождь) = 13/18 = 0,7; P(не дождь) = 42/60 = 0,7; P(пасмурно / не дождь) = 42/42 = 1; P(не ветрено / не дождь) = 30/42 = 0,75

P(дождь/ пасмурно, не ветрено) =(0.3 * 1 * 0.7) / (0.3 * 1 * 0.7 + 0.7 * 0.75 * 1) При данных значениях E1 и E2 вероятность дождя составит 47% Формула Байеса позволяет уточнять вероятность гипотез с учетом новой информации, т.е. данных о событий, свидетельствах, подтверждающих или опровергающих гипотезу. В экспертных системах (или ИИС) формула Байеса может применяться для оценки вероятностей заключения продукционных правил, на основе данных о достоверности их посылок. Заключения или выводы в этом случае соответствуют гипотезам в теореме Байеса, а посылки свидетельствам. Обычно посылка-правило содержит несколько условий. Вероятности p(Hi) и P(E | Hi) определяются на основе статистических данных с использованием формул теории вероятностей.

Генетическая логика В основе генетических методов лежит теория Дарвина о естественном отборе. В основе генетических алгоритмов лежит простая идея: берут пару наилучших порожденных образцов и порождают их потомка путем взаимного обмена характеристиками (скрещивания crossover). Потомков порождают все время и элитных представителей текущей совокупности. Когда наступает момент и не удается улучшить функционал, производят мутацию, т.е. порождают новые объекты не в результате скрещивания родительских объектов, а путем случайных изменений. Эта процедура ведется до тех пор, пока удается улучшить характеристики функционала. Генетический алгоритм был разработан Джоном Холандом. Пример. Пусть следует максимизировать следующую функцию: F(x,y) = 2x +4y – xy, x+y <= 11, x >=0, y>=0 Сформируем начальную комбинацию

Выберем элиту из 4х наилучших образцов, где функция достигает наибольших значений

Породим из них потомков, например, скрестим 5 и 8 объекты: (2, 5), (0,9)

Т.к. 10 потомок дал больший результат, будем манипулировать им. Скрестим 8 и 10 объекты, получим потомки (2,9) и (0,9). Т.к. нам не удалось улучшить целевую функцию путем скрещивания, перейдем к процессу мутации. Мутация – небольшие произвольные изменения в назначении гена (+/- небольшое значение). Мутация позволяет создавать новый материал, т.к. новые хромосомы перемешиваются с уже существующими. Таким образом мутация позволяет расширить область поиска решений. Осуществим мутацию двух лучших образцов (2,9) и (0, 9) -> (2,10) и (0, 10). (2,10) не удовлетворяет условиям

Возобновляем скрещивание. Процесс завершаем, когда ни мутация, ни скрещивание не улучшают функционал. Недостатки: 1. Проблема преждевременного схождения функции может произойти из-за недостаточного разнообразия хромосом 2. Проблема преждевременного схождения функции может произойти из-за выбора только элитных образцов, которые быстро сокращают свое количество. Сфера применения: 1. Финансы 2. Военная сфера 3. Бизнес

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

Последнее изменение этой страницы: 2017-02-07; просмотров: 121; Нарушение авторского права страницы; Мы поможем в написании вашей работы! infopedia.su Все материалы представленные на сайте исключительно с целью ознакомления читателями и не преследуют коммерческих целей или нарушение авторских прав. Обратная связь - 18.221.15.15 (0.022 с.) |

, если так, то в матрице ставим значение 0, в противном случае 1.

, если так, то в матрице ставим значение 0, в противном случае 1.

= 0.2*1 + 0.8*0 = 0.2; Именно цена определяет, брать зонт. Т.к. цена < 0.5, правильнее не брать зонт.

= 0.2*1 + 0.8*0 = 0.2; Именно цена определяет, брать зонт. Т.к. цена < 0.5, правильнее не брать зонт.